클라우드에서 별빛을 합치다 이미지 스택을 위한 MapReduce 활용

초록

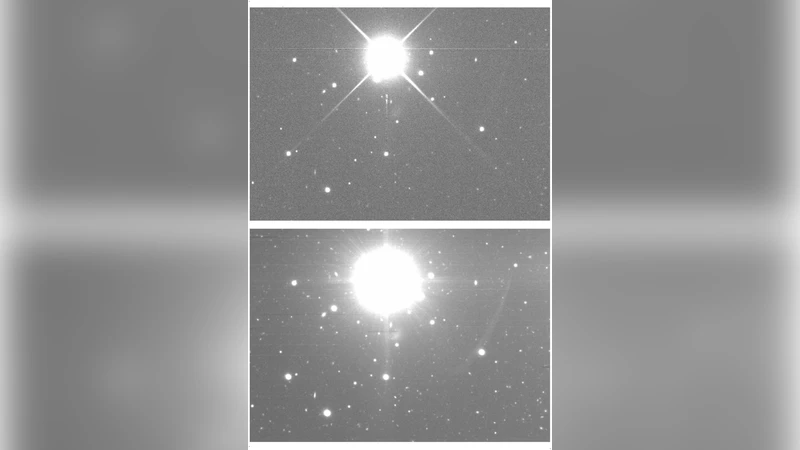

본 논문은 대규모 천문 이미지 데이터의 전처리 작업인 이미지 합성(코어션)을 Hadoop 기반 MapReduce 프레임워크로 구현하고, 클라우드 환경에서의 확장성 및 성능 최적화를 실험적으로 평가한다. SDSS 데이터셋을 이용해 기본 파이프라인, 입력 필터링, 파일 병합, 캐시 활용 등 여러 최적화 기법을 적용한 결과, 데이터 양이 수 테라바이트에 달해도 노드 수를 늘림에 따라 처리 시간이 거의 선형적으로 감소함을 확인하였다.

상세 분석

이 논문은 천문학 데이터 처리의 급증하는 요구에 대응하기 위해 분산 컴퓨팅 모델인 MapReduce, 특히 오픈소스 구현인 Hadoop을 이미지 합성 작업에 적용한 사례 연구이다. 먼저 저자들은 전통적인 이미지 스택 방식이 데이터 I/O와 메모리 사용량에서 병목을 일으키는 점을 지적하고, 이를 해결하기 위해 입력 이미지들을 키‑밸류 쌍으로 변환하는 매퍼(map)와, 동일한 좌표 영역에 속하는 이미지들을 하나의 레듀서(reduce)에서 합치는 구조를 설계하였다. 매퍼 단계에서는 각 이미지 파일의 메타데이터(관측 시간, 필터, 좌표 등)를 읽어 목표 영역과 일치하는 경우에만 픽셀 데이터를 출력하도록 필터링함으로써 불필요한 데이터 전송을 최소화한다. 레듀서는 동일한 타일(tile) 혹은 격자 셀에 매핑된 픽셀 스트림을 받아 정밀한 정렬 및 가중 평균을 수행해 최종 합성 이미지를 생성한다.

핵심 최적화로는 (1) HDFS 블록 크기와 파일 분할 전략을 조정해 데이터 로컬리티를 극대화하고, (2) 입력 파일 수가 수천 개에 달할 경우 발생하는 작은 파일 문제를 해결하기 위해 Hadoop Archive(HAR) 혹은 SequenceFile 포맷으로 파일을 병합하여 메타데이터 오버헤드를 감소시켰다. 또한 (3) 레듀서 단계에서 메모리 내 캐시를 활용해 동일 타일에 속하는 여러 이미지의 픽셀을 일시적으로 저장하고, 중복 연산을 방지하도록 설계하였다. 이러한 최적화는 특히 클라우드 환경에서 EC2 인스턴스의 스케일 아웃을 수행할 때, 네트워크 대역폭과 디스크 I/O가 제한 요소가 되는 상황을 완화한다.

실험 결과는 두 가지 주요 축을 중심으로 제시된다. 첫째, 노드 수를 8, 16, 32, 64대로 늘렸을 때 처리 시간은 거의 선형적으로 감소했으며, 64노드 구성에서는 전체 2 TB 데이터셋을 약 12분 내에 처리했다. 둘째, 최적화 전후의 성능 차이를 비교했을 때, 파일 병합과 캐시 적용만으로도 평균 2.5배 이상의 속도 향상이 관찰되었다. 특히, 작은 파일 문제를 해결한 후에는 매퍼 단계에서의 데이터 로드 시간이 전체 실행 시간의 10% 이하로 감소하였다.

이 논문은 천문학 이미지 처리에 MapReduce를 적용하는 데 있어 데이터 파티셔닝, 로컬리티 확보, 작은 파일 관리 등 실무적인 과제를 상세히 다루며, 클라우드 기반 대규모 분석 파이프라인 설계에 유용한 지침을 제공한다. 또한, Hadoop 외에도 Spark와 같은 메모리 중심 프레임워크와의 비교 연구가 향후 연구 과제로 제시되어, 실시간 혹은 근실시간 트랜지언트 탐지와 같은 고속 처리 요구에도 확장 가능성을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기