혼합 DAG 모델 학습을 위한 효율적 접근법

본 논문은 각 구성 요소가 유향 비순환 그래프(DAG)인 혼합 모델(MDAG)을 학습하기 위한 실용적인 알고리즘을 제시한다. 기존의 탐색‑점수 방식이 계산적으로 비현실적임을 지적하고, 기대 충분통계량을 실제 데이터처럼 취급하는 EM‑기반 구조·파라미터 교차 탐색 방법을 도입한다. Cheeseman‑Stutz 근사와 EM을 결합해 근사 사후확률을 효율적으로 추정함으로써, 합성 및 실제 데이터셋에서 좋은 성능을 보인다.

저자: Bo Thiesson, Christopher Meek, David Maxwell Chickering

**1. 서론 및 배경**

논문은 베이지안 네트워크, 특히 유향 비순환 그래프(DAG)를 기반으로 한 확률 모델이 다양한 분야에서 널리 사용되고 있음을 언급한다. 그러나 복수의 잠재 집단을 동시에 모델링하려면 DAG의 혼합 형태, 즉 MDAG(Mixture of DAGs)가 필요하다. MDAG는 각 구성 요소가 서로 다른 구조와 파라미터를 가질 수 있어, 데이터가 여러 하위 집단으로 이루어진 경우 더 정확한 예측과 인과 관계 해석을 가능하게 한다. 하지만 MDAG 학습은 (1) 가능한 구조 수가 초지수적으로 늘어나 탐색이 NP‑hard, (2) 사후확률을 정확히 계산하기 위한 몬테카를로나 대규모 샘플링이 비현실적인 계산 비용을 요구한다는 두 가지 근본적인 어려움에 직면한다.

**2. MDAG 모델 정의**

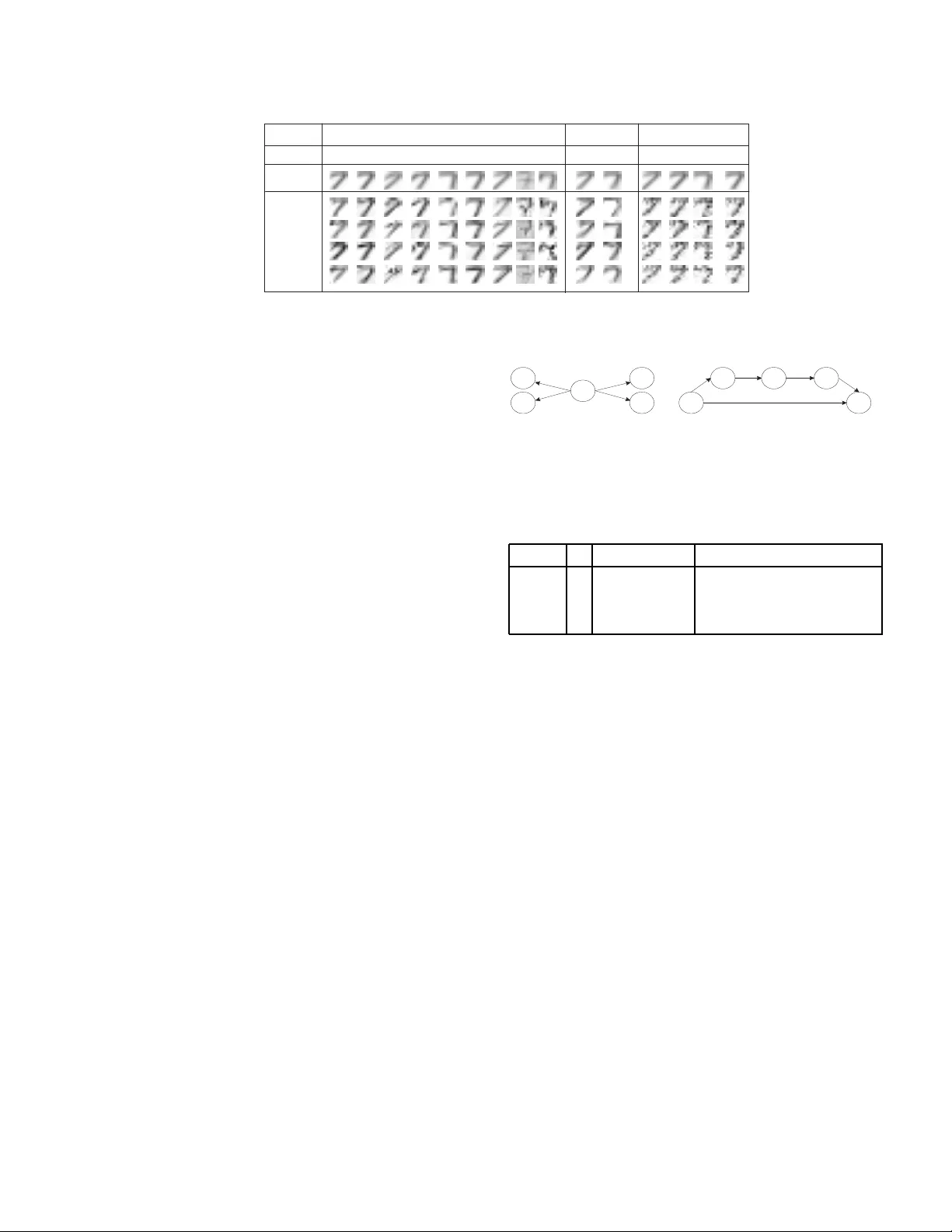

MDAG는 숨겨진 이산 변수 C와 관측 변수 집합 X로 구성된다. C는 각 사례가 어느 구성 요소에 속하는지를 나타내며, C가 숨겨져 있을 때 전체 모델은 X에 대한 혼합 분포 p(x)=∑₍c₎π_c p(x|θ_c,b_c) 로 표현된다. 각 구성 요소 DAG b_c는 로컬 파라미터 θ_c와 구조적 독립성을 가진다. 연속 변수는 선형 회귀와 가우시안 잡음, 이산 변수는 다항 분포를 사용하도록 제한한다(조건부 가우시안 분포).

**3. 베이지안 학습 프레임워크**

데이터 d가 주어졌을 때, 모델 구조 s와 파라미터 Θ_s에 대한 사후확률 p(s|d)∝p(d|s)p(s) 를 최대화한다. 사전은 구조에 대해 균등, 파라미터에 대해 공액(conjugate) 사전으로 가정한다. 완전 데이터일 경우 로그 주변우도(log marginal likelihood)는 폐쇄형식으로 계산 가능하지만, C가 숨겨진 MDAG에서는 데이터가 불완전하므로 직접 계산이 불가능하다.

**4. 기존 접근법의 한계**

단순 탐색‑점수 방식은 (i) 주변우도 근사를 위해 Monte‑Carlo나 대규모 샘플링을 매번 수행해야 하므로 시간 소모가 크고, (ii) 주변우도 점수가 구조에 대해 팩터화되지 않아 구조 변형마다 전체 모델을 재평가해야 하는 비효율성을 가진다.

**5. 제안 알고리즘: EM‑구조 교차 탐색**

핵심 아이디어는 기대 충분통계량(E

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기