카우마스와미 유닛으로 신경망 성능 향상

초록

본 논문은 시그모이드 뉴런을 복제해 만든 ‘뉴런 군(bunch)’을 일반화 카우마스와미 분포로 모델링하고, 이를 기반으로 새로운 활성화 함수인 카우마스와미 유닛을 제안한다. MNIST 데이터에 단층 신경망을 적용한 실험에서 카우마스와미 유닛(특히 (8,30) 파라미터 조합)이 시그모이드, ReLU, Noisy ReLU보다 낮은 테스트 오류와 교차 엔트로피를 기록하며, 활성화 분포에서도 포화 현상이 적은 장점을 보였다.

상세 분석

본 연구는 기존 활성화 함수의 한계를 보완하기 위해 ‘같은 가중치와 편향을 갖는 뉴런을 다수 복제하는’ 아이디어를 도입한다. 복제된 뉴런 각각을 독립적인 서브컴포넌트로 간주하고, 전체 군의 활성화 확률을 일반화 카우마스와미(KUM‑G) 분포로 표현한다. KUM‑G는 기본 분포 G(x)와 두 형태 매개변수 a, b에 의해 정의되며, 여기서 G(x)는 시그모이드 함수 σ(x)이다. 따라서 제안된 카우마스와미 유닛은

Kσ(x|a,b)=1−(1−σ(x)^a)^b

라는 형태를 갖는다. a=b=1이면 순수 시그모이드와 동일하고, a와 b를 크게 설정하면 함수는 0 부근에서 급격히 상승해 ReLU와 유사한 비선형성을 만든다. 중요한 점은 출력값이 0과 1 사이에 제한되므로, 완전한 양수 출력만을 허용하는 ReLU와 달리 학습 안정성을 높일 수 있다는 점이다.

미분은 연쇄법칙을 이용해 간단히 구할 수 있어 역전파에 별도 비용이 들지 않는다. 논문은 (a,b)=(5,6)과 (8,30) 두 조합을 실험에 사용했으며, 특히 (8,30)은 0.25와 0.75 구간에서 ReLU를 가장 가깝게 근사한다.

실험 설계는 500개의 은닉 유닛을 가진 단층 네트워크에 MNIST 데이터를 50 k/10 k/10 k(학습/검증/테스트)로 분할하여 수행하였다. 학습은 모멘텀 SGD, 배치 크기 100, 초기 학습률 0.01(다중 후보 중 선택) 등 표준 설정을 따랐으며, 조기 종료와 학습률 감소 스케줄을 적용했다. 평가 지표는 테스트 분류 오류와 교차 엔트로피이며, 각 활성화 함수별 평균값을 5번 반복 실험 후 보고하였다.

결과는 카우마스와미(8,30)이 테스트 오류 4.87 %와 교차 엔트로피 0.16을 기록해 가장 우수했다. ReLU는 5.44 %/0.19, Noisy ReLU는 5.79 %/0.21, 전통 시그모이드는 5.85 %/0.21에 그쳤다. 학습 곡선을 보면 카우마스와미는 10 epoch 이후 이미 최적에 근접했으며, ReLU는 18 epoch, 시그모이드는 65 epoch까지 수렴에 시간이 필요했다.

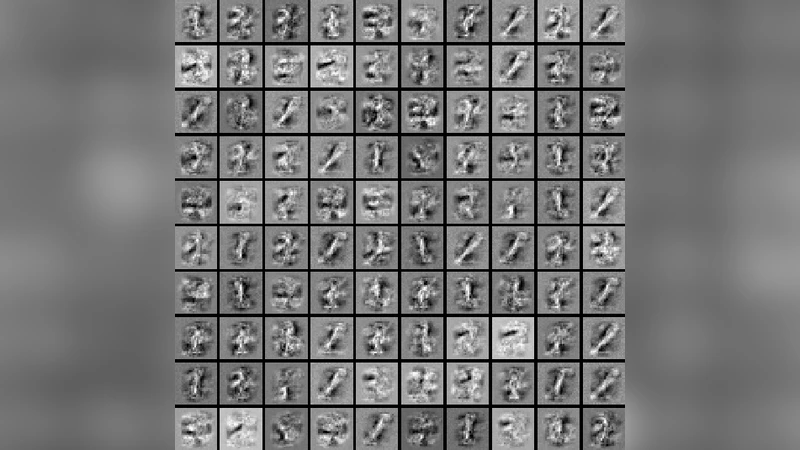

활성화 분포 분석에서는 ReLU와 Noisy ReLU가 0.01 이하의 매우 낮은 활성화를 보이는 뉴런이 다수 존재했지만, 동시에 0.5 이상으로 과도하게 활성화되는 뉴런도 발견되었다. 반면 카우마스와미는 평균 활성화가 0.5 이하에 머물며 포화 현상이 거의 없었다. 이는 학습 과정에서 뉴런 간 균형 잡힌 기여를 가능하게 하여 일반화 성능 향상에 기여했을 것으로 해석된다.

이 논문은 ‘뉴런 군’이라는 새로운 구조적 관점을 제시함으로써 활성화 함수 설계에 통계적 분포 모델을 적용한 사례를 보여준다. 다만 실험이 단층 네트워크와 MNIST에 국한돼 있어, 깊은 네트워크, 다른 데이터셋, 혹은 다른 a, b 조합에 대한 일반화 가능성은 추가 연구가 필요하다. 또한 복제된 뉴런이 실제 하드웨어나 메모리 효율성에 미치는 영향도 고려해야 할 과제이다.

댓글 및 학술 토론

Loading comments...

의견 남기기