깊은 합성곱 학습을 위한 생성 모델

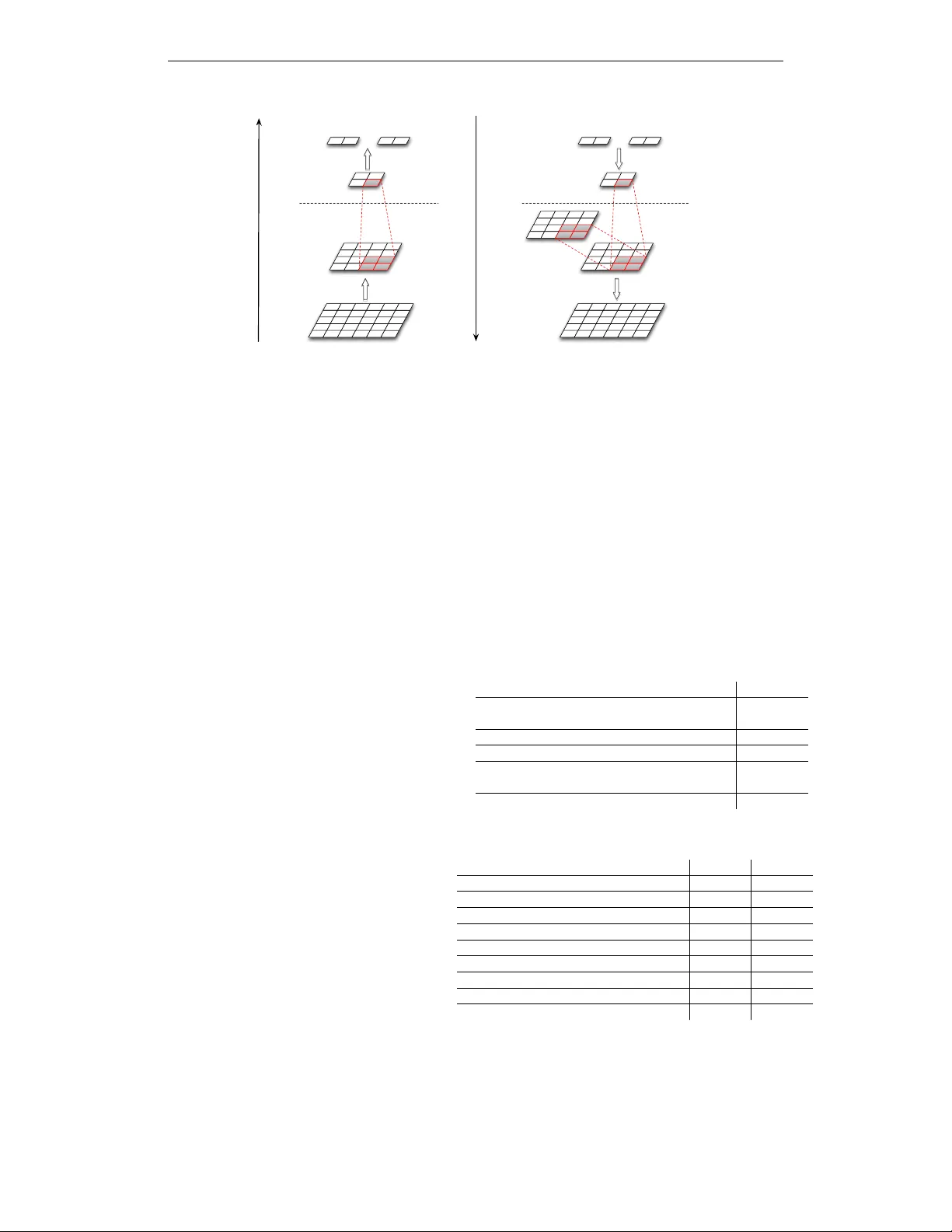

본 논문은 다층 합성곱 사전학습과 확률적 풀링을 결합한 베이지안 생성 모델을 제시한다. 하향식(pretraining)과 상향식(refinement) 두 단계의 확률적 추론을 통해 이미지에서 다층 특징을 효율적으로 학습하고, MNIST와 Caltech‑101에서 경쟁력 있는 분류 성능을 기록한다.

저자: Yunchen Pu, Xin Yuan, Lawrence Carin

본 논문은 “깊은 합성곱 사전학습을 위한 생성 모델”이라는 제목 아래, 다층 합성곱 사전학습과 확률적 풀링을 결합한 베이지안 생성 프레임워크를 제안한다. 저자들은 먼저 이미지 집합 {X⁽ⁿ⁾}ₙ₌₁ᴺ을 입력으로 받아, 각 레이어 l (1 ≤ l ≤ L)에서 K_l개의 사전 D(k_l,l)와 이진 마스크 Z⁽ⁿ⁾(k_l,l)·실수 가중치 W⁽ⁿ⁾(k_l,l)으로 구성된 활성화 S⁽ⁿ⁾(k_l,l) = Z·W 를 정의한다. 이때 Z는 {0,1} 값을 가지며, 각 풀링 블록 내에서 오직 하나의 픽셀만이 비제로가 되도록 멀티노미얼 분포로 모델링한다. 이렇게 구성된 블록은 max‑pooling과 동일한 효과를 내지만, 확률적 선택 과정을 통해 학습 중 불확실성을 명시적으로 표현한다.

수식적으로는 1‑layer 모델을 X⁽ⁿ⁾ = ∑ₖ D(k) ∗ (Z⁽ⁿ⁾(k)⊙W⁽ⁿ⁾(k)) + E⁽ⁿ⁾ 로 나타내며, 여기서 ∗는 컨볼루션, ⊙는 원소별 곱, E는 잔차이다. 다층 확장에서는 레이어 l 의 출력 X⁽ⁿ⁾(l+1) = P

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기