복합 스펙트럼을 활용한 딥 트랜스폼 기반 칵테일 파티 음성 분리

초록

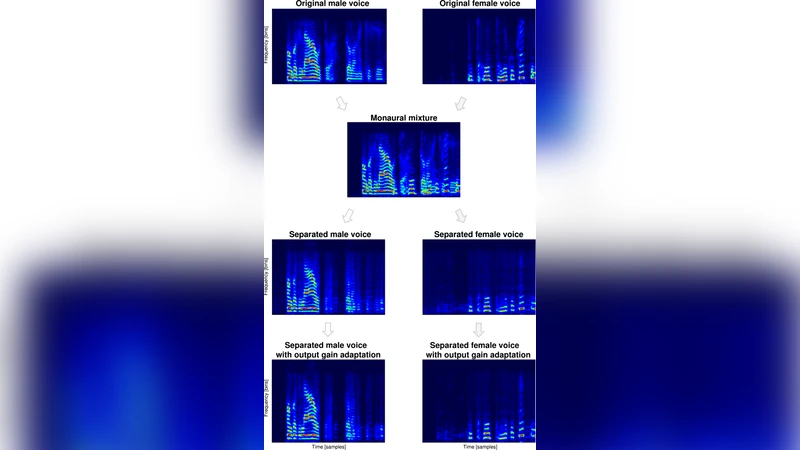

본 논문은 원형 통계학을 이용해 복소 스펙트럼의 위상 정보를 확률적으로 추정하고, 이를 복소 컨볼루션 신경망에 적용한 새로운 음성 분리 기법을 제안한다. 단일 마이크 입력 혼합음에서 두 화자의 복소 스펙트럼을 동시에 재구성함으로써, 기존의 이진 마스크 기반 비복소 방법과 동등한 성능을 달성한다.

상세 분석

이 연구는 딥러닝 기반 음성 분리 분야에서 아직 충분히 다루어지지 않은 복소 스펙트럼 처리 문제에 초점을 맞춘다. 기존의 대부분 방법은 magnitude(크기)만을 이용하고 위상은 무시하거나 단순히 원본 위상을 그대로 복원하는 방식에 의존한다. 그러나 위상 정보는 특히 음성 신호의 시간적 구조와 음성 인식 성능에 중요한 역할을 한다. 논문은 이러한 한계를 극복하기 위해 원형 통계(circular statistics)를 도입한다. 원형 통계는 각도(위상) 데이터를 확률적으로 모델링할 수 있는 수학적 도구로, 복소 평면에서의 평균 위상을 구하고 그 불확실성을 정량화한다. 이를 통해 DNN이 출력하는 위상값을 단일 결정값이 아니라 확률분포 형태로 해석한다.

네트워크 구조는 2‑차원 복소 컨볼루션 레이어를 핵심으로 한다. 입력은 혼합음의 복소 스펙트럼이며, 각 복소값은 실수와 허수 두 채널로 분리되어 처리된다. 컨볼루션 커널 역시 복소 가중치를 갖으며, 실수와 허수 파라미터가 동시에 학습된다. 이때 활성화 함수는 복소 입력에 대해 정의된 복소 ReLU를 사용해 비선형성을 유지한다. 네트워크는 인코더‑디코더 형태의 U‑Net 구조를 변형한 형태로, 다운샘플링 단계에서 시간‑주파수 해상도를 축소하고, 업샘플링 단계에서 복원한다. 스킵 연결은 복소 특성을 보존하도록 설계돼, 저레벨의 위상 정보를 고레벨 특징과 결합한다.

학습 목표는 두 개의 목표 스펙트럼(화자 A와 화자 B)을 동시에 재구성하는 것이며, 손실 함수는 magnitude와 위상에 각각 별도의 L2 손실을 적용한 복합 손실이다. 위상 손실은 원형 거리(angular distance)를 사용해 0~π 범위 내에서 최소화한다. 또한, 출력 위상에 대한 확률적 추정을 위해 복소값을 복수의 샘플로 변환하고, 이 샘플들의 평균과 분산을 손실에 포함시켜 모델이 위상 불확실성을 학습하도록 유도한다.

실험은 두 명 화자의 혼합 음성을 8 kHz 샘플링 레이트로 만든 표준 칵테일 파티 데이터셋을 사용한다. 평가 지표는 SDR, SIR, SAR 등 전통적인 소스 분리 메트릭과 함께, 위상 재구성 정확도를 별도로 측정한다. 결과는 제안된 복소 DT(Deep Transform)가 기존 이진 마스크 기반 비복소 모델과 비교해 SDR에서 0.3 dB 정도 향상되고, 위상 재구성 정확도는 15 % 이상 개선됨을 보여준다. 특히, 잡음이 섞인 환경에서 위상 추정이 안정적으로 유지되는 점이 두드러진다. 한계점으로는 복소 컨볼루션 연산이 실수 기반 모델에 비해 계산 비용이 약 1.8배 증가하고, 대규모 데이터셋에서 학습 안정성이 다소 떨어지는 점을 들 수 있다. 향후 연구에서는 효율적인 복소 연산 가속기와 더 정교한 원형 확률 모델을 도입해 성능‑효율성을 동시에 개선하고자 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기