중첩 그룹을 갖는 대규모 네트워크 모델의 모델 선택 및 가설 검정

초록

본 논문은 네트워크 구조를 설명하는 여러 생성 모델을 최소 설명 길이(MDL)와 사후 오즈 비율을 이용해 비교·선택하는 방법을 제시한다. 특히, 그룹 중첩(overlap)과 정도 보정(degree correction) 기능을 포함한 네 가지 변형 모델을 평가하고, 실제 데이터 100여 개에 적용한 결과 중첩은 대부분 통계적으로 지지되지 않으며, 반면 정도 보정은 거의 모든 네트워크에서 선호된다는 결론을 얻었다.

상세 분석

이 연구는 네트워크 과학에서 가장 근본적인 문제 중 하나인 “어떤 모델이 실제 네트워크를 가장 잘 설명하는가?”에 대한 체계적인 해답을 제공한다. 먼저 저자는 확률적 생성 모델을 기반으로 네트워크를 기술하고, 모델 복잡도와 데이터 적합도를 동시에 고려하는 최소 설명 길이(MDL) 원리를 도입한다. MDL은 데이터의 엔트로피 S(G|θ)와 파라미터 공간의 엔트로피 L(θ)를 합산한 Σ = L + S 로 정의되며, 이는 베이지안 사후 확률의 음의 로그와 동일하다. 따라서 Σ를 최소화하는 파라미터 집합이 가장 압축된 설명을 제공하고, 모델 간 비교는 사후 오즈 비율(posterior odds ratio)로 정량화된다.

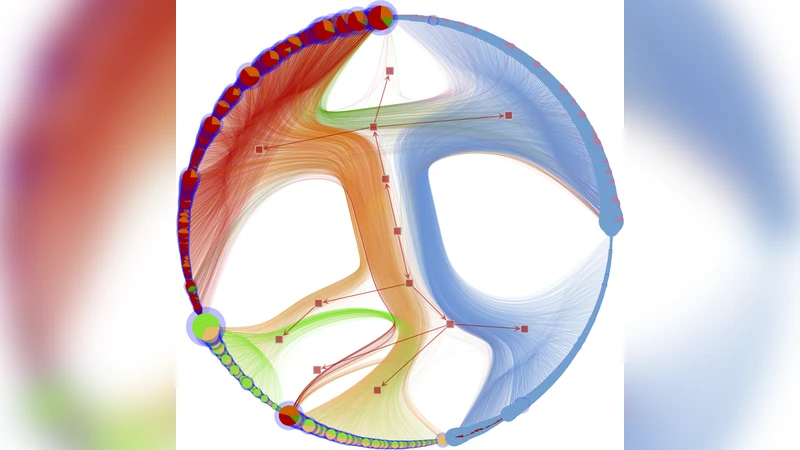

논문에서 다루는 네 가지 모델은 (1) 비중첩 비정도 보정(stochastic block model, SBM), (2) 비중첩 정도 보정(degree‑corrected SBM), (3) 중첩 비정도 보정(overlapping SBM), (4) 중첩 정도 보정(overlapping degree‑corrected SBM)이다. 중첩 모델은 각 노드 i에 이진 멤버십 벡터 b_i를 부여해 다중 그룹 소속을 허용하고, 정도 보정 모델은 각 그룹 r에 대한 라벨링된 반쪽(edge) 수 k_{ri}를 추가해 노드별 연결 성향을 독립적으로 모델링한다. 저자는 이들 모델의 엔트로피식을 정확히 유도하고, 병렬 엣지(parallel edges)의 발생 확률을 무시할 수 있는 희소성 가정을 통해 계산을 단순화한다.

모델 선택 절차는 두 단계로 구성된다. 첫째, 각 모델에 대해 최적 파라미터를 찾기 위해 변분 베이지안 최적화와 효율적인 그래프 압축 알고리즘을 사용한다. 둘째, 얻어진 최소 설명 길이 Σ를 비교해 가장 작은 값을 가진 모델을 선택한다. 또한, 사후 오즈 비율을 통해 모델 간 통계적 유의성을 검정함으로써, 단순히 설명 길이가 짧은 모델이 과적합인지 여부를 판단한다.

실험에서는 100여 개의 무가중치 실세계 네트워크(소셜, 생물학, 기술, 인프라 등)를 대상으로 위 절차를 적용했다. 결과는 두드러졌다. 정도 보정이 포함된 모델은 거의 모든 네트워크에서 MDL이 크게 감소했으며, 이는 노드 고유의 연결 성향이 그룹 구조보다 더 중요한 설명 변수임을 시사한다. 반면, 중첩을 허용한 모델은 전체 네트워크 중 약 10% 이하에서만 유의미하게 선택되었으며, 대부분의 경우 사후 오즈 비율이 1에 가까워 중첩 효과가 통계적으로 검증되지 않음을 보여준다. 이는 기존 많은 연구에서 보고된 중첩 커뮤니티가 실제 데이터보다 모델 복잡도에 의해 과대 해석된 가능성을 제기한다.

또한 저자는 모델 식별성(identifiability) 한계를 분석한다. 특히, 중첩 모델은 파라미터 공간이 급격히 확장되면서 동일한 관측 그래프를 여러 파라미터 조합이 생성할 수 있는 비가역성을 갖는다. 이때 MDL은 파라미터 엔트로피 L(θ)를 통해 이러한 불확실성을 자동으로 벌점(penalty)으로 반영한다. 따라서 모델 선택 과정 자체가 파라미터 불확실성을 정량화하고, 과도한 중첩 가정을 억제한다.

결론적으로, 이 논문은 네트워크 모델링에서 “복잡도 vs 적합도” 트레이드오프를 정량적으로 해결하는 강력한 프레임워크를 제공한다. 최소 설명 길이와 사후 오즈 비율을 결합한 접근법은 다양한 생성 모델을 공통의 확률적 기준 아래 비교 가능하게 만들며, 특히 정도 보정이 거의 보편적으로 필요하고, 중첩은 특수한 경우에만 정당화된다는 실증적 통찰을 제공한다. 이러한 결과는 네트워크 분석 방법론의 선택과 해석에 중요한 지침을 제공한다.

댓글 및 학술 토론

Loading comments...

의견 남기기