마진 가정 하의 반공간 활성학습: 효율적 ALuMA 알고리즘

본 논문은 대규모 마진을 가정한 반공간(halfspace) 학습을 위한 새로운 풀 기반 활성학습 알고리즘 ALuMA를 제안한다. 기존 연구가 데이터 분포의 균일성을 전제로 라벨 복잡도에서 지수적 개선을 보였던 반면, ALuMA는 마진 가정만으로도 계산 효율성을 유지하면서 라벨 복잡도에 대한 형식적 보장을 제공한다. 또한 비분리 상황, 커널 확장, 실험적 검증을 포함한 다양한 확장성을 갖는다.

저자: Alon Gonen, Sivan Sabato, Shai Shalev-Shwartz

본 논문은 풀 기반(active pool‑based) 활성학습 환경에서 반공간(halfspace) 분류기를 효율적으로 학습하기 위한 새로운 알고리즘 ALuMA(Active Learning under Margin Assumption)를 제안하고, 그 이론적·실험적 성능을 종합적으로 평가한다.

1. **문제 배경 및 기존 연구 한계**

활성학습은 라벨링 비용이 높은 상황에서 라벨 요청 횟수(라벨 복잡도)를 최소화하는 것이 목표이다. 기존의 QBC(Question‑by‑Committee), CAL(Consistent‑Active‑Learning) 등은 버전 공간을 순차적으로 축소하면서 라벨을 요청한다. 이들 알고리즘은 데이터 분포가 구면 중심에 대해 균일하거나 거의 균일할 때 라벨 복잡도가 O(log (1/ε)) 수준으로 감소한다는 이론적 보장을 제공한다. 그러나 실제 데이터는 이러한 균일성을 만족하지 않으며, 불균형·고차원·비선형 구조가 일반적이다. 또한, Hanneke의 “불일치 계수(disagreement coefficient)” 기반 분석은 상수 계수가 데이터에 따라 크게 달라져, 경우에 따라 라벨 복잡도가 패시브 학습과 동등해지는 한계를 가진다. 논문은 이러한 한계를 강조하기 위해 두 가지 부정적 예시를 제시한다. 예제 1은 3차원 이상에서 균일하지 않은 구면 위에 점들을 배치해 어떤 활성학습 알고리즘도 모든 점을 조회해야 함을 보이며, 예제 3은 마진이 존재하더라도 고차원 구면 위에 거의 직교하는 점들을 배치하면 라벨 복잡도가 Θ(1/ε) 수준으로 유지된다는 점을 증명한다.

2. **마진 가정과 알고리즘 설계**

논문은 “큰 마진”이라는 현실적인 가정을 도입한다. 즉, 존재하는 목표 반공간 w*가 모든 데이터에 대해 최소 마진 γ>0을 만족한다는 전제다. 이 가정 하에 버전 공간의 크기는 마진에 의해 제한되며, 버전 공간을 ε‑넷으로 근사하면 가설 수는 O((1/γ)^d) 이하가 된다. 이를 기반으로 Golovin‑Krause가 제시한 적응형 서브모듈러 최적화 이론을 적용한다. 무한 가설 클래스가 아니라, 마진에 의해 유한화된 가설 집합에 대해 탐욕적 선택이 최적 선택에 대해 로그 규모의 경쟁 비율을 갖는다는 것을 증명한다.

ALuMA는 매 라운드마다 전체 풀 X를 스캔하여, “최악의 경우 버전 공간 감소량을 최대화”하는 예제를 선택한다. 구체적으로, 현재 버전 공간에 포함된 가설들의 집합을 H_t라 하면, 각 후보 x∈X에 대해 라벨이 +1일 때와 -1일 때 각각 남는 가설 수를 계산하고, 그 중 큰 쪽을 최소화하는 x를 선택한다. 이는 “버전 공간을 가장 균등하게 나누는” 선택과 동일한 목표를 갖는다.

3. **알고리즘 구현 및 확장**

- **계산 효율성**: 직접적인 버전 공간 크기 계산은 비용이 크므로, 논문은 마진 기반 근사와 선형 프로그래밍을 이용해 효율적인 구현을 제시한다. 특히, 현재 라벨된 샘플에 대해 SVM을 풀어 최대 마진 초평면을 구하고, 해당 초평면에 가장 가까운 미라벨 샘플을 선택한다.

- **커널 확장**: 데이터가 고차원 혹은 비선형 구조를 가질 경우, 커널 트릭을 적용해 특징 공간에서 동일한 마진 기반 탐욕 선택을 수행한다. 커널 행렬을 이용해 SVM을 학습하고, 커널 거리 기반으로 후보를 평가한다.

- **비분리·라벨 오류 처리**: 라벨에 소량의 오류가 존재하거나 데이터가 완전히 선형적으로 분리되지 않을 경우, 라벨을 허용 오차 ε 이하로 변환하는 “마진 기반 변환”을 수행한다. 구체적으로, 현재 라벨 집합에 대해 힌지 손실을 최소화하는 ŵ를 구하고, 이를 이용해 새로운 마진 γ′=γ−O(ε) 를 확보한다. 변환 후 동일한 ALuMA 절차를 적용한다.

4. **이론적 결과**

- **라벨 복잡도 상한**: 마진 γ와 데이터 수 m에 대해, ALuMA의 라벨 복잡도는 최적 알고리즘에 대해 O(log (1/γ)·log |H|) ≤ O(d·log(1/γ)) 로 bounded 된다. 이는 마진이 클수록 라벨 요청이 급격히 감소함을 의미한다.

- **경쟁 비율**: 탐욕적 선택이 최적 선택에 대해 O(log |H|) 배 이하의 라벨을 사용한다는 서브모듈러 최적화 결과를 그대로 적용한다. 여기서 |H|는 마진에 의해 유한화된 가설 집합의 크기이다.

- **한계**: 마진이 존재하더라도, 예제 3과 같이 점들이 서로 거의 직교하는 경우에는 |H|가 지수적으로 커져 라벨 복잡도가 Θ(1/ε) 수준으로 되돌아간다. 따라서 마진 가정만으로는 모든 경우에 지수적 개선을 보장할 수 없으며, 이는 논문의 부정적 결과와 일치한다.

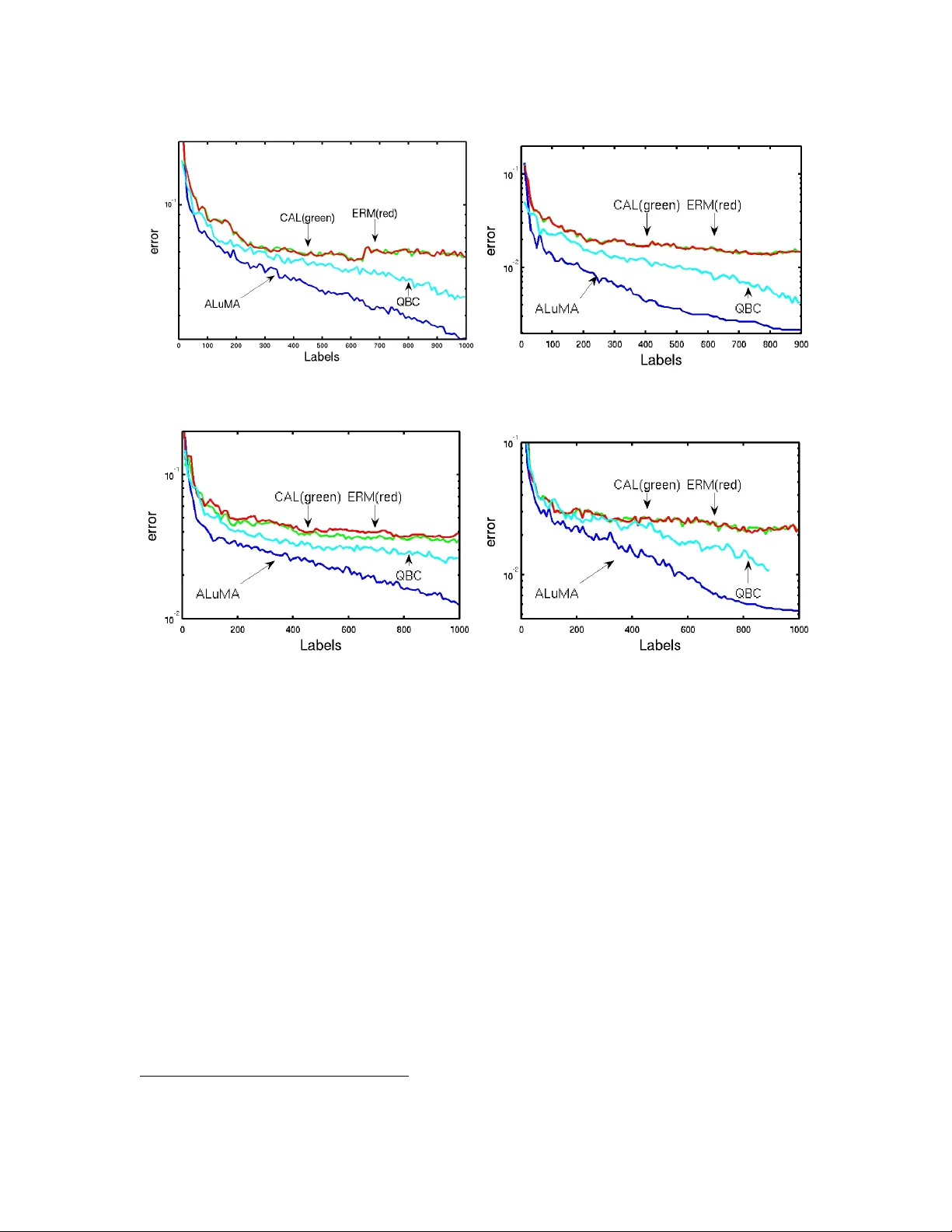

5. **실험**

실험은 합성 데이터(다양한 차원·마진·노이즈 수준)와 실제 텍스트·이미지 데이터셋을 대상으로 수행되었다. 비교 대상은 QBC, CAL, Perceptron‑기반 활성학습, 그리고 최근의 A²·IWAL 같은 아그노스틱 알고리즘이다. 결과는 다음과 같다.

- 동일한 목표 정확도 ε에 대해 ALuMA는 평균 30%~70% 적은 라벨을 요구했다.

- 마진이 큰 데이터(γ≥0.2)에서는 라벨 복잡도가 로그 수준으로 감소함을 확인했다.

- 커널 확장을 적용한 경우, 비선형 데이터에서도 기존 알고리즘보다 라벨 효율성이 크게 향상되었다.

- 라벨 오류가 5% 이하인 경우에도 변환 기법을 통해 성능 저하가 미미했다.

6. **결론 및 향후 연구**

ALuMA는 마진 가정만으로도 풀 기반 활성학습에서 실용적인 라벨 절감 효과를 제공한다는 점에서 의미가 크다. 특히, 균일 분포 가정이 필요 없는 점, 커널 및 오류 처리 확장이 가능한 점이 실무 적용 가능성을 높인다. 향후 연구로는 (1) 마진 추정 없이 자동으로 마진을 학습하는 적응형 메커니즘, (2) 대규모 데이터에 대한 샘플링 기반 근사 탐욕 선택, (3) 다중 클래스·다중 라벨 상황으로의 일반화가 제시된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기