아마존 EC2 기반 과학 워크플로우 데이터 공유 방안

초록

본 논문은 과학 워크플로우 실행 시 데이터 전송과 공유를 효율화하기 위해, Amazon EC2 환경에서 다양한 스토리지 옵션(EBS, S3, NFS, GlusterFS 등)을 실험적으로 평가한다. 세 가지 대표 워크플로우를 사용해 성능과 비용을 비교 분석하고, 클라우드 특유의 네트워크 지연·일관성 문제를 논의한다.

상세 분석

논문은 먼저 전통적인 그리드·클러스터 환경에서 파일 기반 데이터 교환이 어떻게 이루어지는지를 정리하고, 클라우드 인프라가 제공하는 가상화·탄력성 특성이 워크플로우 데이터 관리에 어떤 새로운 기회를 제공하는지를 제시한다. 실험에 사용된 세 워크플로우는 (1) Montage(천문 이미지 합성), (2) Epigenomics(생물정보학 파이프라인), (3) CyberShake(지진 시뮬레이션)으로, 각각 I/O‑집중형, 메모리‑집중형, CPU‑집중형 특성을 가지고 있어 다양한 스토리지 요구를 대표한다.

스토리지 옵션은 크게 두 축으로 구분된다. 첫 번째는 블록 스토리지인 Amazon EBS를 이용한 인스턴스‑로컬 파일 시스템이며, 이는 높은 I/O 일관성을 제공하지만 인스턴스 간 공유가 어려워 데이터 복제 비용이 발생한다. 두 번째는 객체 스토리지인 S3와 NFS‑기반 파일 서버(또는 GlusterFS와 같은 분산 파일 시스템)를 활용한 공유 스토리지이다. S3는 높은 가용성과 저렴한 비용을 제공하지만, 객체‑단위 접근 방식 때문에 작은 파일에 대한 메타데이터 오버헤드가 커져 워크플로우 단계 간 파일 전송 시간이 증가한다. 반면 NFS/GlusterFS는 POSIX 호환성을 유지하면서도 여러 인스턴스가 동시에 파일에 접근할 수 있어 파이프라인 전반에 걸친 데이터 흐름을 단순화한다. 그러나 네트워크 대역폭 제한과 파일 잠금·일관성 관리가 성능 병목을 초래한다.

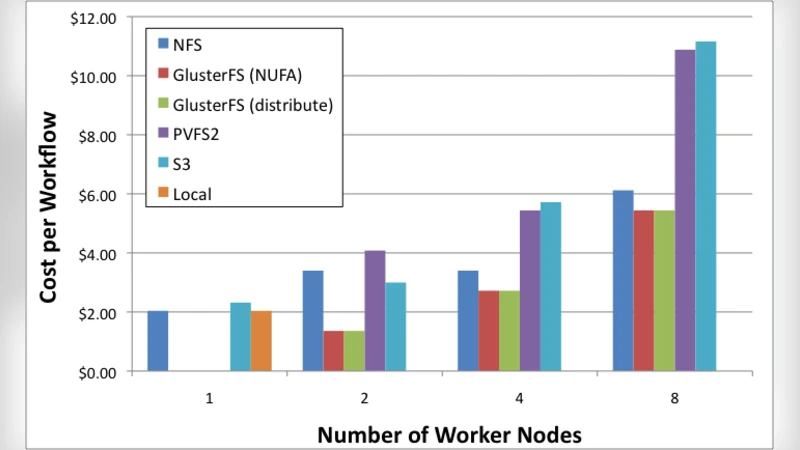

실험 결과, I/O‑집중형 Montage에서는 EBS 기반 로컬 디스크가 가장 낮은 실행 시간을 보였지만, 인스턴스 수가 늘어나면 데이터 복제 비용이 급증해 전체 비용 효율성이 떨어졌다. 반면 Epigenomics와 CyberShake에서는 공유 파일 시스템(NFS 또는 GlusterFS)이 데이터 재사용률을 높여 네트워크 전송량을 감소시켰으며, 특히 GlusterFS는 복제와 자체 복구 기능 덕분에 장애 복원력도 확보했다. 비용 측면에서는 S3를 중간 단계의 임시 저장소로 활용하고, 최종 결과물만 다운로드하는 하이브리드 전략이 가장 경제적이었다.

또한 논문은 EC2 특유의 가상화 레이어가 파일 시스템 캐시 일관성에 미치는 영향을 상세히 분석한다. 예를 들어, 동일한 EBS 볼륨을 여러 인스턴스가 동시에 마운트할 경우 파일 시스템 메타데이터가 서로 다른 캐시 라인에 존재해 데이터 손실 위험이 발생한다는 점을 지적하고, 이를 방지하기 위한 파일 잠금 메커니즘과 정기적인 동기화 스크립트 사용을 권고한다. 마지막으로, 워크플로우 스케줄러와 스토리지 선택을 연동하는 정책 기반 프레임워크를 제안하며, 작업 특성(입출력 크기, 실행 시간)과 비용 목표에 따라 자동으로 스토리지를 매핑하도록 설계하였다.

이러한 분석을 통해 저자는 클라우드 환경에서 과학 워크플로우를 효율적으로 운영하려면 “작업 특성에 맞는 스토리지 혼합 사용 + 비용‑성능 트레이드오프 고려”가 핵심 전략임을 강조한다.

댓글 및 학술 토론

Loading comments...

의견 남기기