HepData 재탄생 고에너지 물리 데이터 아카이브 혁신

초록

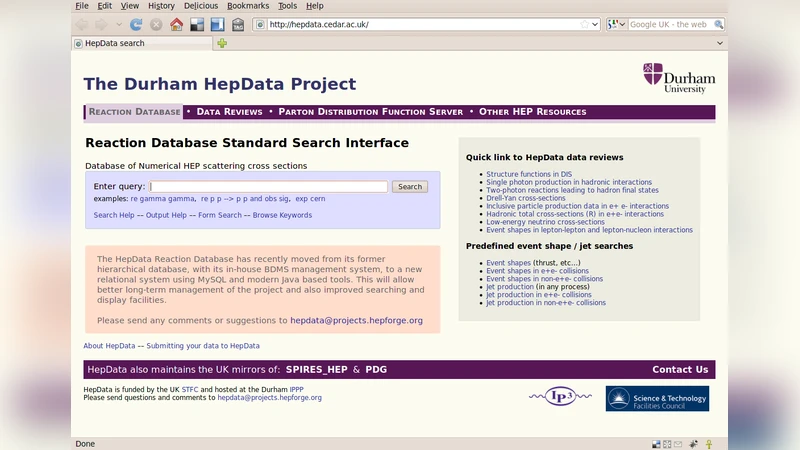

본 논문은 LHC 시대에 맞춰 HepData 데이터베이스를 전면 재구축한 현황을 소개한다. 최신 데이터베이스와 프로그래밍 기술을 도입해 백엔드의 데이터 표현을 보다 유연하고 의미론적으로 개선했으며, 웹 기반 인터페이스와 RESTful API를 제공한다. 새로운 시스템은 Monte‑Carlo 검증·튜닝을 위한 단일 참조 데이터 소스로 활용될 수 있도록 설계되었으며, 외부 애플리케이션과의 연동을 용이하게 한다.

상세 분석

HepData는 수십 년간 고에너지 물리 실험 결과를 보관해 온 핵심 인프라였지만, 기존 시스템은 레거시 구조와 제한된 검색·표현 기능으로 인해 LHC와 같은 대규모 데이터 시대에 부적합했다. 논문은 이러한 문제점을 해결하기 위해 진행된 전면적인 리팩터링 과정을 상세히 기술한다.

첫째, 데이터베이스 엔진을 전통적인 파일 기반 저장소에서 관계형 DBMS(MySQL)로 전환함으로써 트랜잭션 관리와 동시성 제어를 강화했다. ORM 프레임워크인 Hibernate/JPA를 활용해 객체‑관계 매핑을 자동화하고, 스키마는 ‘데이터셋’, ‘표’, ‘열’, ‘값’, ‘오차’, ‘단위’ 등으로 정규화된 테이블 구조를 채택했다. 이는 복잡한 실험 결과의 계층적 관계와 메타데이터(예: 촬영 조건, 분석 코드 버전)를 일관되게 저장할 수 있게 한다.

둘째, 백엔드 로직은 Java 기반의 Spring Framework 위에 구축되어 RESTful API를 제공한다. JSON과 XML 포맷을 동시에 지원함으로써 기존 HEP 툴(예: Rivet, Professor)과의 호환성을 유지하면서도 현대 웹·모바일 클라이언트가 손쉽게 데이터를 요청·파싱할 수 있다. 특히, ‘semantic data model’이라 명명된 새로운 데이터 표현은 각 측정값에 대한 물리량(예: 단면적, 파라미터)과 단위, 상관관계 행렬을 명시적으로 기술한다. 이는 자동 튜닝 및 머신러닝 기반 분석 파이프라인에서 메타데이터를 직접 활용할 수 있게 한다.

셋째, 프론트엔드는 React와 D3.js를 이용해 동적 시각화와 인터랙티브 검색을 구현한다. 사용자는 키워드, 실험명, 에너지, 관측량 등 다중 필터링을 통해 원하는 데이터셋을 빠르게 찾고, 그래프를 즉시 그려볼 수 있다. 또한, CSV, ROOT, YODA 등 다양한 포맷으로 다운로드가 가능해 기존 분석 흐름에 바로 삽입할 수 있다.

넷째, 데이터 수집 파이프라인은 자동 크롤러와 인간 검증 단계로 구성된다. 기존 논문 PDF에서 표와 그래프를 추출하는 OCR·텍스트 파싱 모듈을 개선하고, 추출된 메타데이터를 전문가가 검증·보완하도록 워크플로우를 설계했다. 이렇게 확보된 데이터는 버전 관리 시스템(Git)과 연동돼 변경 이력을 투명하게 기록한다.

마지막으로, 새로운 HepData는 Monte‑Carlo 튜닝 프레임워크와의 긴밀한 연동을 목표로 한다. Rivet 플러그인에서 직접 HepData API를 호출해 실험 데이터와 시뮬레이션 결과를 비교하고, Professor가 자동으로 파라미터 최적화를 수행할 때 필요한 ‘reference data set’으로 활용한다. 이러한 통합은 튜닝 파이프라인을 단일 소스에서 시작·종료하도록 하여 재현성을 크게 향상시킨다.

전반적으로 논문은 현대 소프트웨어 공학 원칙을 고에너지 물리 데이터 관리에 적용함으로써, 확장성·유연성·재현성을 동시에 만족하는 플랫폼을 구현한 점을 강조한다.

댓글 및 학술 토론

Loading comments...

의견 남기기