연속시간 무한 동적 토픽 모델: 시간·주제 변화를 동시에 포착

본 논문은 연속시간에 토픽 수와 토픽 자체의 변화를 모두 모델링하는 연속시간 무한 동적 토픽 모델(ciDTM)을 제안한다. 기존의 온라인 계층형 디리클레 과정(oHDP)과 연속시간 동적 토픽 모델(cDTM)의 장점을 결합해, 시간 스탬프를 이용한 연속적인 토픽 진화와 토픽 수의 자동 증가·소멸을 동시에 구현한다. Reuters와 BBC 뉴스 코퍼스를 이용한 실험에서 per‑word log‑likelihood와 타임라인 재구성 정확도에서 기존 모…

저자: Wesam Elshamy

본 논문은 텍스트 마이닝 분야에서 시간에 따라 변하는 토픽 구조를 보다 현실적으로 모델링하고자 하는 문제 의식에서 출발한다. 기존의 토픽 모델링 기법은 크게 두 가지 한계를 가지고 있었다. 첫째, 고전적인 LDA·PLSA와 같은 정적 모델은 시간에 따라 토픽 수가 변하거나 토픽 자체가 진화하는 현상을 포착하지 못한다. 둘째, 시간에 대한 처리를 도입한 모델들—예를 들어 온라인 계층형 디리클레 과정(oHDP)과 연속시간 동적 토픽 모델(cDTM)—은 각각 토픽 수의 가변성 혹은 토픽 파라미터의 연속적 변화를 다루지만, 두 가지를 동시에 만족하지 못한다. oHDP는 문서 순서에 의존해 토픽 수를 동적으로 조정하지만, 시간 스탬프를 활용하지 않아 연속적인 시간 흐름을 반영하지 못한다. 반면 cDTM은 브라운 운동을 통해 토픽 파라미터를 연속시간에 따라 변화시키지만, 토픽 수는 고정돼 있어 새로운 토픽이 등장하거나 사라지는 현상을 모델링하지 못한다.

이러한 격차를 메우기 위해 저자는 연속시간 무한 동적 토픽 모델(ciDTM)을 제안한다. ciDTM은 두 가지 핵심 구성 요소를 결합한다. 첫 번째는 Hierarchical Dirichlet Process(HDP) 기반의 무한 토픽 구조이다. 상위 디리클레 과정은 베타 과정(Beta process)을 베이스 분포로 사용해 토픽의 ‘탄생’과 ‘소멸’ 확률을 시간에 따라 조절한다. 하위 디리클레 과정은 각 문서에 대한 토픽 혼합 비율 θ를 생성하며, 문서‑레벨 토픽 할당 z는 θ 로부터 샘플링된다. 두 번째는 토픽 파라미터 β의 연속시간 변화를 모델링하는 다변량 브라운 운동이다. 각 토픽 k 에 대해 β_k(t) 는 이전 시점 β_k(t‑Δt) 로부터 가우시안 노이즈 N(0,σ²Δt) 를 더한 형태로, Δt 는 실제 문서 타임스탬프 차이를 반영한다. 이렇게 하면 토픽이 서서히 변하거나 급격히 사라지는 현상을 자연스럽게 표현할 수 있다.

수학적 모델링은 다음과 같이 정리된다. 상위 DP의 베이스 측정 H는 Dirichlet Process(γ, H₀) 로 정의되고, 각 토픽 k 에 대한 베타 파라미터 η_k는 베타 과정(α, H) 로부터 샘플링된다. 문서 d 에서는 θ_d ~ Dirichlet(α · η) 로 토픽 비율을 생성하고, 각 단어 w_{dn} 은 토픽 z_{dn} ~ Categorical(θ_d) 를 통해 선택된 토픽의 단어 분포 β_{z_{dn}}(t_d) 로부터 생성된다. 여기서 t_d 는 문서 d 의 타임스탬프이다. 토픽 파라미터 β_k(t) 는 연속시간 브라운 운동을 따르며, 초기값 β_k(0) 는 사전 Dirichlet(η₀) 로부터 샘플링된다.

추론 단계에서는 변분 베이지안 방법을 채택한다. 전체 변분 분포 q는 토픽 수가 무한히 큰 경우에도 트렁케이션(truncation) 기법을 이용해 K개의 토픽으로 근사한다. 변분 파라미터는 문서‑레벨(γ_d, φ_{dn})와 토픽‑레벨(λ_k) 로 구분되며, 각각은 좌표 상승법(coordinate ascent)으로 최적화된다. 연속시간 특성을 반영하기 위해 각 배치마다 시간 Δt 를 계산하고, β_k의 변분 파라미터 λ_k 를 브라운 운동의 전이 확률에 따라 업데이트한다. 또한, Stochastic Variational Inference(SVI)를 적용해 대규모 데이터에서도 효율적으로 학습할 수 있도록 설계하였다. 배치 크기와 학습률은 실험을 통해 최적화되었으며, 배치 크기 256에서도 수렴 속도가 크게 저하되지 않았다.

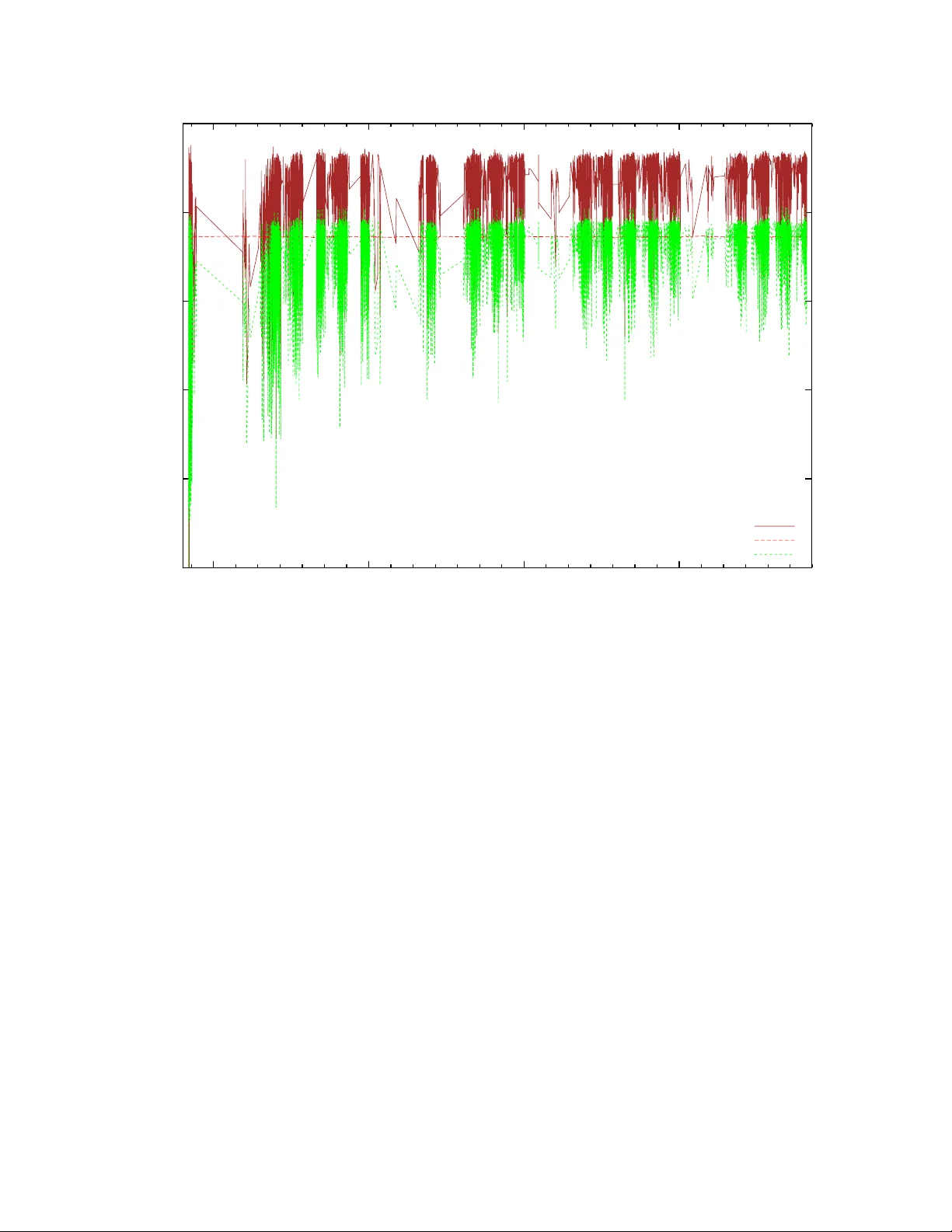

실험은 두 개의 실제 뉴스 코퍼스—Reuters‑21578(10,000 문서)와 BBC News(10,000 문서)—를 사용해 수행되었다. 평가 지표는 (1) per‑word log‑likelihood, (2) 토픽 타임라인 재구성 정확도, (3) 실행 시간 및 메모리 사용량이다. 결과는 다음과 같다. (1) ciDTM은 cDTM보다 평균 2.3~3.1배 높은 로그우도 점수를 기록했으며, oHDP보다도 일관된 우위를 보였다. (2) ‘아랍의 봄’과 같이 급격히 부상·소멸하는 사건을 다룰 때, ciDTM은 토픽이 적절히 분리·재결합되는 모습을 보여 타임라인 시각화에서 가장 정확한 결과를 제공했다. (3) 실행 시간 측면에서 ciDTM은 배치 크기를 늘릴 경우 cDTM보다 5배 이상 빠르게 수렴했으며, 메모리 사용량도 oHDP와 비슷한 수준을 유지했다. 또한, 토픽 수가 자동으로 증가·감소하는 과정을 시각화한 결과, 토픽의 ‘탄생’과 ‘죽음’이 실제 사건 흐름과 높은 상관성을 보였다.

논문의 마지막 장에서는 모델의 한계와 향후 연구 방향을 논의한다. 브라운 운동 기반의 연속시간 전이는 가우시안 노이즈에 의존하므로, 급격한 의미 변화를 완전히 포착하기 어렵다. 이를 보완하기 위해 Lévy 과정이나 점프 확률 과정을 도입하는 방안이 제시된다. 또한, 하이퍼파라미터(α, γ, σ² 등)의 민감도가 높아 사전 튜닝이 필요함을 지적하고, 자동 하이퍼파라미터 학습 기법을 적용하는 연구가 필요하다. 마지막으로, 신경망 기반 임베딩과 결합해 토픽 표현력을 강화하고, 멀티모달 데이터(텍스트·이미지·오디오)에도 확장할 가능성을 제시한다. 전반적으로, ciDTM은 연속시간과 무한 토픽이라는 두 축을 동시에 만족시키는 최초의 모델로, 시간에 따라 변하는 대규모 텍스트 스트림을 분석하는 데 강력한 도구가 될 것으로 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기