도메인 적대 신경망

본 논문은 소스와 타깃 도메인 간 차이를 최소화하도록 설계된 신경망 구조인 DANN(Domain‑Adversarial Neural Network)을 제안한다. 은닉층의 표현을 도메인 구분이 불가능하도록 만들면서, 소스 라벨을 이용한 분류 성능은 유지하도록 목표 함수를 정의하고, 적대적 학습을 통해 최적화한다. 실험 결과, 기존 신경망 및 SVM에 비해 감성 분석 벤치마크에서 우수한 전이 성능을 보였다.

저자: Hana Ajakan, Pascal Germain, Hugo Larochelle

**1. 서론**

라벨링 비용이 높은 실제 문제에서, 한 도메인(예: 영화 리뷰)에서 얻은 라벨 데이터를 다른 도메인(예: 도서 리뷰)으로 전이하려는 필요성이 대두된다. 기존 연구는 주로 선형 변환 기반의 도메인 적응(예: BDA, CORAL)이나, 잡음에 강인한 비선형 표현(mSDA) 등을 활용했지만, 이론적 근거가 부족하거나 표현이 도메인 차이를 완전히 없애지 못한다는 한계가 있었다.

**2. 도메인 적응 이론**

Ben‑David et al.이 제시한 H‑divergence는 두 도메인 간 차이를 가설 클래스 H가 얼마나 잘 구분할 수 있는지를 측정한다. 정리 2에 따르면, 목표 위험 R_T(η)는 소스 위험 R_S(η)와 경험적 H‑divergence \hat d_H(S,T) 사이의 합으로 상한이 잡힌다. 따라서 \hat d_H를 최소화하는 표현을 학습하면, 소스에서 좋은 성능을 보인 η가 타깃에서도 좋은 성능을 기대할 수 있다.

**3. DANN 모델 설계**

- **표현 층**: 입력 x를 은닉층 h(x)=σ(b+Wx)로 매핑한다.

- **분류기**: 소스 라벨을 이용해 f(x)=softmax(c+Vh(x))를 학습한다.

- **도메인 레귤레이터**: o(x)=σ(d+uᵀh(x))는 입력이 소스(1)인지 타깃(0)인지를 예측한다.

- **목표 함수**: 소스 분류 손실 L와 도메인 손실 L_d를 결합한다. 도메인 손실은 소스에 대해 최소화하고 타깃에 대해 최대화하도록 설계돼, 은닉 표현이 도메인 정보를 잃게 만든다. λ는 두 손실의 상대 중요도를 조절한다.

**4. 학습 알고리즘**

알고리즘 1은 미니배치 SGD를 기반으로, 매 반복마다 (소스, 타깃) 샘플을 하나씩 선택한다. 분류기 파라미터(W,V,b,c)는 일반적인 역전파로 손실을 최소화하고, 도메인 레귤레이터 파라미터(u,d)는 손실을 **극대화**하도록 업데이트한다. 이는 그라디언트 역전 층을 삽입한 것과 동일한 효과를 낸다. 조기 종료는 소스 검증 집합에서 위험이 최소가 되는 시점을 사용한다.

**5. 관련 연구와 차별점**

선형 기반 도메인 적응, mSDA와 같은 잡음 기반 비선형 방법, 그리고 최근의 적대적 학습(GAN) 등과 비교했을 때, DANN은 H‑divergence를 직접 최소화한다는 점에서 이론적 정당성을 갖는다. Huang & Yates(2012)의 HMM 기반 방법과는 달리, DANN은 신경망 전체를 대상으로 하는 전역적인 적대적 최적화를 수행한다.

**6. 실험**

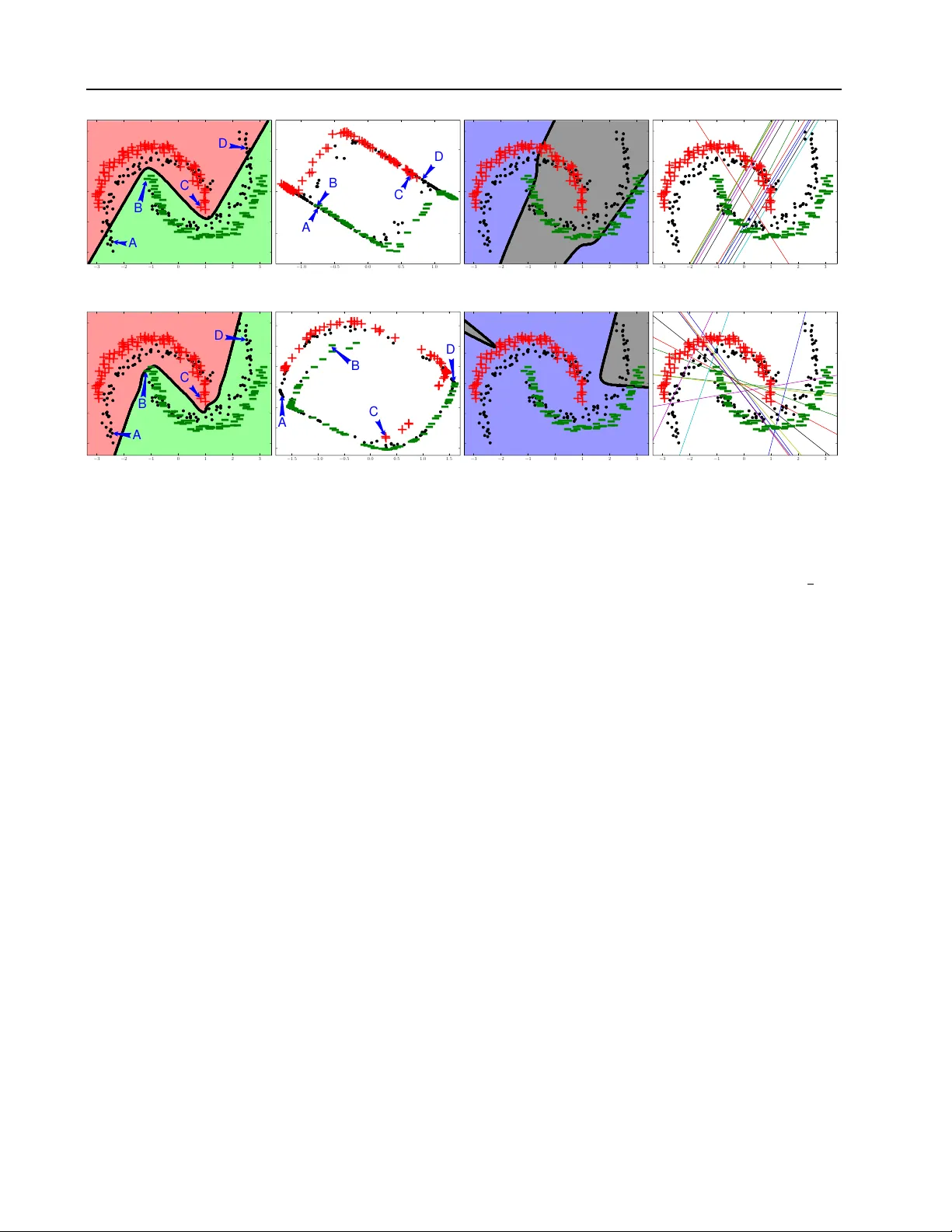

- **Toy 실험**: 2차원 가우시안 혼합 데이터를 사용해, DANN이 학습 후 은닉 표현이 두 도메인을 겹치게 만든 것을 시각화하였다.

- **감성 분석 실험**: Amazon 리뷰 데이터셋(Books, DVD, Electronics, Kitchen)에서 4가지 도메인 간 전이 실험을 수행했다. 베이스라인으로는 (i) 일반 신경망, (ii) SVM, (iii) mSDA 기반 신경망을 사용했다. DANN은 모든 전이 조합에서 평균 2~3%p의 정확도 향상을 기록했으며, 특히 mSDA 전처리와 결합했을 때 가장 높은 성능을 보였다.

- **분석**: λ 값에 따른 성능 변화를 조사했으며, λ가 너무 작으면 도메인 차이가 남고, 너무 크면 소스 분류 성능이 저하되는 것을 확인했다.

**7. 결론 및 향후 과제**

DANN은 도메인 적응 이론을 신경망 학습에 직접 연결함으로써, 기존 방법보다 일관된 성능 향상을 보여준다. 그러나 현재는 선형 도메인 레귤레이터에 의존하고, 단일 은닉층에 제한된 구조라는 점에서 확장성이 제한된다. 향후 연구에서는 (1) 다층 심층 네트워크에 적용 가능한 안정적인 그라디언트 역전 메커니즘, (2) 비선형 도메인 레귤레이터(예: 작은 CNN) 도입, (3) λ 자동 튜닝 및 도메인 불확실성 추정 등을 탐색할 필요가 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기