과학 애플리케이션을 위한 자가 적응형 자동 확장 방법

초록

본 논문은 HPC 클러스터와 퍼블릭·프라이빗 클라우드를 결합한 하이브리드 환경에서, 실행 중인 과학 애플리케이션이 마감 시간을 만족하도록 자동으로 작업을 분할·이동하고 클라우드 자원을 동적으로 확장하는 방법을 제안한다. 실시간 모니터링·예측 모델을 이용해 필요 시 클라우드 버스팅을 수행하고, 데이터와 계산을 부분적으로 이전해 전체 실행 시간을 단축한다. 지진(Seismic) 시뮬레이션을 사례로 하여 초기 실험 결과, 오버헤드는 존재하지만 마감 시간 달성에 유의미한 효과를 보였다.

상세 분석

이 연구는 전통적인 HPC 환경이 자원 포화·가용성 변동에 취약하다는 점을 출발점으로, 클라우드 버스팅과 자동 스케일링을 결합한 자기 적응 메커니즘을 설계하였다. 핵심은 (1) 애플리케이션 실행 시간을 단계별로 모니터링하고, 선형·로그 형태의 경험적 모델(Lcloud = ‑A ln c + B, Lcluster = ‑D ln c + E)로 향후 소요 시간을 예측한다는 점이다. (2) 예측된 남은 시간과 사용자가 지정한 마감 시간의 차이를 기반으로, 필요한 추가 코어 수를 계산하고, 클라우드와 클러스터 간 성능 차이를 보정하는 계수 K를 적용한다. (3) 계산된 코어 수와 도메인 분할 비율 γ를 이용해, 전체 데이터 영역을 두 부분으로 나누어 클라우드에 전송한다. 여기서 γ는 실행 시간과 선형 관계(t = aγ + b)로 모델링되어, 마감 시간 초과 시 자동으로 조정된다.

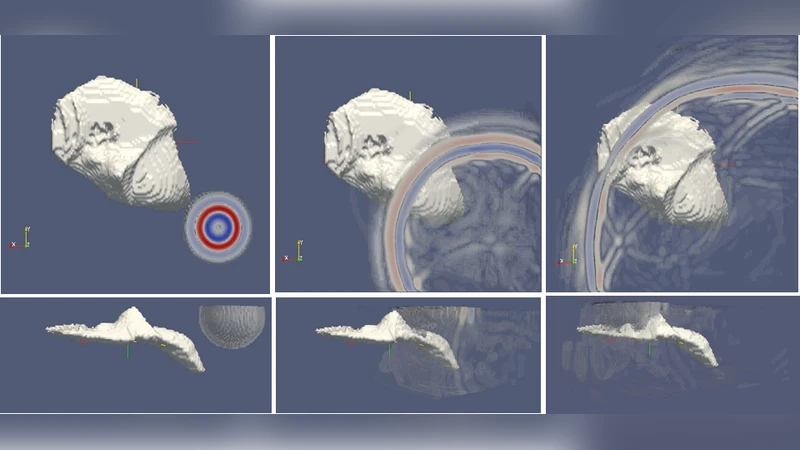

시스템 흐름은 8단계로 정리된다. 첫 단계에서 타임스텝별 실행 시간을 수집·분석하고, 마감 위협이 감지되면 현재 시뮬레이션 상태를 저장한다. 이후 필요한 클라우드 코어 수와 데이터 분할 크기를 산출하고, 해당 데이터를 클라우드 노드로 이동한다. 클러스터와 클라우드 양쪽에서 시뮬레이션을 재시작하고, 매 타임스텝마다 결과를 동기화·병합한다. 데이터 이동량은 21 KB 수준으로 매우 작아, 네트워크 오버헤드가 제한적이다.

실험은 IBM SoftLayer 프라이빗 클라우드와 온프레미스 클러스터(10 CPU / node)에서 수행되었으며, 대상 애플리케이션은 전파역학 기반 전파 전파 전산(FWI)이다. 실험 결과, 코어 수가 10에서 40으로 증가할 때 클라우드 환경의 실행 시간은 클러스터 대비 50 % 정도만 늘어났으며, 코어 수가 적을수록 클라우드의 상대적 성능 저하가 크게 나타났다. 이러한 특성을 이용해, 클러스터가 포화될 경우 클라우드에 부분 작업을 버스트함으로써 전체 실행 시간을 마감 시간 이하로 끌어내는 것이 가능했다.

또한, 자동 스케일링 로직은 사전 프로파일링 단계에서 얻은 경험적 파라미터(A, B, D, E, a, b)를 활용하므로, 새로운 애플리케이션에 적용하려면 초기 프로파일링만 수행하면 된다. 이는 HPC‑클라우드 연계 서비스 제공 시, 사용자에게 “실행 시간 보장”이라는 차별화된 SLA를 제공할 수 있는 기반이 된다.

한계점으로는 현재 구현이 단일 애플리케이션(데이터·태스크 병렬)과 정적 네트워크 환경에 최적화되어 있어, 복잡한 의존 관계를 가진 워크플로우나 변동성이 큰 네트워크 대역폭에서는 추가 연구가 필요하다. 또한, 클라우드 비용 모델을 고려한 비용‑성능 최적화는 본 논문에서 다루지 않았으며, 향후 연구 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기