시간 의존성을 모델링한 RNN DBN 기반 폴리포닉 음악 생성

초록

본 논문은 순환 신경망(RNN)의 메모리 기능과 깊은 신뢰 네트워크(DBN)의 고차원 표현 능력을 결합한 RNN‑DBN 모델을 제안한다. 이 모델은 시계열 데이터를 효과적으로 학습하여 폴리포닉 음악을 생성하며, 기존 RNN‑RBM 기반 방법보다 로그‑가능도 측면에서 경쟁력을 보인다.

상세 분석

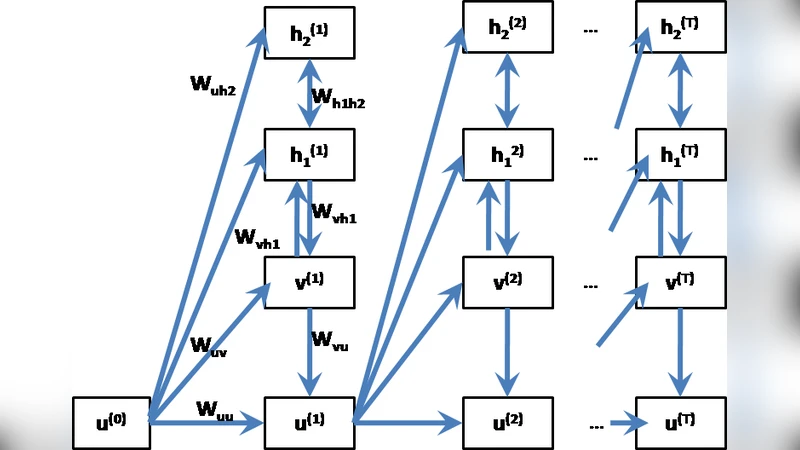

RNN‑DBN은 두 개의 주요 구성 요소로 이루어진다. 첫 번째는 전통적인 RNN 구조로, 시간 t‑1의 은닉 상태 u(t‑1)를 현재 입력 v(t)와 결합해 새로운 은닉 상태 u(t)=σ(Wvu·v(t)+Wuu·u(t‑1)+bu) 를 계산한다. 이 과정은 BPTT(Back‑Propagation Through Time)를 통해 파라미터가 업데이트되며, 시계열 의존성을 명시적으로 전달한다. 두 번째는 다층 DBN으로, 각 층은 RBM으로 사전 학습된 후 순차적으로 쌓여 깊은 확률 모델을 형성한다. DBN의 가시층은 88개의 바이너리 유닛으로 구성되어 피아노의 전체 음역(A0~C8)을 그대로 표현한다. 은닉층은 각각 150개의 바이너리 유닛을 갖는 두 층으로 설계돼, 복잡한 멜로디 구조와 화성 관계를 고차원 공간에 매핑한다.

학습 과정은 다음과 같이 진행된다. (1) 현재 시점의 RNN 은닉 상태 u(t)를 위 식에 따라 전파한다. (2) u(t)와 연관된 DBN 파라미터(b_h, b_v 등)를 고정된 u(t) 값을 조건으로 하여 각 RBM을 층별로 Greedy하게 학습한다. (3) 각 RBM에 대해 CD‑k(Contrastive Divergence) 알고리즘을 적용해 로그‑가능도 기울기를 추정한다. (4) DBN 파라미터에 대한 기울기를 BPTT와 결합해 RNN 파라미터까지 역전파한다. 이렇게 하면 RNN이 제공하는 시간적 컨텍스트와 DBN이 제공하는 고차원 데이터 표현이 동시에 최적화된다.

실험에서는 네 개의 공개 데이터셋(JSB Chorales, MuseData, Nottingham, Piano‑Midi.de)을 사용했으며, 모든 데이터는 전처리 없이 원시 바이너리 피아노 롤 형태로 입력했다. 모델은 2‑층 DBN(각 층 150 유닛)과 150 유닛 RNN을 사용했으며, 로그‑가능도(LL) 기준으로 기존 RNN‑RBM, RNN‑NADE, RTRBM 등과 비교했다. 결과는 RNN‑DBN이 대부분의 데이터셋에서 최상위 혹은 근접한 성능을 보이며, 특히 복잡한 화성 진행을 가진 JSB Chorales와 MuseData에서 좋은 결과를 얻었다. 논문은 전처리(키 변환, 템포 정규화)와 사전 학습(독립 RBM 초기화) 및 Hessian‑Free 최적화가 성능 향상에 크게 기여할 수 있음을 언급한다.

이 모델의 주요 장점은 (1) RNN이 제공하는 장기 의존성 메모리와 DBN이 제공하는 풍부한 표현력의 시너지, (2) 순수 바이너리 입력만으로도 높은 품질의 음악을 생성할 수 있는 일반성, (3) 기존 RNN‑RBM 대비 파라미터 효율성이 높아 학습 안정성이 향상된다는 점이다. 한계점으로는 학습 비용이 높고, 파라미터 초기화와 최적화 기법에 민감하다는 점을 들 수 있다. 향후 연구에서는 사전 학습 전략, 다양한 최적화 기법, 그리고 다른 시퀀스 생성 분야(예: 텍스트, 동작)로의 확장을 제안한다.

댓글 및 학술 토론

Loading comments...

의견 남기기