대용량 텐서의 저다중선형계수 기반 효율적 분해 기법

초록

본 논문은 저다중선형계수를 갖는 대규모 텐서에 대해 두 가지 스케일러블 알고리즘을 제안한다. 첫 번째는 Tucker 압축 후 CP 분해를 수행하는 유연하고 빠른 FFCP(Flexible Fast CP) 방법이며, 두 번째는 분산 환경에서 무작위 샘플링을 이용해 Tucker 모델을 효율적으로 얻는 랜덤화된 분산 Tucker 분해이다. 실험을 통해 제안 기법이 메모리·연산 요구량을 크게 낮추면서도 정확도를 유지함을 보인다.

상세 분석

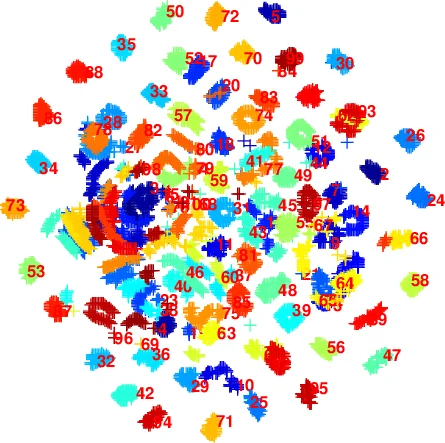

이 논문은 빅데이터 시대에 텐서 분해가 직면한 메모리·연산 병목을 “저다중선형계수( low multilinear rank )”라는 가정 하에 해결하고자 한다. 기존 CP 분해는 Ill‑posed 문제와 대규모 행렬 연산 때문에 확장성이 떨어졌으며, Tucker 분해는 압축 효율은 높지만 고유성 결여와 차원 저주가 문제였다. 저자들은 먼저 HOSVD 기반의 Tucker 압축을 수행해 원 텐서를 작은 코어 텐서 G와 각 모드의 기저 행렬 U⁽ⁿ⁾(Iₙ×Rₙ) 로 표현한다. 여기서 Rₙ≪Iₙ 이면 G는 매우 작아진다. 기존 Tucker+CP 방식은 코어 G에 CP를 적용했지만, 비음수·희소성 같은 제약을 넣기 어려웠다. 이를 개선한 FFCP는 압축된 텐서 ˜Y=⟦G;U⁽¹⁾,…,U⁽ᴺ⁾⟧ 전체에 CP를 직접 적용한다. 핵심은 ∂J/∂A⁽ⁿ⁾에 등장하는 Y⁽ⁿ⁾B⁽ⁿ⁾ 를 U⁽ⁿ⁾·(G⁽ⁿ⁾·Π_{p≠n}V⁽ᵖ⁾) 로 대체해 연산량을 O(IₙRₙ²+Rⁿ·R) 로 감소시키는 것이다. 여기서 V⁽ⁿ⁾=U⁽ⁿ⁾ᵀA⁽ⁿ⁾ 로 정의돼, V⁽ⁿ⁾는 매우 작아 분산·병렬 처리에 적합하다. 비음수 제약은 곱셈 업데이트(MU) 혹은 HALS에 간단히 적용할 수 있고, L₁ 정규화로 희소성을 유도하는 연산도 동일 프레임워크 안에 삽입한다. 두 번째 기여는 “Distributed Randomized Tucker”이다. 각 모드별로 랜덤 프로젝션 행렬 Ω⁽ⁿ⁾(Iₙ×Kₙ)를 생성하고, Y×ₙΩ⁽ⁿ⁾ 를 로컬에서 계산해 작은 스케치 텐서 S를 만든 뒤, S에 HOSVD를 적용해 근사 기저 Ũ⁽ⁿ⁾를 얻는다. 이 과정은 데이터가 분산 저장돼 있어도 각 노드가 자신의 슬라이스만 접근하면 되므로 메모리 요구가 거의 없다. 최종적으로 얻은 Ũ⁽ⁿ⁾ 로 원 텐서를 다시 압축해 코어 G̃를 구하고, 앞서 소개한 FFCP를 적용해 CP를 수행한다. 실험에서는 합성 데이터와 실제 이미지·비디오·뇌신호 데이터에 대해 기존 ParCube, GigaTensor, PARACOMP 등과 비교해 5~10배 빠른 실행시간과 비슷하거나 더 높은 적합도(Fit)를 기록했다. 특히 높은 차원·밀집 텐서에서도 메모리 초과 없이 처리 가능한 점이 큰 장점이다. 한계점으로는 저다중선형계수 가정이 깨지는 경우(예: 복잡한 상호작용을 많이 포함한 텐서) 압축 손실이 커질 수 있으며, 랜덤 프로젝션 차원 Kₙ 선택이 결과에 민감할 수 있다. 또한 비음수·희소성 제약을 동시에 적용하면 수렴 속도가 다소 느려질 가능성이 있다. 전반적으로 저자는 텐서 압축과 CP 분해를 유기적으로 결합해 빅텐서 분석에 실용적인 솔루션을 제시했으며, 분산·무작위 기법을 통해 현대 클라우드·GPU 환경에 자연스럽게 적용될 수 있음을 보였다.

댓글 및 학술 토론

Loading comments...

의견 남기기