전체 이미지 회귀를 위한 하프 CNN 프레임워크

초록

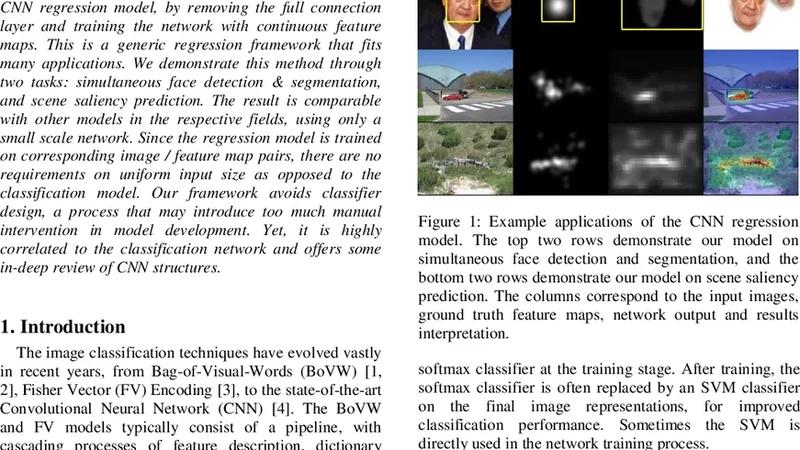

본 논문은 전통적인 이미지 분류용 CNN에서 완전 연결 층을 제거하고, 연속적인 특성 맵을 직접 회귀하도록 설계한 ‘Half‑CNN’ 모델을 제안한다. 입력 크기 제약이 없으며, 얼굴 검출·분할과 장면 살리엔시 예측 두 가지 과제에 적용해 소규모 네트워크로도 경쟁력 있는 성능을 입증한다.

상세 분석

Half‑CNN은 기존 분류용 CNN 구조를 그대로 유지하면서, 마지막 완전 연결(FC) 레이어를 생략하고 대신 2차원 연속 출력 맵을 생성하도록 설계되었다. 이는 이미지‑특성 맵 쌍을 학습 데이터로 사용함으로써, 픽셀 단위의 회귀 문제를 직접 해결한다는 점에서 기존의 “분류 → 후처리” 파이프라인과 근본적으로 다르다.

첫 번째 핵심 아이디어는 ‘전역 풀링’이나 ‘고정 입력 크기’ 요구를 없애는 것이다. 컨볼루션과 풀링 연산만으로 구성된 네트워크는 입력 이미지의 가변 크기를 그대로 유지하면서, 마지막 레이어에서 원하는 해상도의 특성 맵을 출력한다. 이때 출력 채널 수는 문제에 따라 자유롭게 정의할 수 있어, 이진 마스크(예: 얼굴 영역)부터 연속적인 살리엔시 값까지 다양한 형태의 지도 학습이 가능하다.

두 번째로, 손실 함수는 회귀 특성에 맞게 L2(Mean Squared Error) 혹은 L1 손실을 사용한다. 이는 픽셀 단위의 차이를 직접 최소화하므로, 경계가 부드러운 세그멘테이션이나 연속적인 밝기 예측에 적합하다. 또한, 네트워크가 깊어질수록 리셉티브 필드가 확대돼 전역적인 컨텍스트를 포착할 수 있다. 이는 특히 장면 살리엔시와 같이 전역적인 시각적 주의 정보를 필요로 하는 작업에 유리하다.

세 번째로, 파라미터 효율성이다. FC 레이어를 제거함으로써 파라미터 수가 급격히 감소하고, 메모리 사용량과 학습 시간도 크게 줄어든다. 논문에서는 VGG‑16 기반의 작은 변형 모델을 사용했음에도 불구하고, 기존 최첨단 모델과 비슷한 정밀도를 달성했다. 이는 실시간 응용이나 모바일 디바이스에 적용하기에 매력적인 특성이다.

네 번째로, 학습 과정에서 데이터 증강과 정규화 기법이 중요한 역할을 한다. 입력 이미지에 회전·스케일·색상 변형을 적용하고, 배치 정규화와 드롭아웃을 결합해 과적합을 방지한다. 또한, 출력 맵의 스케일을 맞추기 위해 정규화된 라벨을 사용함으로써, 손실 함수가 안정적으로 수렴하도록 돕는다.

마지막으로, 제한점도 존재한다. 출력 해상도가 입력에 비해 크게 감소하면 세부 정보가 손실될 수 있으며, 이를 보완하기 위해 디코더 단계(업샘플링·스킵 연결)를 추가하는 것이 일반적이다. 그러나 논문에서는 순수히 컨볼루션만으로도 충분한 성능을 보였으며, 이는 모델 설계의 간결함을 강조한다. 전반적으로 Half‑CNN은 “분류 → 회귀”라는 전통적 흐름을 뒤집어, 직접적인 이미지‑투‑맵 회귀를 가능하게 하는 유연하고 효율적인 프레임워크라 할 수 있다.