딥 스피치 엔드투엔드 음성 인식 확장

초록

본 논문은 다중 GPU와 대규모 합성 데이터를 활용해 5계층 RNN(양방향 ReLU 기반)을 학습함으로써, 전통적인 파이프라인 없이도 Switchboard Hub5’00에서 16.0% WER, 잡음 환경에서는 19.1% WER를 달성한 엔드투엔드 음성 인식 시스템 ‘Deep Speech’를 제안한다.

상세 분석

Deep Speech는 전통적인 음성 인식 파이프라인(특징 추출, HMM, 발음 사전 등)을 완전히 배제하고, 스펙트로그램을 입력으로 받아 문자 수준 확률을 직접 출력하는 단일 RNN 모델을 설계하였다. 모델은 5개의 층으로 구성되며, 앞의 세 층은 완전 연결된 비순환 레이어, 네 번째는 양방향 순환 레이어, 마지막은 비순환 출력 레이어이다. 순환 레이어는 ReLU 활성화 함수를 사용하고, 상한값 20으로 클리핑해 폭발적인 값 증가를 방지한다. LSTM 대신 단순 ReLU를 채택한 이유는 GPU에서 BLAS 연산과 포인트와이즈 연산만으로 구현이 가능해 연산 효율성을 크게 높일 수 있기 때문이다.

학습에는 Connectionist Temporal Classification(CTC) 손실을 적용해 시간 정렬이 없는 라벨을 직접 활용한다. 최적화는 Nesterov 가속 경사법을 사용하고, 0.99의 모멘텀과 단계적 학습률 감소 전략을 적용한다. 과적합 방지를 위해 5~10% 수준의 드롭아웃을 비순환 층에만 적용하고, 입력 오디오를 ±5 ms씩 시프트하는 jitter 기법을 도입해 데이터 다양성을 인위적으로 확대하였다. 테스트 시에는 여러 모델을 앙상블하고, 각 모델의 출력 확률을 평균해 최종 결과를 얻는다.

언어 모델은 대규모 텍스트 코퍼스(2억 2천만 구문, 495 k 단어)로 학습한 N‑gram 모델을 사용한다. 디코딩 단계에서는 RNN 출력 확률과 언어 모델 확률을 가중합한 후, beam size 1 000~8 000의 빔 서치를 수행한다. α와 β 파라미터는 교차 검증으로 최적화한다.

데이터 측면에서 저자는 5 000시간 규모의 자체 수집 음성(9 600명 화자)과 공개 데이터(WSJ, Switchboard, Fisher)를 결합하고, 잡음 강인성을 높이기 위해 음성 신호와 다양한 잡음(배경음, 회향, Lombard 효과 등)을 선형 합성하는 방식을 도입했다. 합성 잡음은 실제 환경을 모사하도록 SNR을 조절하고, 다채로운 잡음 소스를 무작위로 섞어 데이터 다양성을 극대화한다.

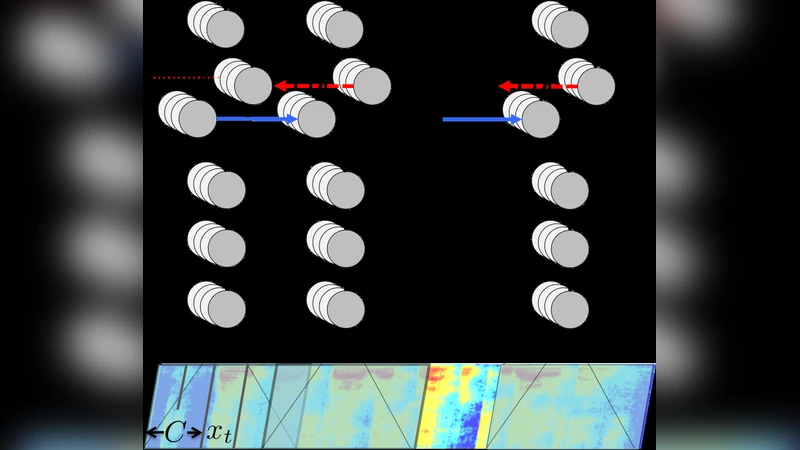

훈련 효율을 위해 두 단계의 병렬화를 적용한다. 첫 번째는 각 GPU가 수천 개의 샘플을 한 번에 처리하는 데이터 병렬화이며, 샘플 길이가 다르면 길이별로 정렬해 동일 길이 배치를 만든다. 두 번째는 모델 병렬화로, 순환 레이어를 시간축 절반으로 분할해 두 GPU가 앞쪽과 뒤쪽을 동시에 계산하고 중간에 활성값을 교환한다. 이 방식은 순환 연산의 순차성을 유지하면서도 GPU 간 통신량을 최소화한다. 또한 입력을 2배 스트라이드(striding) 처리해 시간 단계 수를 절반으로 줄여 연산량을 감소시켰다.

실험 결과, Deep Speech는 Switchboard Hub5’00 전체 테스트 세트에서 16.0% WER를 기록해 기존 최고 기록(17.0% 수준)을 앞섰으며, 자체 구축한 잡음 데이터셋에서는 19.1% WER를 달성해 상용 상용 시스템(30.5% WER)보다 현저히 우수한 성능을 보였다. 이는 대규모 데이터, 효율적인 다중 GPU 학습, 그리고 잡음 합성 전략이 결합된 결과로 해석된다.

이 논문은 음성 인식에서 엔드투엔드 딥러닝이 전통적인 복잡한 파이프라인을 대체할 수 있음을 실증적으로 보여주며, 특히 데이터와 연산 자원이 충분할 때 모델 단순화와 성능 향상이 동시에 가능함을 증명한다. 향후 연구는 더 깊은 순환 구조(LSTM/GRU)와 Transformer 기반 모델을 동일한 대규모 병렬 인프라에 적용해 성능 한계를 탐색하는 방향으로 진행될 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기