GloVe와 word2vec의 목표 연결 고리

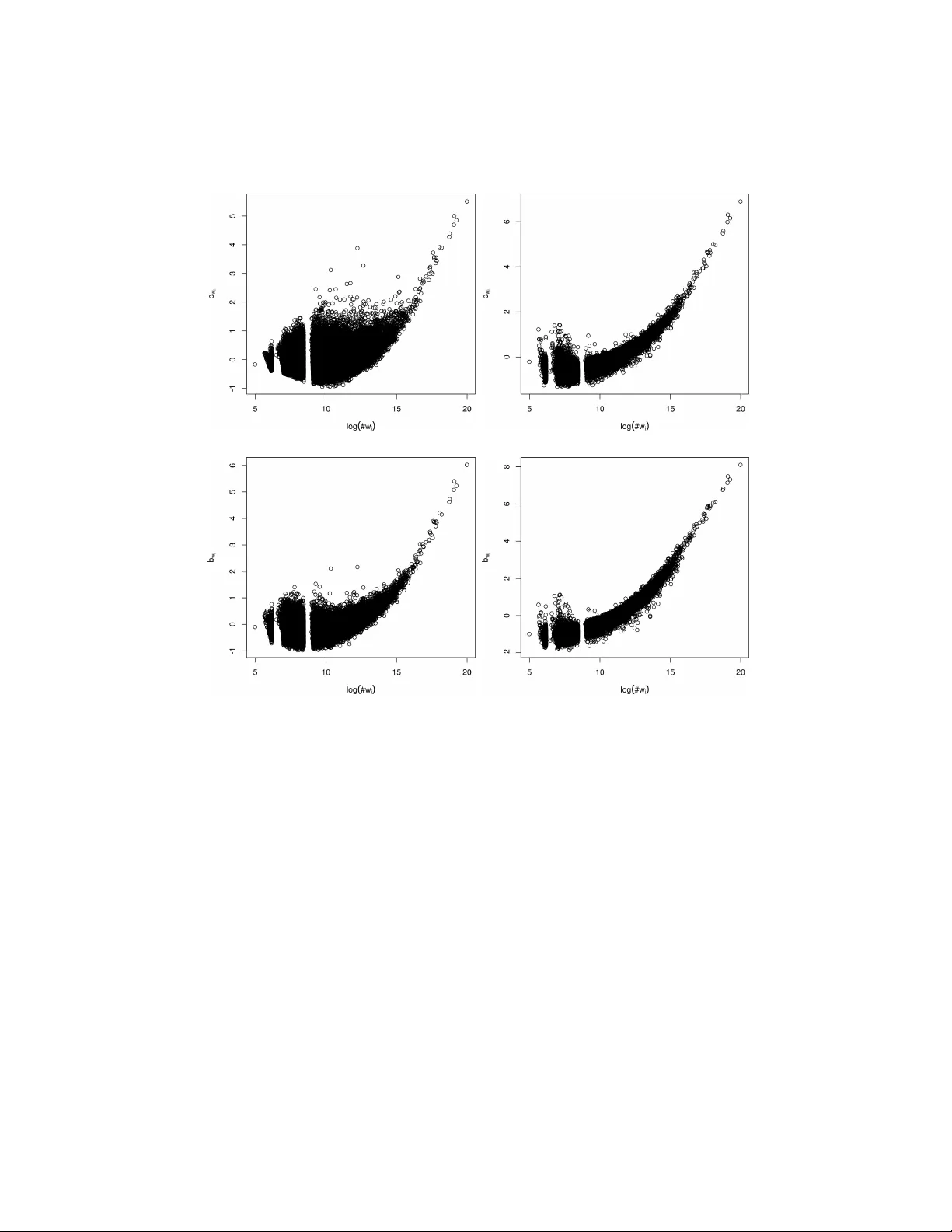

본 논문은 GloVe와 word2vec의 skip‑gram with negative sampling(SGNS) 모델이 공유하는 목표 함수를 비교·분석한다. 두 모델이 각각 다른 비용 함수와 가중치 전략을 사용하지만, SGNS의 목표가 GloVe의 특수 형태와 수학적으로 유사함을 보이며, 특히 편향(bias) 항이 로그 빈도와 연결되는 점을 실험적으로 확인한다.

저자: Tianze Shi, Zhiyuan Liu

본 논문은 GloVe와 word2vec의 skip‑gram with negative sampling(SGNS) 모델이 공유하는 학습 목표를 수학적으로 분석하고, 두 모델 사이의 유사점과 차이점을 명확히 규정한다. 서론에서는 단어와 컨텍스트를 각각 V_W, V_C 라는 어휘 집합으로 정의하고, 각 단어 w와 컨텍스트 c에 대해 d 차원의 임베딩 벡터 ŵ, ĉ를 학습하는 일반적인 목표를 제시한다. 공동 발생 횟수 #(w,c)와 전체 빈도 #(w), #(c) 등을 이용해 행렬 형태로 표현한다.

첫 번째 섹션에서는 GloVe 모델을 소개한다. GloVe는 공동 발생 행렬을 직접 팩터화하며, 손실 함수 L_G(w_i,c_j)=f(#(w_i,c_j))·(w_i·c_j + b_{w_i}+b_{c_j}−log #(w_i,c_j))² 로 정의한다. 여기서 f(x)는 희소한 공동 발생을 억제하기 위한 가중치 함수이며, 논문에서는 f(x)= (x/x_max)^α (x

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기