단어 연관성을 반영한 라티스 디리클레 할당 모델

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

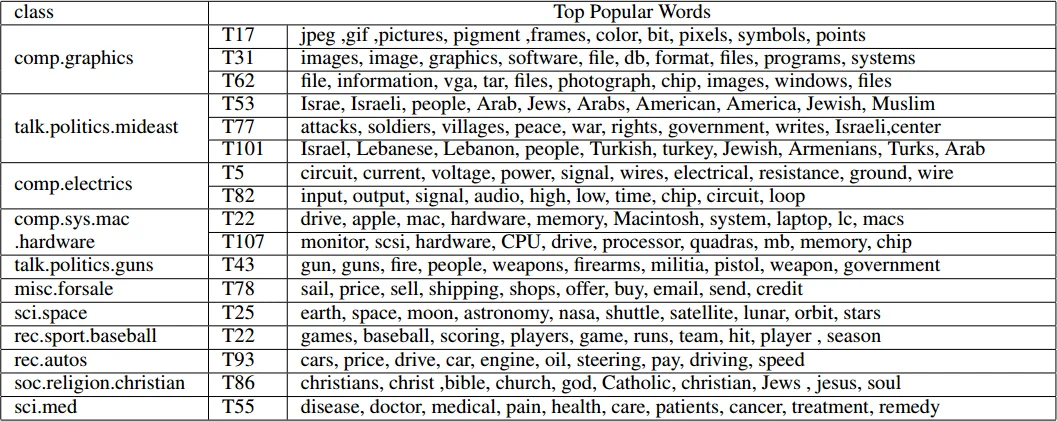

WR‑LDA는 단어 간 의미적 유사성을 그래프 형태의 정규화 항으로 LDA에 통합해, 토픽 할당 시 단어 독립성을 완화한다. 로그우도와 손실 함수를 λ로 가중합한 목표함수를 최적화하며, 변분 EM 과정에서 β 파라미터는 뉴턴‑라프슨과 그래프 조화 평활을 결합해 업데이트한다. 20 Newsgroups, 호텔 리뷰, 중‑영 병렬 코퍼스 실험에서 토픽 일관성·예측 정확도가 기존 LDA보다 우수함을 입증한다.

상세 분석

WR‑LDA는 기존 LDA가 “단어‑주제 할당이 서로 조건부 독립”이라는 근본적인 가정을 깨뜨리려는 시도이다. 논문은 먼저 단어 집합 V 를 정점, 의미적 유사도 κ₍w,w’₎ 를 가중치로 하는 무향 그래프 G=(V,E)를 정의한다. 이때 κ는 사전 구축된 동의어 사전, Word2Vec 유사도, 혹은 번역 사전 등 다양한 소스로부터 얻을 수 있다.

핵심 아이디어는 “유사한 단어는 동일 토픽에서 생성될 확률 분포가 비슷해야 한다”는 가정 하에, 토픽‑단어 분포 βₖ (k=1…K)를 그래프 조화 함수 R(β)=½∑₍w,w’₎∑ₖ κ₍w,w’₎(βₖw−βₖw’)² 로 규제하는 것이다. R(β)는 두 단어가 유사할수록 βₖw와 βₖw’ 사이의 차이를 크게 벌점(penalty)한다.

목표함수 O(α,β)=λ·L(α,β)−(1−λ)·R(β) 로 정의하고, λ∈

댓글 및 학술 토론

Loading comments...

의견 남기기