차이 엔트로피를 이용한 시계열 복잡도 측정

초록

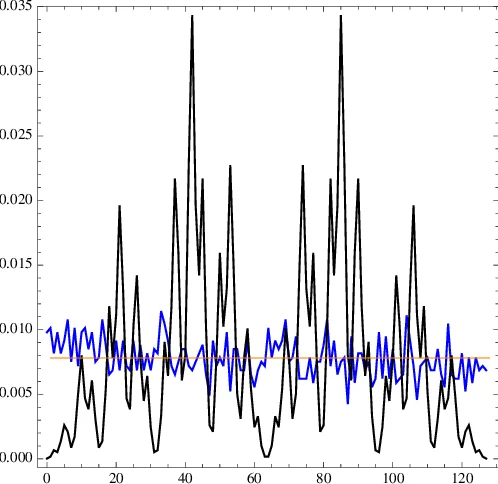

본 논문은 시계열 데이터의 복잡성을 평가하기 위해 인접값 차이의 부호만을 이용한 “차이 엔트로피(Entropy of Difference, ED)”를 제안한다. 기존의 순열 엔트로피(PE)와 수정 순열 엔트로피(mPE)보다 패턴 수가 적어 샘플 요구량이 감소하고, 무작위 신호와의 Kullback‑Leibler(KL) 발산을 직접 계산할 수 있다. 로지스틱 맵과 실제 금융 데이터에 적용해 ED와 KL 발산이 복잡도와 비정상성을 효과적으로 구분함을 보였다.

상세 분석

본 연구는 시계열 분석에서 널리 사용되는 순열 엔트로피(Permutation Entropy, PE)와 그 변형인 수정 순열 엔트로피(mPE)의 한계를 지적한다. PE는 m‑차원 임베딩을 통해 m!개의 순열을 생성하고, 각 순열의 출현 빈도로 확률분포를 만든 뒤 샤논 엔트로피를 계산한다. 그러나 m이 커질수록 가능한 순열 수가 급격히 증가해 충분한 데이터가 없으면 확률 추정이 불안정해진다. 또한, 무작위 신호에 대한 기준 분포가 균등(1/m!)이므로 실제 신호와 무작위 신호 사이의 거리, 즉 KL 발산을 정의하기 어렵다.

차이 엔트로피(ED)는 이러한 문제를 해결하기 위해 인접값 차이의 부호만을 사용한다. 임베딩 차원 m에 대해 각 m‑튜플을 (m‑1)개의 부호 문자열 s∈{‘+’,‘-’}^{m‑1} 로 변환한다. 부호 문자열의 총 개수는 2^{m‑1}으로, PE의 m!에 비해 훨씬 작다. 예를 들어 m=4이면 2^{3}=8개의 문자열만 존재한다. 이렇게 축소된 상태공간은 작은 샘플에서도 안정적인 확률 추정이 가능하게 한다.

무작위 신호에 대한 부호 문자열의 확률 q_m(s)는 단순히 1/2^{m‑1}이 아니라, 연속된 차이 부호가 독립이 아니므로 복잡한 재귀식(논문의 식(1))을 통해 계산된다. 이 q_m(s)를 이용해 실제 데이터의 분포 p_m(s)와 비교하면 KL 발산 KL_m(p‖q)=∑_s p_m(s) log

댓글 및 학술 토론

Loading comments...

의견 남기기