깊은 방향성 생성 오토인코더

이 논문은 이산 데이터에 대해 확률을 정확히 분해하는 새로운 모델인 Directed Generative Autoencoder(DGA)를 제안한다. 인코더 f와 확률적 디코더 P(X|H)를 결합해 로그우도 하한을 최적화하고, 직관적인 “직통(스트레이트‑스루)” 그라디언트 추정기로 인코더 파라미터를 학습한다. 층을 쌓아 사전학습하고 annealing 기법을 적용하면 깊은 구조에서도 효과적으로 학습할 수 있다.

저자: Sherjil Ozair, Yoshua Bengio

본 논문은 이산 데이터에 대한 확률 모델링을 새로운 관점에서 접근한다. 기존의 생성 모델들은 복잡한 데이터 분포를 직접 모델링하려다 보니 고차원에서 확률 질량이 데이터 매니폴드 밖에 과도하게 퍼지는 문제에 직면한다. 저자는 이 문제를 “매니폴드 펼치기(manifold unfolding)”라는 기하학적 아이디어로 해결하고자 한다. 매니폴드가 고차원 입력 공간에서 꼬이고 얽혀 있을 때, 이를 적절한 인코더 f 를 통해 변환하면 매니폴드가 평탄해지고, 그 결과 인코딩된 공간 H 에서 확률 분포가 단순하고 독립적인 형태(예: 팩터화된 베르누이)로 근사될 수 있다.

이를 수식적으로 정리하면, 결정적 인코더 f 와 확률적 디코더 P(X|H) 를 이용해

\(P(X=x)=P(X=x\mid H=f(x))\;P(H=f(x))\)

라는 정확한 분해가 가능함을 보인다. 여기서 첫 번째 항은 전통적인 오토인코더의 재구성 로그우도와 동일하고, 두 번째 항은 인코딩된 표현 h 에 대한 사전 로그우도이다. 두 항을 동시에 최대화하면 (i) 인코더가 입력 정보를 거의 손실 없이 보존하고, (ii) 인코딩된 표현이 단순한 사전 분포와 잘 맞아 생성 모델링이 쉬워진다.

학습 목표는 위 두 로그우도의 합을 최대화하는 것이며, 이는 실제 로그우도에 대한 하한을 제공한다. 이 하한은 P(X|H) 가 충분히 표현력을 가질 때 정확히 원본 로그우도와 일치한다. 실제로는 파라미터화된 P(X|H) 가 완전한 제약을 만족하지 못하더라도, 하한을 최적화함으로써 점진적으로 원본 로그우도에 접근한다.

하지만 인코더 f 가 이산(0/1) 출력을 가지므로 전통적인 역전파가 불가능하다. 저자는 Hinton이 제안한 “Straight‑Through” 기법을 활용한다. 구체적으로, 인코더 전활성 a 에 대해 f_i(x)=1_{a_i(x)>0} 로 이산화하고, 손실 L 에 대해 ∂L/∂f(x) 를 연속 변수처럼 계산한다. 그 값을 그대로 ∂L/∂a 에 할당해 의사‑그라디언트로 사용한다. 이 방법은 기울기의 부호는 정확히 유지하면서, magnitude는 근사한다. 실험 결과, 이 간단한 추정법이 학습을 안정화시키고 좋은 성능을 보였다.

모델 구조는 인코더와 디코더 모두 다층 신경망으로 구현될 수 있다. 깊은 구조를 학습하기 위해 저자는 두 가지 전략을 도입한다. 첫째, **그리디 사전학습**이다. 각 레이어를 얕은 DGA로 독립적으로 학습한 뒤, 위로 쌓아 올린다. 둘째, **Annealed Training**이다. 손실 함수에 두 개의 가중치 β₁, β₂ (재구성 손실과 사전 손실에 대한 가중치)를 도입하고, 초기에는 사전 가중치를 0에 가깝게 두어 순수 오토인코더처럼 학습한다. 이후 점진적으로 사전 가중치를 증가시켜 인코더가 H 공간을 사전 분포에 맞추도록 유도한다. 이 연속적인 전이 과정은 최적화 난이도를 크게 낮추며, 깊은 네트워크에서도 안정적인 수렴을 가능하게 한다.

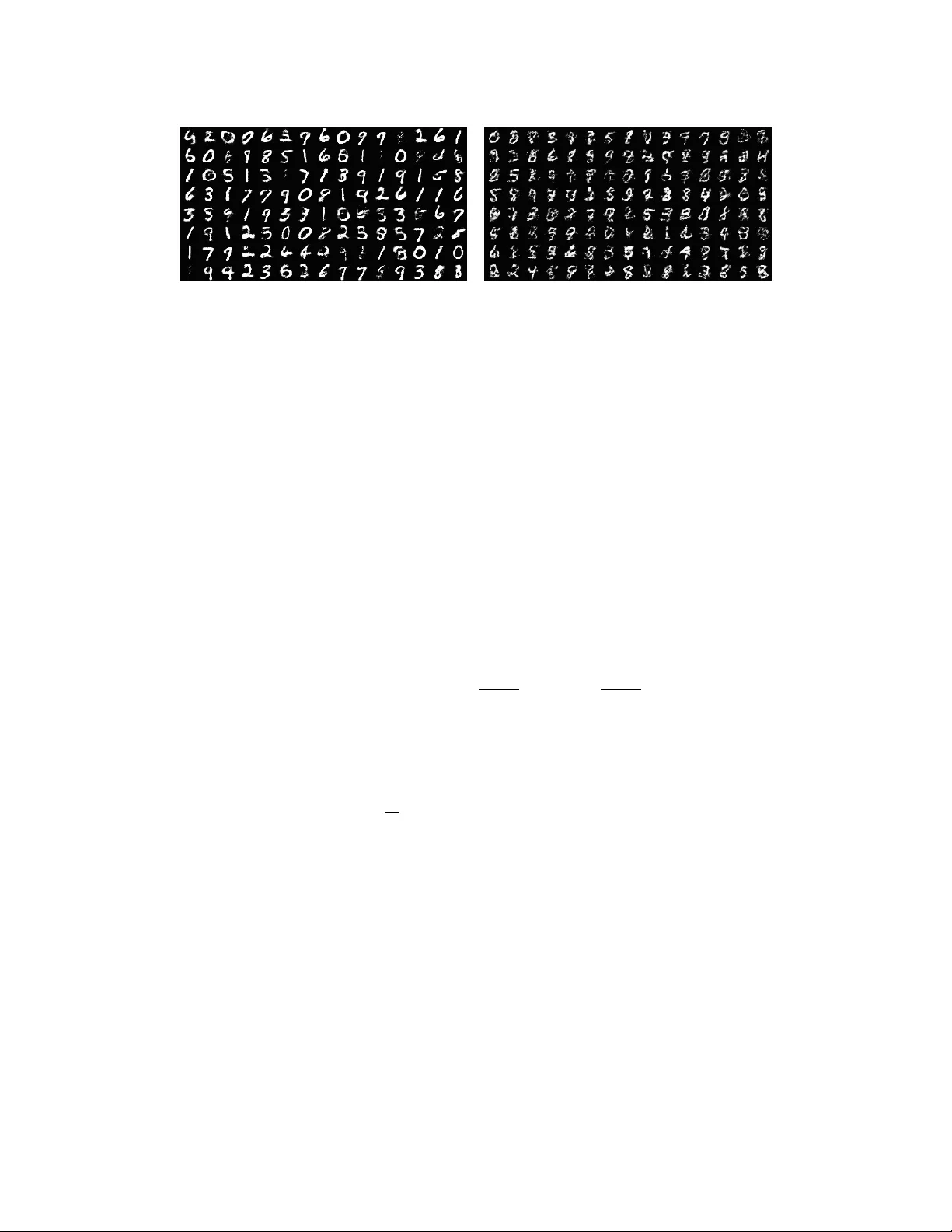

실험에서는 이산화된 MNIST 데이터에 대해 단일 레이어 DGA와 스택된 DGA를 비교하였다. 단일 레이어는 재구성 손실은 낮지만 사전 로그우도가 낮아 전체 하한이 제한적이었다. 반면, 2~3 레이어를 스택하고 annealing을 적용한 DGA는 사전 로그우도가 크게 향상되어 전체 로그우도 하한이 크게 증가하였다. 또한, 학습된 P(H) 에서 샘플을 추출하고 P(X|H) 를 통해 복원하면, 실제 데이터와 구분하기 어려운 새로운 이산 이미지가 생성되었다.

이 접근법은 변분 오토인코더(VAE)와 비교했을 때 몇 가지 차별점을 가진다. VAE는 연속 잠재변수를 가정하고 KL 발산을 최소화하지만, DGA는 이산 잠재변수와 명시적인 사전 P(H) 를 직접 학습한다. 또한, DGA는 재구성 손실을 정확히 로그우도로 해석하고, 사전 손실을 별도의 확률 모델링으로 분리함으로써 이론적 해석이 명확하다.

결론적으로, 논문은 “인코더가 데이터를 평탄한 매니폴드로 펼치면, 간단한 사전 분포만으로도 복잡한 데이터 분포를 효과적으로 모델링할 수 있다”는 직관을 수학적으로 정립하고, 이를 구현하기 위한 실용적인 학습 알고리즘(스트레이트‑스루 그라디언트, 사전학습, annealing)을 제시한다. 향후 연구에서는 연속 데이터에 대한 확장, 더 복잡한 사전 모델(예: 흐름 기반 모델)과의 결합, 그리고 샘플 품질 향상을 위한 고급 디코더 설계 등이 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기