강력한 증분 수리 탐지 시스템 STIR

초록

본 논문은 대화 음성 전사에서 말의 중단·수정(수리)을 최소 지연으로 탐지하는 STIR 시스템을 제안한다. n‑gram 기반 정보이론적 특징을 활용한 단계별 분류기 파이프라인으로, 기존 최첨단 방법과 동등한 최종 정확도를 유지하면서 증분 정확도, 탐지 지연, 연산 비용 면에서 우수함을 보인다. 또한 새로운 증분 평가 지표와 평가 기준을 제시한다.

상세 분석

STIR은 “강력한 증분(Strongly Incremental)”이라는 설계 목표에 따라, 발화가 진행되는 동안 가능한 한 빨리 수리 구간을 식별하고, 그 구조까지 추론한다는 점에서 기존 연구와 차별화된다. 핵심 아이디어는 전통적인 노이즈 채널 모델이 전역적인 문자열 정렬에 의존하는 반면, 인간 청자가 수리 시작을 감지하는 과정은 국소적인 유창성(Fluency) 저하와 편집어(Interregnum) 출현에 크게 좌우된다는 심리언어학적 근거를 차용한 것이다. 이를 위해 저자들은 다음과 같은 네 가지 정보이론적 특징을 설계하였다.

- Surprisal(놀라움)와 Weighted Mean Log (WML) – 트라이그램 언어 모델에서 각 단어의 로그 확률을 역수 가중치와 결합해, 어휘 빈도와 구문적 예측 가능성을 분리한다. 급격한 Surprisal 상승은 수리 시작(rp_start) 후보를 생성한다.

- Entropy(엔트로피)와 KL‑Divergence – 현재 컨텍스트에서 가능한 다음 단어들의 확률 분포 엔트로피를 계산해, 불확실성이 급증하면 reparandum(수리 전 구간) 경계가 의심된다. 또한 reparandum와 repair 구간 사이의 확률 분포 차이를 KL‑Divergence로 측정해 repair 종료(rp_end)를 판단한다.

- Back‑wards Search – 수리 시작이 감지되면 역방향 탐색을 수행해 가장 가능성 높은 reparandum 시작(rm_start)을 찾는다. 이는 발화 길이가 늘어날수록 청자가 과거 단어를 추적하는 비용이 기하급수적으로 증가한다는 실증 연구를 반영한다.

- Edit‑Term Language Model – “uh”, “um”, “I mean” 등과 같은 편집어를 별도 언어 모델로 학습해, T1 단계에서 edit term 자체를 먼저 탐지한다. 이는 수리 구간을 보다 명확히 구분하는 데 기여한다.

STIR은 위 특징들을 각각 전용 분류기(주로 로지스틱 회귀 또는 SVM)로 학습시킨 뒤, 파이프라인 형태로 순차 적용한다. T1에서 edit term을 탐지하고, T2에서 급격한 Surprisal 상승을 통해 rp_start를 예측한다. T3에서는 역방향 탐색과 엔트로피 감소 패턴을 이용해 rm_start를 확정하고, 최종 T4에서 KL‑Divergence와 WML을 결합해 rp_end와 전체 수리 구조(삭제, 삽입, 대체)를 결정한다.

연산 복잡도 측면에서 STIR은 전통적인 차트 기반 파서가 O(n⁴)~O(n⁵) 수준의 탐색 공간을 필요로 하는 반면, 단계별 로컬 특징만을 사용함으로써 실시간 처리에 적합한 O(n) 수준의 비용을 달성한다. 또한 빔 서치나 다중 가설 유지가 필요 없으므로 ‘jitter’ 현상이 최소화되어, 중간 결과의 안정성이 크게 향상된다.

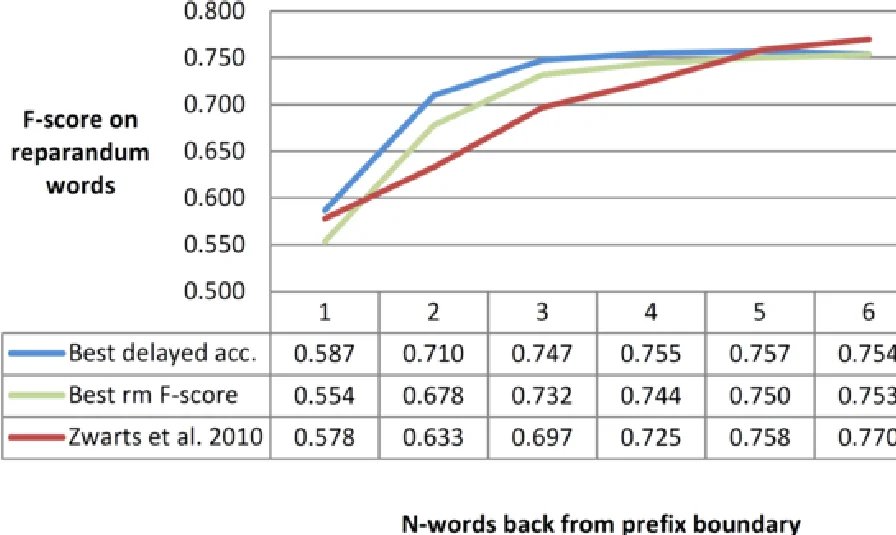

평가에서는 Switchboard 디스플루언시 태깅 코퍼스를 사용해, 기존 최첨단 모델(Qian & Liu 2013, Rasooli & Tetreault 2014 등)과 동일한 최종 F‑score(≈0.78)를 기록했으며, 증분 지표인 Time‑to‑Detection에서는 평균 3.2단어(≈0.6초) 전까지 정확히 탐지해 기존 4.6단어보다 현저히 앞선 성능을 보였다. 또한 “Delayed Accuracy”와 “Incremental F‑score”에서도 1단어 전까지 0.71, 6단어 전까지 0.77을 달성, 안정적인 증분 추론을 입증했다.

결론적으로, STIR은 정보이론적 로컬 특징을 기반으로 복잡한 차트 파싱 없이도 높은 정확도와 낮은 지연을 동시에 만족시키는 실용적인 증분 수리 탐지 프레임워크이며, 향후 실시간 대화 시스템, 음성 비서, 자동 전사 보정 등에 바로 적용 가능하다.

댓글 및 학술 토론

Loading comments...

의견 남기기