공장 기계 가상 오케스트라와 사운드 인터랙션

초록

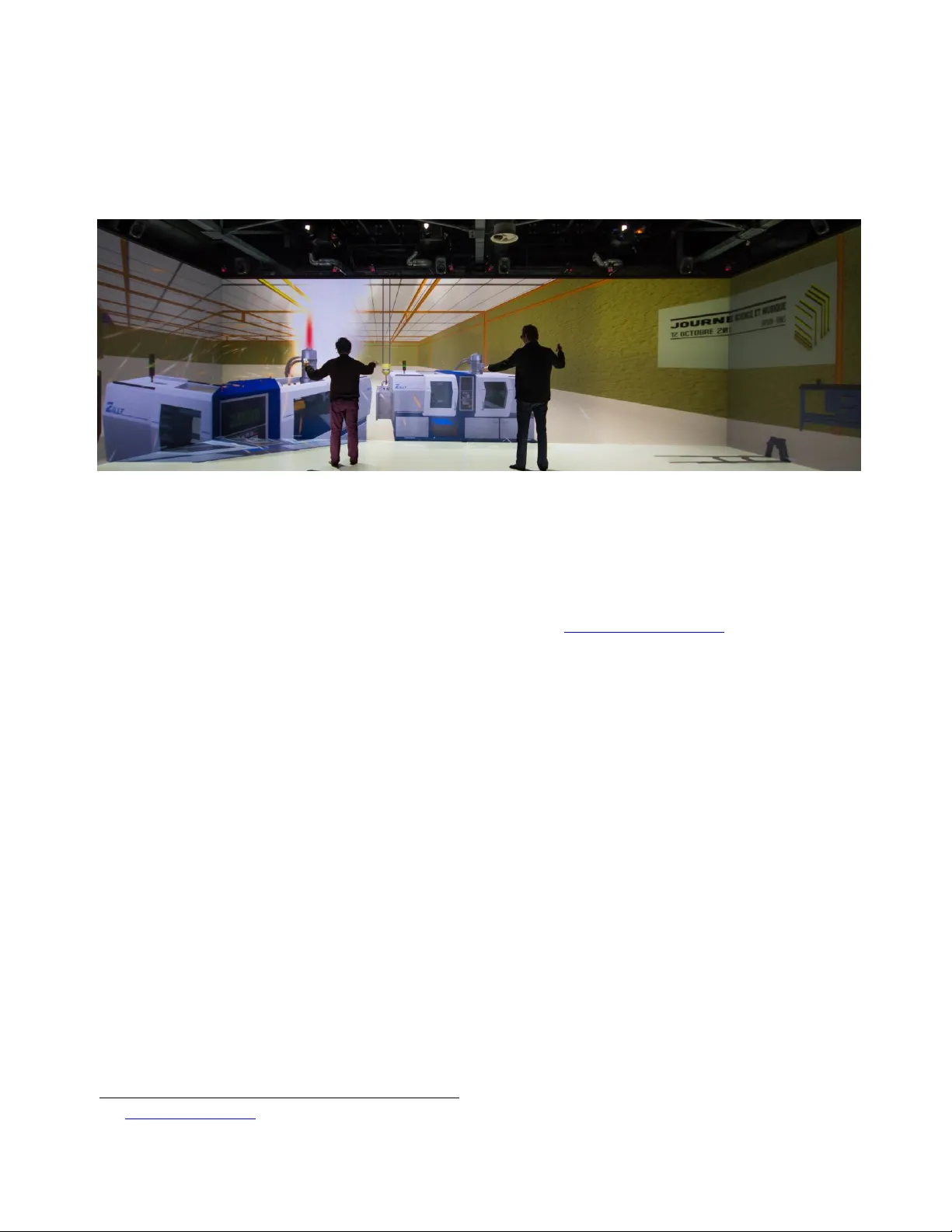

본 논문은 사용자가 인터랙션 디바이스를 조작하면 공장 기계들로 구성된 가상 오케스트라가 시각·청각 피드백을 제공하는 몰입형 시스템을 제안한다. 사운드는 10.2 스피커 배열을 이용해 공간화되며, 헤드 트래킹과 셔터 안경을 통해 실시간으로 청취자의 위치에 맞춰 변한다. 2013년 과학·음악의 날에 전시된 결과를 바탕으로 시스템 설계와 구현, 사용자 경험을 논의한다.

상세 분석

이 연구는 인터랙티브 사운드와 시각을 결합한 몰입형 미디어 아트 설치물로, 기존의 가상 악기 시스템과는 달리 ‘공장 기계’를 악기로 설정함으로써 산업 환경과 예술적 표현을 융합한다. 핵심 기술은 세 가지 축으로 나눌 수 있다. 첫째, 하드웨어 구성은 10.2 스피커 배열(전면 5·후면 5·서라운드 2)과 헤드 트래킹 카메라, 액티브 셔터 안경을 포함한다. 스피커 배치는 청취자의 머리 움직임에 따라 실시간으로 사운드 이미지가 재배치되도록 설계되었으며, 이는 ITD·ILD 기반의 공간화 알고리즘을 적용해 구현했다. 둘째, 인터랙션 매핑은 사용자가 물리적 컨트롤러(예: 조이스틱, 버튼 패드)를 조작할 때마다 사전 정의된 ‘기계 음색’과 대응하는 시각 효과(기계 부품의 회전, 움직임)를 동시에 트리거한다. 이때 오디오 엔진은 FM 합성 및 샘플 기반 재생을 혼합해 각 기계의 고유 음색을 재현하고, 시각 엔진은 Unity3D를 활용해 실시간 렌더링을 수행한다. 셋째, 시스템 전체의 레이턴시는 20 ms 이하로 유지되었으며, 이는 네트워크 전송이 아닌 로컬 프로세싱 파이프라인을 최적화함으로써 달성되었다. 논문은 또한 2013년 과학·음악의 날 전시에서 150명 이상의 관람객이 체험한 결과를 정량·정성적으로 분석한다. 관람객 설문에 따르면 공간화된 사운드와 시각 피드백이 ‘몰입감’과 ‘조작의 직관성’에 크게 기여했으며, 특히 헤드 트래킹에 의해 사운드 이미지가 청취자 시점에 맞춰 이동하는 효과가 높은 평가를 받았다. 그러나 제한된 물리적 공간(3 m × 3 m)과 스피커 수에 따른 해상도 한계, 그리고 복잡한 기계 모델이 실시간 렌더링에 부담을 주는 점이 지적되었다. 향후 연구에서는 고해상도 점군 기반의 공간 오디오와 GPU 가속 시각 효과를 도입해 확장성을 높이고, 다중 사용자 협업 환경을 지원하는 네트워크 아키텍처를 설계할 계획이다.