노이즈 주입 자동인코더 통합 정규화 프레임워크와 깊은 학습 성능 향상

초록

본 논문은 입력, 은닉 전활성 및 은닉 활성에 다양한 형태의 노이즈를 주입하는 ‘노이즈 자동인코더(NAE)’를 제안한다. NAE는 기존의 DAE, 계약(auto‑contractive) 자동인코더, 희소 자동인코더, 그리고 드롭아웃을 하나의 통합 이론으로 설명하며, 노이즈의 종류에 따라 서로 다른 정규화 효과를 제공한다. 실험 결과, NAE는 이미지 복원, MNIST 및 CIFAR‑10 분류에서 기존 방법들을 능가하거나 경쟁적인 성능을 보인다.

상세 분석

논문은 먼저 전통적인 자동인코더와 DAE의 한계를 짚고, 은닉층에 노이즈를 추가함으로써 표현의 강인성을 높일 수 있음을 제시한다. NAE는 (𝜖_I,𝜖_Z,𝜖_H)라는 3‑튜플로 노이즈를 파라미터화한다. 𝜖_I는 입력에, 𝜖_Z는 비선형 함수 앞의 선형 변환에, 𝜖_H는 은닉 활성화 후에 각각 가감 또는 곱셈 형태로 적용된다. 이때 비선형 함수는 일반적인 시그모이드·ReLU 등 임의의 요소별 함수가 가능하다. 저자는 작은 노이즈에 대해 1차 테일러 전개를 수행해, 𝜖_Z가 은닉 활성화에 미치는 효과를 𝜖_H와 동등하게 변환할 수 있음을 보인다. 특히, 입력에 가우시안 노이즈를 주면 은닉 전활성에 가우시안 노이즈가 전파되며, 그 공분산은 WΣWᵀ 형태가 된다. 이러한 변환 관계는 드롭아웃을 가우시안 근사로 해석하거나, 계약 자동인코더(CAE)의 제이콥비안 정규화와 직접 연결한다.

다음으로 저자는 디코더를 선형, 손실을 제곱오차, 각 뉴런에 독립적인 노이즈라는 가정 하에 노이즈를 정확히 마진화한다. 마진화된 손실은 원래 재구성 오차에 세 가지 추가 항(c_I, c_Z, c_H)으로 분해되며, 각각 입력, 전활성, 활성 노이즈에 대응한다. c_H는 은닉 활성화의 분산에 비례하고, 이는 희소성을 유도하거나 활성값 자체에 대한 L2 정규화와 동일시될 수 있다. c_Z는 활성 함수의 미분값과 가중치의 L2 노름을 곱한 형태로, 계약 자동인코더의 제이콥비안 페널티와 일치한다. c_I는 입력 노이즈가 은닉 가중치 행렬을 통해 전파된 효과를 나타내며, 가우시안 입력 노이즈가 있을 때 은닉 가중치가 서로 직교하도록 압박한다. 이러한 분석을 통해 기존 DAE, CAE, 희소 자동인코더, 드롭아웃, ICA 등 다양한 정규화 기법이 NAE의 특수 경우임을 수학적으로 증명한다.

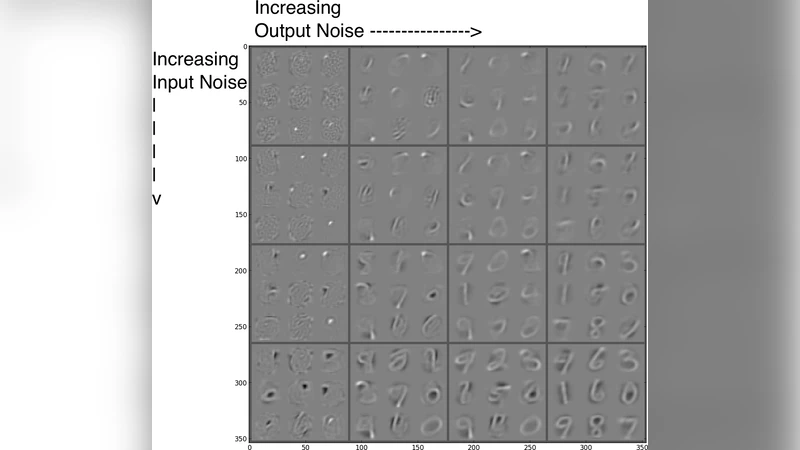

실험에서는 (1) 자연 이미지 패치에 대한 복원 성능, (2) MNIST에서 입력·활성 노이즈가 학습된 필터 형태와 분류 정확도, (3) 대규모 MNIST 및 CIFAR‑10에서 사전학습된 NAE를 이용한 심층 네트워크 fine‑tuning을 평가한다. 자연 이미지 실험에서 드롭아웃을 포함한 NAE가 DAE보다 평균 재구성 오차 2.5 vs 3.2로 우수함을 보였다. MNIST 특징 실험에서는 입력 노이즈가 클수록 로컬 스트로크가 강조되고, 활성 노이즈가 클수록 전역적인 필터가 학습되며, 두 노이즈를 동시에 사용할 때 가장 좋은 분류 성능을 얻었다. 최종 MNIST 분류에서는 2000 은닉 유닛, 활성 노이즈 드롭아웃(p=0.25) 사전학습 후 표준 백프로파게이션을 수행했을 때 138.1% 오류율(테스트)로 기존 DAE·CAE·Dropout 기반 모델들을 앞섰다. CIFAR‑10에서도 비슷한 경향이 관찰되었다.

전체적으로 논문은 “노이즈는 정규화이다”라는 통합적인 관점을 제시하고, 노이즈 종류와 위치에 따라 서로 다른 정규화 효과를 설계할 수 있음을 실험적으로 입증한다. 특히, 은닉 활성화에 직접 노이즈를 주입함으로써 표현의 희소성, 분산성, 그리고 상호 의존성 감소를 동시에 달성할 수 있음을 보여준다. 이는 향후 심층 네트워크의 사전학습·미세조정 전략을 노이즈 설계와 연계해 최적화할 새로운 연구 방향을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기