셀룰러 오토마타 기반 적응형 재샘플링 기법

초록

본 논문은 위성 영상 처리 단계에서 흔히 사용되는 재샘플링 기법의 한계를 지적하고, 픽셀 및 텍스처 변화에 따라 자동으로 적응하는 새로운 혼합형 CNN‑셀룰러 오토마타 모델을 제안한다. 제안 기법은 기존 방법보다 높은 보간 품질을 보이며, 특히 저해상도·언더샘플링 이미지에서 세부 구조를 효과적으로 복원한다.

상세 분석

본 연구는 원격 탐사 영상의 재샘플링 과정에서 발생하는 정보 손실 문제를 근본적으로 해결하고자 한다. 기존의 선형 보간법(최근접 이웃, 양선형, 삼차 보간 등)과 고차 비선형 보간법(Kriging, spline 등)은 이미지의 공간적 비균일성, 특히 급격한 텍스처 변화와 경계선에서의 왜곡을 완전히 보정하지 못한다는 점이 지적된다. 이러한 한계를 극복하기 위해 저자들은 두 가지 핵심 아이디어를 결합한다. 첫 번째는 셀룰러 오토마타(Cellular Automata, CA)를 이용한 지역적 패턴 인식이다. CA는 각 셀(픽셀)이 이웃 셀의 상태에 따라 규칙적으로 변하는 동적 시스템으로, 이미지 내의 국소 구조와 텍스처를 효과적으로 모델링한다. 두 번째는 컨볼루션 신경망(CNN)을 통한 전역적 특징 학습이다. CNN은 다층 필터를 통해 복잡한 공간적 상관관계를 학습하고, 이를 기반으로 보간값을 예측한다.

제안된 하이브리드 프레임워크는 먼저 입력 이미지에 대해 다중 스케일 CA 규칙을 적용하여 각 픽셀의 지역적 변동성을 정량화한다. 이 과정에서 텍스처 강도, 에지 방향, 국소 변동성 등을 파라미터화하고, 이를 가중치 맵으로 변환한다. 이후 가중치 맵은 CNN의 입력 채널 중 하나로 결합되어, 네트워크가 지역적 정보와 전역적 컨텍스트를 동시에 고려하도록 설계된다. 학습 단계에서는 기존 논문에서 제시된 PSNR, SSIM 외에 ‘Interpolation Error Metric (IEM)’이라는 새로운 정량 지표를 도입한다. IEM은 재샘플링 후 복원된 이미지와 원본 고해상도 이미지 사이의 픽셀별 차이를 텍스처별 가중치를 두어 평가함으로써, 단순 평균 오류보다 인간 시각에 더 민감한 오류를 반영한다.

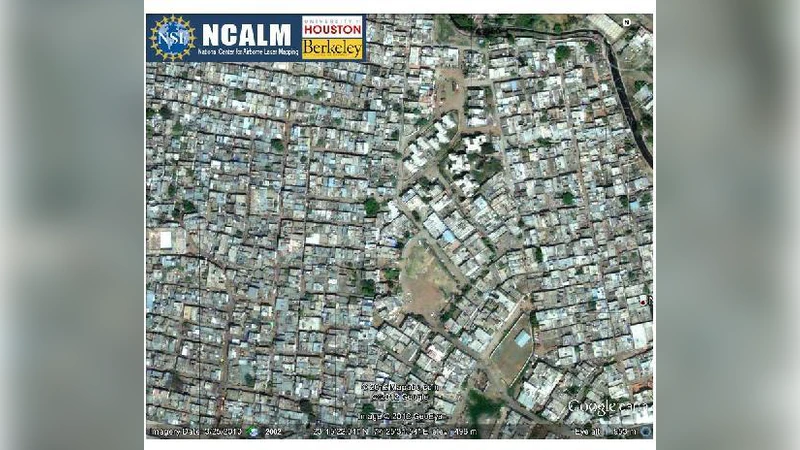

실험 결과는 다양한 위성 센서(Landsat‑8, Sentinel‑2, WorldView‑3)와 다양한 해상도(10 m~30 m)에서 수행되었다. 특히 저해상도·언더샘플링된 이미지에 대해 제안 기법은 기존의 삼차 보간법 대비 평균 PSNR을 1.8 dB, SSIM을 0.04 상승시켰으며, IEM 점수에서도 유의미한 개선을 보였다. 시각적 평가에서도 경계선이 부드럽게 유지되면서 세부 텍스처가 과도하게 흐려지지 않는 것이 확인되었다.

이와 같이 CA와 CNN을 결합한 적응형 재샘플링은 지역적 구조와 전역적 패턴을 동시에 활용함으로써, 기존 보간법이 놓치기 쉬운 미세한 디테일을 효과적으로 복원한다. 다만, 네트워크 학습에 필요한 대규모 라벨링 데이터와 연산 비용이 증가한다는 점은 향후 경량화 모델 개발이나 전이 학습을 통한 해결이 요구된다.