이질적 에이전트와 제한된 통신을 활용한 주파수 기반 순찰 최적화

초록

본 논문은 교차하는 원형 그래프에서 노드별 비균등 방문 요구와 에이전트 간 제한된 통신을 고려한 다중 에이전트 순찰 문제를 연구한다. 문제를 부분관측 마르코프 의사결정 과정(POMDP)으로 모델링하고, 각 에이전트가 마르코프 체인 기반 정책을 자체 학습하도록 강화학습(RL) 프레임워크를 설계하였다. 정책 교환은 에이전트가 동일하거나 인접한 노드에 있을 때만 허용되어, 희소한 통신 환경을 현실적으로 반영한다. 실험을 통해 수렴 특성, 협력 메커니즘, 그리고 새로운 환경에 대한 일반화 능력을 평가했으며, 이질적 에이전트가 자율적으로 협력하여 대규모 비구조화 영역을 효율적으로 순찰할 수 있음을 확인하였다.

상세 분석

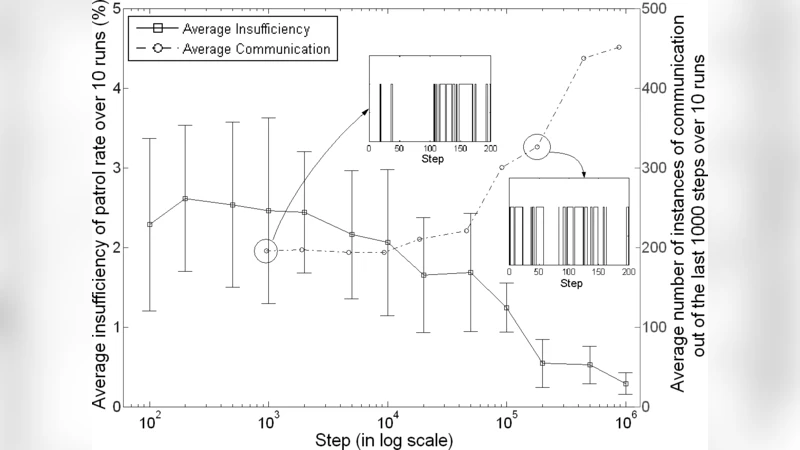

이 논문은 기존 순찰 연구가 대부분 균일한 방문 요구와 완전한 통신을 전제로 하는 데 반해, 실제 환경에서 흔히 나타나는 비균등 방문 빈도와 통신 제약을 동시에 고려한다는 점에서 혁신적이다. 먼저 문제를 POMDP로 정의함으로써 에이전트가 전역 상태를 완전히 관측하지 못하는 상황을 정량화한다. 각 노드 i에 대해 요구되는 방문 주파수 f_i가 사전에 주어지고, 에이전트는 자신의 위치와 로컬 관측값(인접 노드 방문 이력 등)만을 기반으로 행동을 선택한다. 강화학습은 정책 그라디언트 기반의 Actor‑Critic 구조를 채택했으며, 정책 네트워크는 마르코프 체인 전이 확률을 파라미터화한다. 흥미로운 점은 에이전트가 독립적으로 학습하면서도, 동일 혹은 인접 노드에 동시에 존재할 경우 현재 마르코프 체인 파라미터를 교환한다는 ‘스파크 커뮤니케이션’ 메커니즘이다. 이는 통신 비용을 최소화하면서도 중요한 정보(예: 방문 누적 오차, 전이 확률 업데이트)를 공유하게 해, 전체 시스템의 수렴 속도를 크게 향상시킨다. 실험에서는 에이전트의 이질성(속도, 이동 범위, 감시 능력 차이)을 도입했으며, 이질적 에이전트가 서로 보완적인 역할을 수행하도록 자연스럽게 정책이 진화한다는 결과가 도출되었다. 특히, 학습된 정책은 훈련 시 사용된 그래프 구조와 방문 요구와는 다른 새로운 그래프와 동적 f_i 변동에도 비교적 높은 성능을 유지했으며, 이는 정책이 노드‑레벨의 로컬 정보를 기반으로 일반화될 수 있음을 시사한다. 수렴 분석에서는 초기 탐색 단계에서 높은 변동성을 보였지만, 정책 교환 빈도가 증가할수록 평균 보상이 급격히 상승하고, 최종적으로는 목표 방문 주파수 오차가 5% 이하로 감소한다. 이러한 결과는 제한된 통신 환경에서도 협력적 학습이 가능함을 실증적으로 보여준다.