다양성 이해를 위한 일반화된 모호성 분해

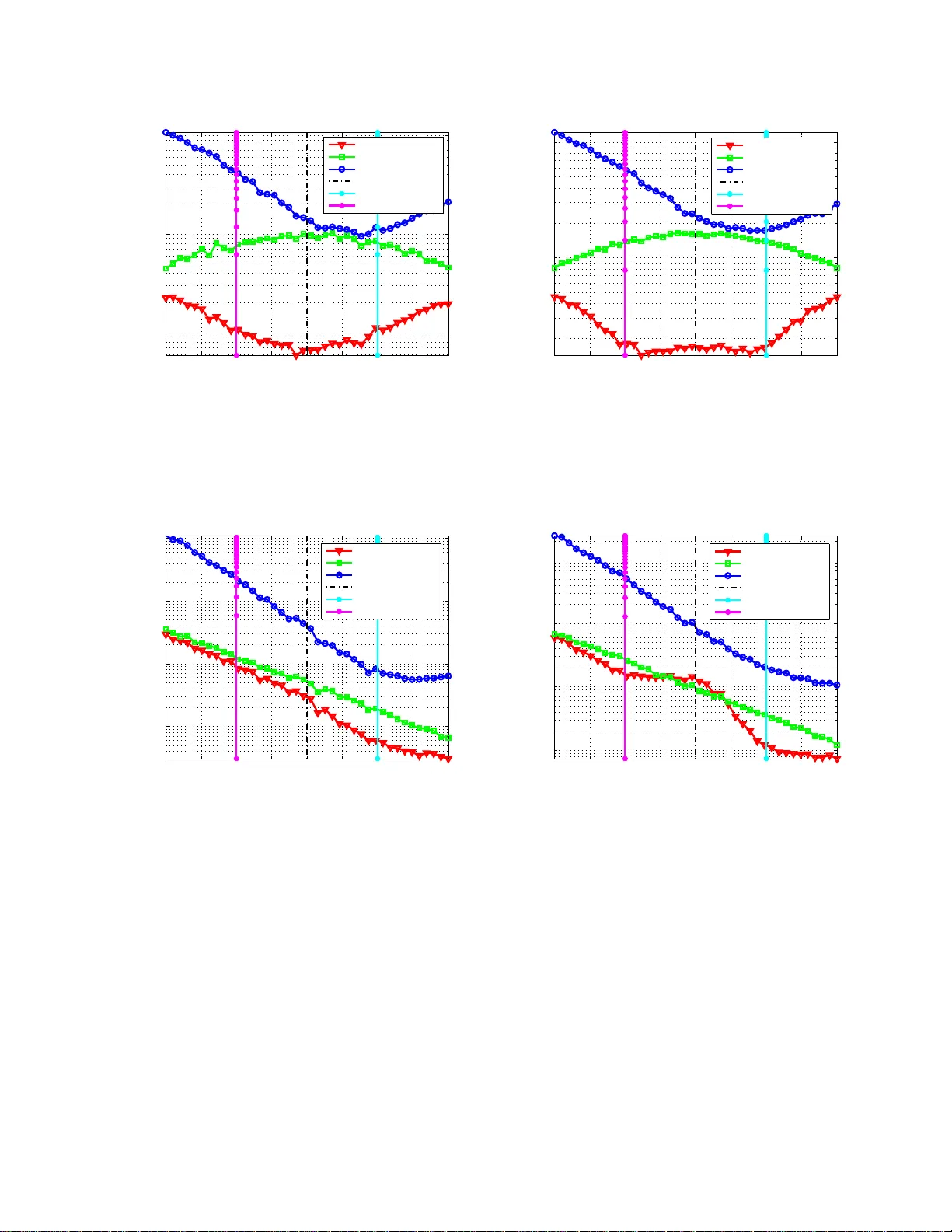

본 논문은 임의의 두 번 미분 가능한 손실 함수에 대해 적용 가능한 일반화된 모호성 분해(GAD) 정리를 제시한다. GAD는 개별 전문가들의 평균 손실에서 ‘다양성’이라는 항을 차감함으로써 앙상블 전체 손실을 근사한다. 정리는 손실 함수의 곡률 상한·하한을 이용해 상한을 제공하고, 제곱오차 손실에 대해 기존의 모호성 분해와 일치함을 보인다. 또한 회귀·분류 손실에 대한 구체적 형태와 시뮬레이션·실험 결과를 통해 GAD의 정확성을 검증한다.

저자: Kartik Audhkhasi, Abhinav Sethy, Bhuvana Ramabhadran

본 논문은 “앙상블 다양성”이 왜 성능 향상을 가져오는지를 이론적으로 규명하고자 한다. 서론에서는 음성 인식, 자연어 처리, 추천 시스템, 웹 검색, 컴퓨터 비전, 인간 상태 인식 등 다양한 분야에서 다수의 전문가(분류기·회귀기)를 결합한 앙상블이 최첨단 성능을 달성한 사례들을 제시한다. 기존 연구는 주로 경험적 관찰에 머물렀으며, 다수는 제곱오차 손실에 한정된 모호성 분해(AD)만을 제공한다. 이러한 제한을 극복하고자 저자들은 임의의 두 번 미분 가능한 손실 함수에 대해 적용 가능한 일반화된 모호성 분해(GAD) 정리를 제시한다.

**1. 사전 지식(레마) 정의**

Lemma 1은 손실 함수 l(y,ŷ)가 두 번째 인수에 대해 두 번 미분 가능하고 연속적인 두 번째 미분을 가질 때, 임의의 기준점 x에 대해 테일러 전개를 이용해

l(y,ŷ) ≥ l(y,x) + l′(y,x)(ŷ−x) + (mₗ,₍B₎/2)(ŷ−x)²

l(y,ŷ) ≤ l(y,x) + l′(y,x)(ŷ−x) + (Mₗ,₍B₎/2)(ŷ−x)²

라는 상·하 한계를 얻는다. 여기서 mₗ,₍B₎와 Mₗ,₍B₎는 손실 곡률의 최소·최대값이다.

Lemma 2는 기존의 AD를 재증명한다. 전문가 집합 {fₖ}와 가중합 f=Σwₖfₖ에 대해

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기