에이전트 기반 자율 시스템 의사결정 검증: 실용적 모델체크 접근법

초록

본 논문은 하이브리드 자동화 시스템에서 연속 제어와 별도 논리적 의사결정(에이전트)으로 구성된 구조를 전제로, 에이전트 내부의 믿음·목표·의도에 대한 모델체크 기법을 제시한다. 연속 부분은 별도 분석하고, 에이전트 프로그램 자체를 검증함으로써 복잡한 논리 추론을 효율적으로 다루며, 가정‑보장(assume‑guarantee) 방식으로 다중 에이전트 시스템까지 확장한다.

상세 분석

이 연구는 기존 하이브리드 오토마톤 방식이 복잡한 논리적 판단을 포함하면 상태공간이 급격히 폭증하고, 설계·코드 가독성이 저하되는 문제점을 정확히 짚어낸다. 이를 해결하기 위해 의사결정 모듈을 BDI(신념·욕구·의도) 기반의 합리적 에이전트로 분리하고, 에이전트 프로그램 자체를 모델체커에 입력한다는 점이 핵심이다. 여기서 ‘B_agent’ 연산자를 도입해 에이전트가 특정 믿음을 가질 때만 안전·활동성 속성을 검증하도록 함으로써, 전통적인 전역 안전 검증(□¬bad)에서 “에이전트가 믿는 한” 안전 검증(□B_agent¬bad)으로 전환한다. 이는 연속 물리 시스템에 대한 상세 모델링을 생략하고, 입력(센서) 퍼셉션의 모든 가능한 조합을 탐색함으로써 실제 환경에 대한 가정을 명시적으로 다룰 수 있게 한다.

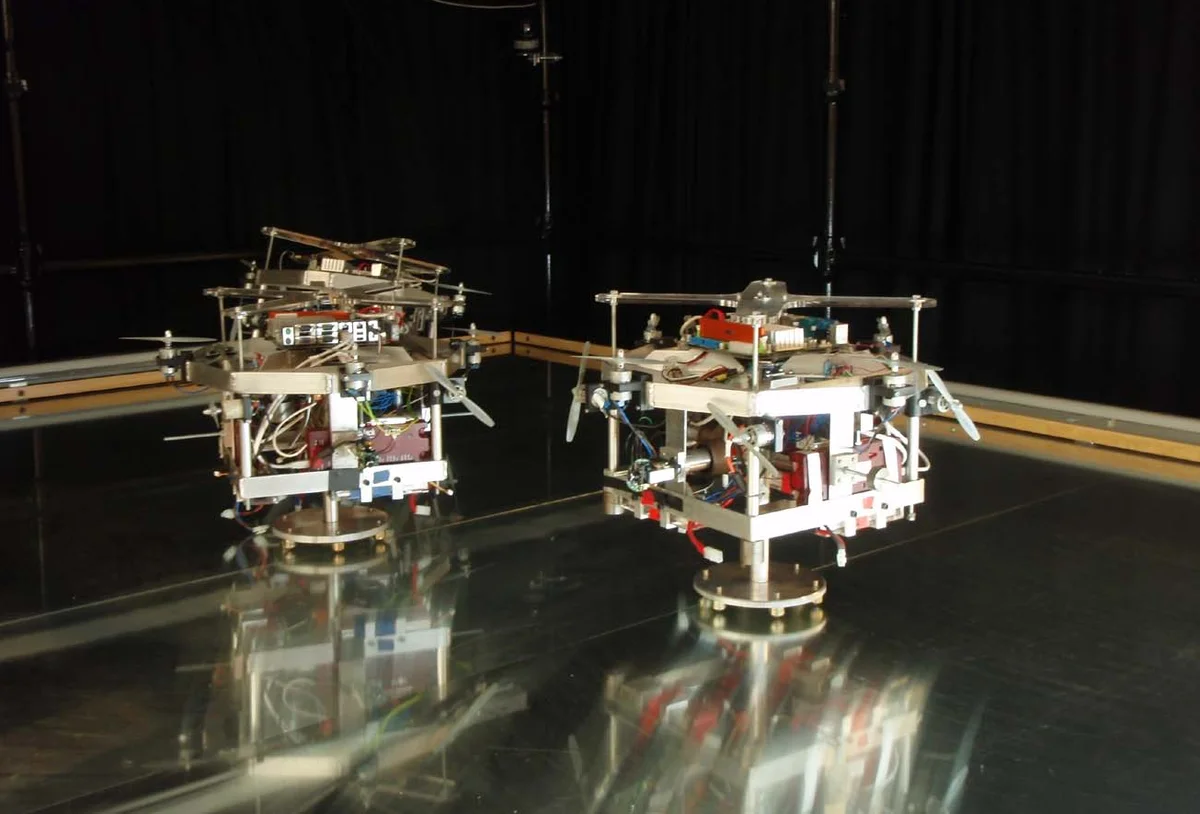

논문은 세 가지 사례(도시 구조 탐색, 저궤도 위성, 적응형 크루즈 컨트롤)를 통해 방법론을 실증한다. 각 사례에서 에이전트는 고수준 목표(예: 구조물 탐색, 궤도 유지, 차간 거리 유지)를 가지고, 환경 가설을 논리식으로 표현한다. 모델체크 도구(JPF, SPIN 등)와 프로그램 검증 기술을 활용해 에이전트가 “위험”이라고 판단하는 상태에 도달하지 않음을 증명한다. 특히 다중 에이전트 시나리오에서는 assume‑guarantee 프레임워크를 적용해 개별 에이전트 검증 결과를 조합, 시스템 전체의 안전성을 추론한다.

이 접근법의 장점은 (1) 복잡한 논리 추론을 포함한 의사결정 로직을 직접 검증함으로써 구현 단계의 버그를 조기에 발견, (2) 연속 제어와 독립적으로 검증이 가능해 기존 하이브리드 자동화 검증 도구와 병행 사용이 용이, (3) 가정‑보장 기법을 통해 확장성을 확보한다는 점이다. 반면, 환경 퍼셉션의 모든 조합을 탐색해야 하므로 상태공간이 급증할 위험이 있으며, 연속 시스템에 대한 정량적 보장은 별도 수학적 증명에 의존한다는 한계가 있다. 또한, 에이전트의 믿음·목표 모델링이 정확하지 않으면 검증 결과가 실제 시스템과 불일치할 가능성이 있다.

전반적으로 이 논문은 “에이전트 내부 논리 검증”을 하이브리드 시스템 설계 흐름에 자연스럽게 삽입함으로써, 복잡한 자율 시스템의 안전·신뢰성을 확보하는 실용적 방법론을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기