관계형 토픽 모델의 차별적 확장 전면 가중치와 정규화 베이지안 학습

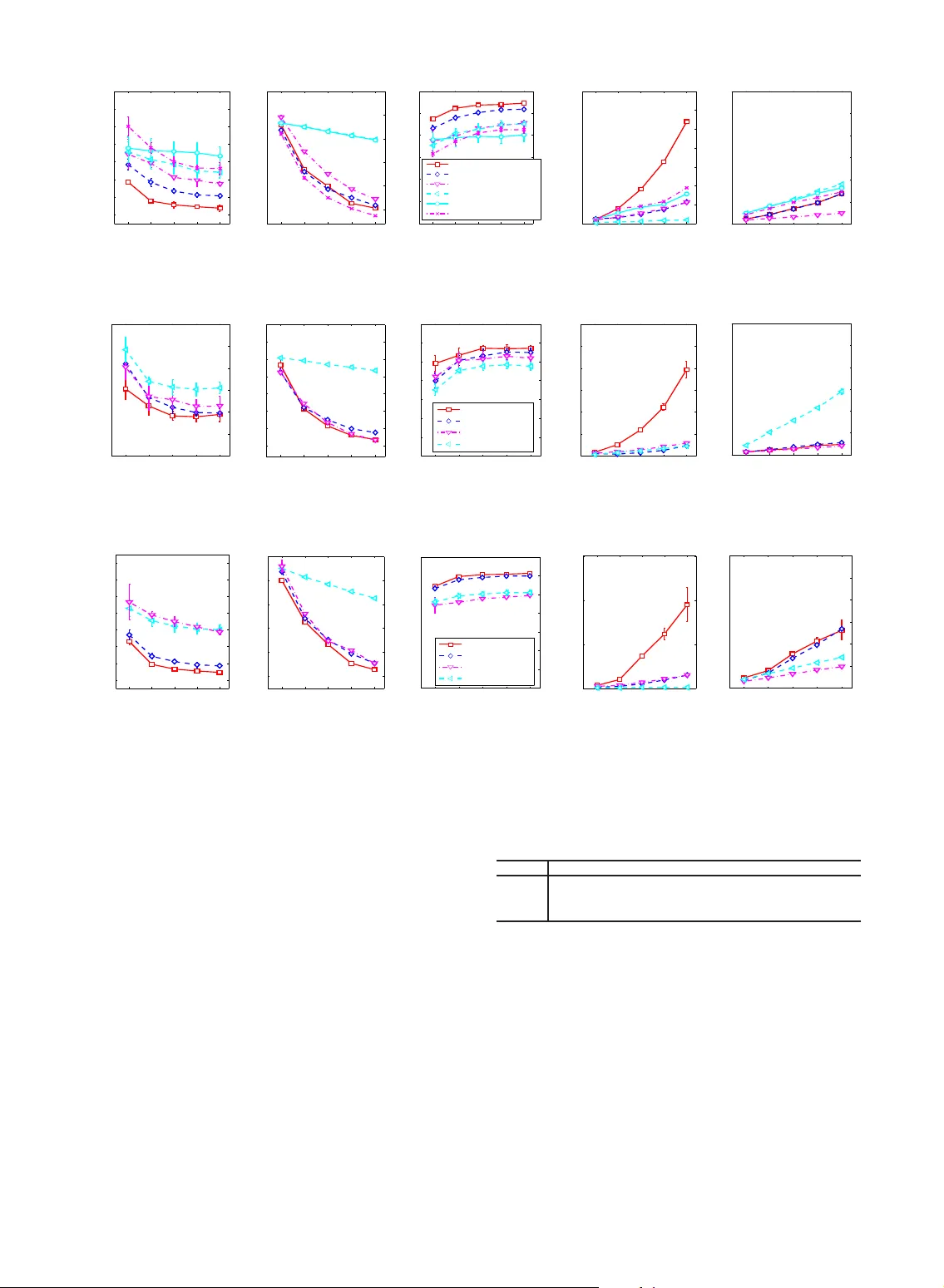

본 논문은 기존 관계형 토픽 모델(RTM)의 제한을 극복하기 위해(1) 전체 토픽 상호작용을 포착하는 전면 가중치 행렬을 도입하고, (2) 불균형 네트워크에 대응하는 정규화 베이지안(RegBayes) 프레임워크를 적용하며, (3) 평균‑필드 가정 없이 데이터 증강 기반의 collapsed Gibbs 샘플링 알고리즘을 제안한다. 로지스틱 로그‑손실과 최대‑마진 힌지 손실 두 가지 판별 손실을 연구하고, 실험을 통해 예측 정확도와 학습 효율이 크게…

저자: Ning Chen, Jun Zhu, Fei Xia

본 논문은 문서 네트워크에서 텍스트와 링크 구조를 동시에 모델링하는 관계형 토픽 모델(RTM)의 세 가지 주요 한계를 지적하고, 이를 해결하기 위한 새로운 프레임워크를 제시한다.

1. **모델 표현력의 확장**

기존 RTM은 링크 확률을 정의할 때 토픽 간 상호작용을 대각선 가중치 행렬 η로 제한하였다. 이는 동일 토픽 간 연결만을 고려하고, 네트워크가 대칭적이라고 가정한다는 의미다. 저자들은 이를 일반화하여 K×K 전면 가중치 행렬 U를 도입한다. 새로운 링크 가능도는 p(y₍ᵢⱼ₎=1|zᵢ,zⱼ,U)=σ( \bar{z}_i^T U \bar{z}_j ) 로 정의되며, 여기서 \bar{z}_i는 문서 i의 토픽 비율 벡터다. 전면 행렬은 모든 토픽 쌍의 상호작용을 학습하게 해 비대칭 네트워크(예: 인용 관계)에도 적용 가능하게 만든다. 실험에서 학습된 U는 대각 성분이 양수, 비대각 성분이 대부분 음수인 구조를 보여, 직관적인 “동일 토픽은 연결 가능성이 높다”는 가설을 정량화한다.

2. **불균형 데이터에 대한 정규화 베이지안(RegBayes) 접근**

실제 네트워크는 양성 링크가 전체 가능한 쌍에 비해 극히 적어(예: Cora에서는 0.1% 이하) 모델이 양성 신호를 충분히 학습하지 못한다. 이를 해결하기 위해 정규화 베이지안 프레임워크를 도입한다. RegBayes는 사후 분포 q(U,Z)에 손실 기반 정규화 항을 추가해, 기대 손실 E_q

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기