베이지안 네트워크 구조 학습을 위한 스파시티부스트 점수

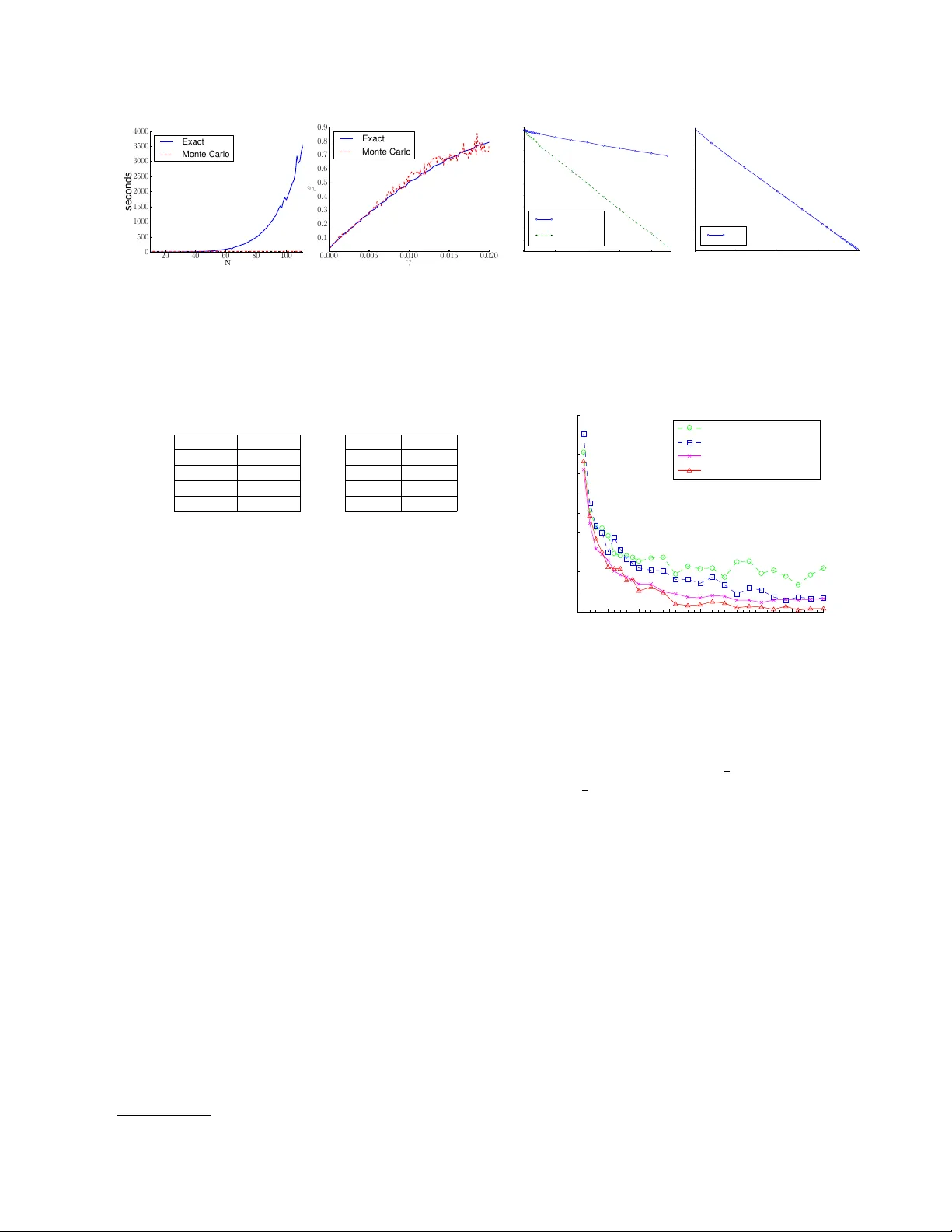

본 논문은 베이지안 네트워크 구조 학습을 위한 새로운 점수 함수인 SparsityBoost를 제안한다. 기존 BIC/MDL과 달리 복잡도 페널티를 데이터에 의존적인 조건부 독립성 검정의 성공 확률로 정의함으로써, 데이터 양이 증가할수록 최적화가 쉬워지는 특성을 갖는다. 저자는 이 점수가 일관성을 가지며 다항 샘플 복잡도 하에서 정확한 구조를 복구한다는 이론적 증명을 제공하고, 선형 계획법과 결합한 실험을 통해 기존 방법보다 적은 데이터와 연산량…

저자: Eliot Brenner, David Sontag

본 논문은 베이지안 네트워크(BN) 구조 학습을 위한 새로운 점수 함수인 SparsityBoost를 제안한다. 기존의 점수 기반 방법(BDeu, BIC/MDL)은 로그우도에 파라미터 수에 비례하는 복잡도 페널티를 더해 과적합을 방지한다. 그러나 데이터 양이 증가하면 로그우도 항이 지배적으로 커져 점수 표면이 평탄해지고, 전역 최적점을 찾기가 어려워진다. 반면, 조건부 독립성 검정은 데이터가 많을수록 검정의 신뢰도가 높아지지만, 기존 구조 학습에서는 검정 결과를 제약조건으로만 사용해 일관성 문제와 오류 전파가 발생한다.

SparsityBoost는 이 두 접근법을 하나의 점수에 통합한다. 점수는 다음과 같이 정의된다.

S(ω_N, G) = LL(ω_N|G) – ψ₁(N)·|G| + ψ₂(N)·∑_{(A,B)∉G} max_{S∈𝒮_{A,B}(G)} min_{s∈Val(S)}

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기