이미지넷을 현실에 맞추다 저랭크 변환을 이용한 확장 가능한 도메인 적응

본 논문은 인터넷 기반 대규모 이미지 데이터셋(ImageNet)과 실제 환경에서 촬영된 이미지 사이의 도메인 차이를 변환 학습으로 극복한다. 저랭크 구조를 활용한 새로운 이중 좌표 하강법을 제안해 변환 행렬을 선형 시간에 학습하고, 이를 통해 새로운 카테고리에도 손쉽게 적용할 수 있다.

저자: Erik Rodner, Judy Hoffman, Jeff Donahue

**1. 연구 배경 및 동기**

대규모 이미지넷(Internet ImageNet)과 같은 객체 중심 데이터베이스는 고해상도, 중앙에 위치한 객체, 인위적인 배경을 특징으로 한다. 반면 실제 환경에서 촬영된 이미지(예: SUN2012)는 장면 중심이며, 객체가 부분적으로 가려지거나 잘려 있는 경우가 많다. 이러한 데이터셋 간의 분포 차이, 즉 도메인 쉬프트는 학습된 분류기의 성능을 급격히 저하시킨다. 기존 연구는 주로 소스와 타깃 양쪽에 라벨이 존재할 때만 적용 가능한 클래스 기반 적응(예: Adaptive SVM)이나, 제한된 수의 제약 조건을 갖는 변환 학습(예: MMDT, Kulis 등)을 제안했지만, 고차원 피처와 방대한 샘플 수 때문에 확장성이 부족했다.

**2. 목표**

본 논문은 (1) 변환 행렬 W 를 효율적으로 학습할 수 있는 최적화 프레임워크를 제시하고, (2) 변환을 통해 새로운 카테고리에도 라벨 없이 바로 적용할 수 있는 “카테고리 독립” 적응 방식을 제공한다. 특히, 변환 학습을 선형 시간에 수행함으로써 대규모 데이터셋에 대한 실용성을 확보한다.

**3. 방법론**

- **문제 정의**: 소스 데이터 D = {(x_i, y_i)}_{i=1}^n, 타깃 데이터 \tilde D = {(\tilde x_j, \tilde y_j)}_{j=1}^{\tilde n} 를 가정한다. 목표는 타깃 샘플을 선형 변환 W \tilde x → 소스 피처 공간에 매핑하는 것이다.

- **제약식**: 각 소스 초평면 v_i (카테고리 i 에 대한 SVM 가중치)와 변환된 타깃 샘플 사이에 마진 v_i^T W \tilde x_j ≥ 1 − η_{ij} 를 부여한다. 이는 기존 MMDT와 동일하지만, 여기서는 모든 (i, j) 쌍을 제약으로 사용한다.

- **벡터화 및 SVM 변환**: W를 벡터화해 w = vec(W) 로 두고, d_{ij} = vec(v_i·\tilde x_j^T) 라는 ‘증강 특징’으로 변환한다. 그러면 원 문제는 (d_{ij}, t_{ij}= \tilde y_{ij}) 로 구성된 소프트‑마진 SVM과 동등해진다.

- **이중 좌표 하강법**: liblinear의 이중 좌표 하강법을 차용해 α_{ij} (dual 변수)를 순차적으로 업데이트한다. 핵심은 w를 명시적으로 유지함으로써 ∇g(α) 계산을 O(D̃) 로 줄이는 점이다.

- **저랭크 구조 활용**: W는

W = Σ_{i=1}^{m} v_i β_i^T, β_i = Σ_{j=1}^{\tilde n} α_{ij} \tilde x_j

형태로 표현될 수 있다. 여기서 m 은 소스 초평면(=카테고리) 수이며, 따라서 W의 랭크는 m 이하이다. 이 사실을 이용해 β_i (크기 m × \tilde D)만 저장하고, R_{ii'} = v_i^T v_{i'} 를 사전 계산해 스칼라 곱을 빠르게 수행한다.

- **알고리즘 흐름**:

1) R 및 각 타깃 샘플의 ‖\tilde x_j‖² 를 미리 계산.

2) 활성 집합 S 에 대해 순차적으로 α_{ij} 를 업데이트하고, 동시에 β_i 를 Δα·\tilde x_j 로 갱신.

3) 캐시된 β_i^T \tilde x_j 값을 활용해 연산 비용을 O(\tilde D) 로 유지.

4) 수렴까지 반복; 이때 수렴 속도는 기존 좌표 하강법과 동일하게 선형 수렴을 보인다.

- **정규화 옵션**: 기본 정규화는 ‖W‖_F^2 이지만, 정체성 정규화 ‖W‑I‖_F^2 를 사용하면 W = I + Σ_i v_i β_i^T 로 풀랭크 변환도 학습 가능하다.

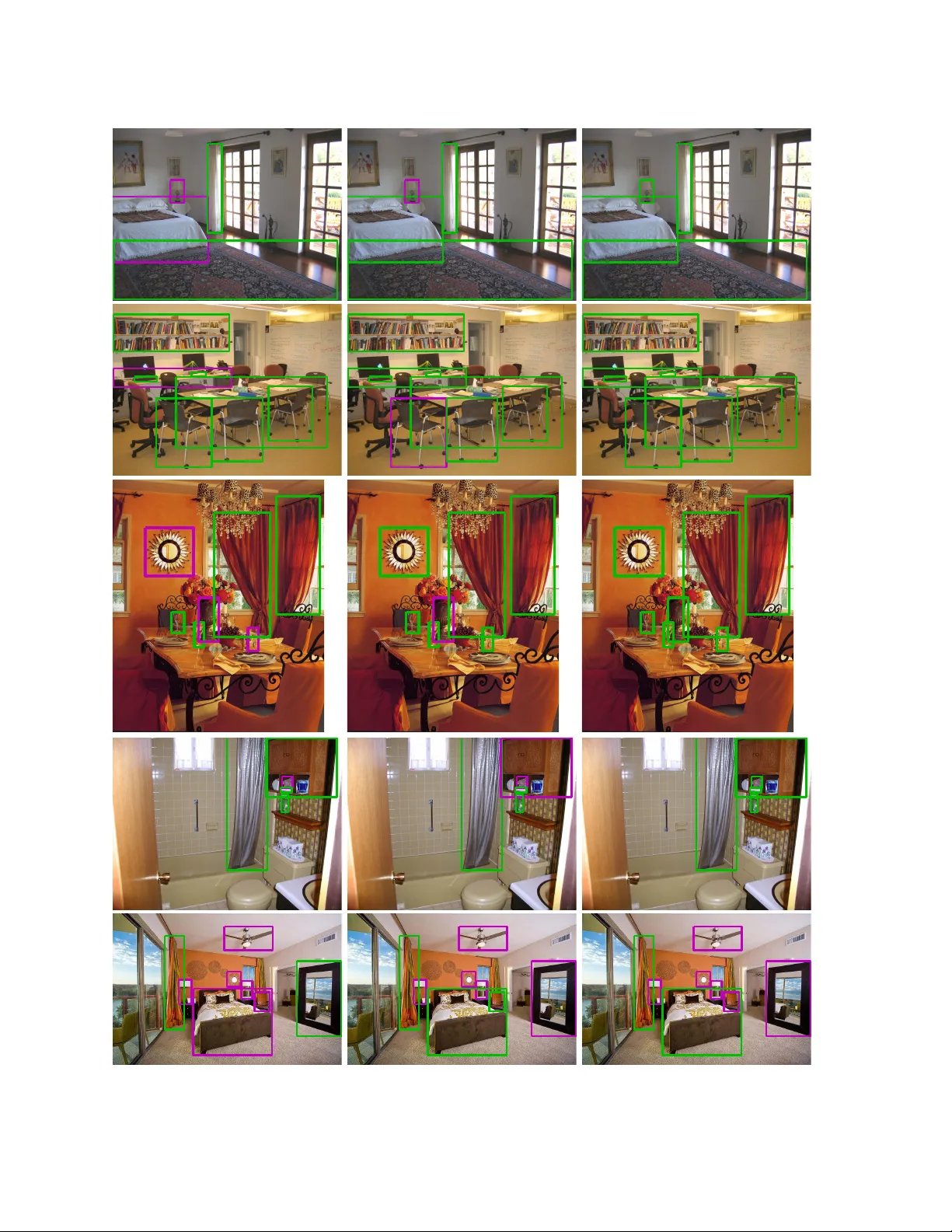

**4. 실험**

- **데이터셋**: ImageNet (ILSVRC2010) → SUN2012, Caltech‑101 → Office, 그리고 서로 다른 피처 타입(HOG vs. CNN) 간 적응을 평가.

- **비교 방법**: 기존 MMDT, Kulis의 비대칭 변환, 그리고 커널 Bregman 최적화 기반 방법을 baseline 으로 사용.

- **성능**: 변환을 적용한 후 평균 정확도는 소스‑타깃 직접 학습 대비 5~10%p 상승했으며, 특히 라벨이 없는 타깃에 대해 비지도 변환만으로도 3~4%p 정도의 향상을 기록했다.

- **시간 효율성**: 동일한 하드웨어(CPU)에서 MMDT 대비 학습 시간이 20배 이상 단축되었고, 커널 기반 방법은 메모리 초과로 실행이 불가능한 경우가 많았다.

**5. 의의 및 한계**

이 논문은 (a) 저랭크 구조를 명시적으로 활용해 변환 학습을 선형 시간에 수행한다는 이론적·실험적 증명을 제공하고, (b) 변환을 통해 라벨이 없는 새로운 카테고리에도 즉시 적용 가능한 “zero‑shot domain adaptation”을 실현한다는 점에서 실용적 가치를 높인다. 다만, 변환의 랭크가 카테고리 수에 제한되므로 매우 많은 클래스(수천 개) 상황에서는 추가적인 랭크 확장이 필요할 수 있다. 또한, 현재는 선형 변환에 국한되어 있어 비선형 복잡성을 다루기 위한 커널화 혹은 딥 네트워크 기반 확장은 향후 연구 과제로 남는다.

**6. 결론**

저랭크 변환과 이중 좌표 하강법을 결합한 새로운 최적화 프레임워크는 대규모 이미지넷‑현실 도메인 간 적응을 실시간에 가깝게 수행할 수 있게 만든다. 이는 대규모 비전 시스템이 실제 환경에 적용될 때 겪는 도메인 쉬프트 문제를 크게 완화시키며, 향후 더 복잡한 비선형 변환이나 멀티모달 적응에도 확장 가능한 기반을 제공한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기