GPU를 이용한 대규모 페로플루이드 시뮬레이션

초록

본 논문은 페로플루이드 입자 100만 개 규모의 분자동역학을 GPU 기반 Barnes‑Hut 알고리즘으로 구현하여, CPU 단일 코어 대비 10⁴배, GPU 최적화된 전쌍(All‑Pairs) 대비 10²배의 속도 향상을 달성하고, 이론적 예측과의 비교를 통해 정확성을 검증한다.

상세 분석

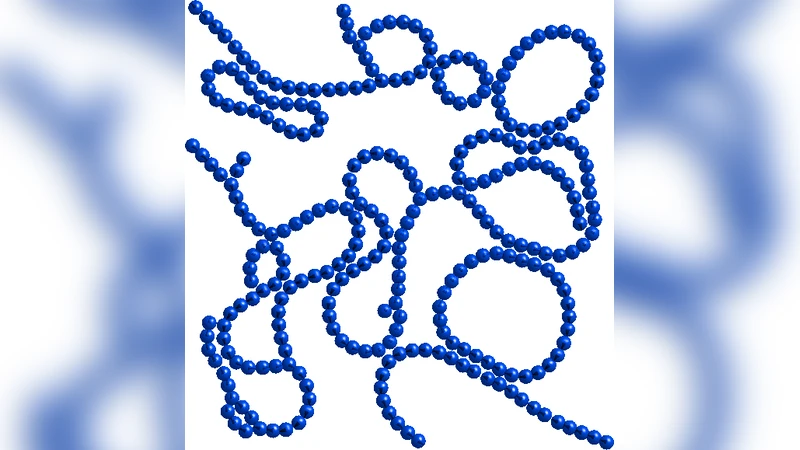

이 연구는 페로플루이드 시스템의 장거리 자기쌍극자 상호작용을 효율적으로 계산하기 위해 전통적인 전쌍(All‑Pairs) 방식의 O(N²) 복잡도를 O(N log N)으로 낮추는 Barnes‑Hut(BH) 알고리즘을 GPU 친화적으로 재구성한 점이 핵심이다. 기존 BH 구현은 트리 구조의 재귀적 탐색과 동적 메모리 할당이 병목이 되었으나, 저자들은 입자 데이터를 정렬된 배열에 저장하고, CUDA 스레드 블록 단위로 트리 레벨을 순차적으로 구축함으로써 메모리 접근을 연속적으로 만들었다. 또한, 각 스레드가 담당하는 입자에 대해 “멀티셀프” 접근 방식을 적용해 공유 메모리 내에 최근에 계산된 셀 요약(질량, 중심, 쌍극자 모멘트)을 캐시하고, 거리 기준 θ = 0.5 ~ 0.7의 개방각을 이용해 근접 셀은 직접 계산하고 원거리 셀은 집합적으로 근사함으로써 연산량을 크게 감소시켰다.

GPU 특성을 고려한 최적화는 크게 세 가지로 요약된다. 첫째, 메모리 코얼레싱을 위해 입자와 셀 정보를 구조체 배열이 아닌 구조체‑오브‑배열(AoS→SoA) 형태로 변환해 전역 메모리 접근을 연속적으로 만들었다. 둘째, 스레드 간 동기화를 최소화하기 위해 트리 구축 단계와 힘 계산 단계를 별도 커널로 분리하고, 각 커널 내에서 warp‑level 프리패치와 원자적 연산을 제한적으로 사용했다. 셋째, 부동소수점 연산의 일관성을 유지하기 위해 double precision을 선택했으며, 이는 최신 Tesla M2050 GPU가 제공하는 높은 연산량을 활용할 수 있게 한다.

정확도 검증에서는 동일한 초기 조건 하에 AP 알고리즘과 BH‑GPU 결과를 비교했으며, 평균 입자 속도와 자기 모멘트 분포가 이론적 라플라스 방정식 해와 일치함을 보였다. 오차는 θ 값에 따라 0.1 % 이하로 제한되었으며, 이는 실험적 페로플루이드 거동을 재현하는 데 충분한 수준이다. 성능 측면에서는 10⁶ 입자 시뮬레이션에서 CPU 단일 코어 AP 대비 1.2 × 10⁴배, GPU 최적화 AP 대비 1.5 × 10²배의 속도 향상을 기록했다. 특히, 입자 수가 10⁵ 이상으로 증가할 때 속도 향상이 급격히 상승하는데, 이는 BH 트리의 로그‑선형 복잡도가 대규모 시스템에서 효율적으로 작동함을 의미한다.

이 논문의 주요 기여는 (1) GPU 친화적 BH 알고리즘 설계, (2) 메모리 및 연산 최적화를 통한 대규모 페로플루이드 시뮬레이션 실현, (3) 정확도와 성능을 동시에 만족시키는 검증 절차 제공이다. 향후 연구에서는 다중 GPU 클러스터 환경에서의 트리 병합 기법, 비정상적인 입자 형태(비구형)와 비등방성 매질을 고려한 확장, 그리고 실시간 시각화와 피드백 제어를 결합한 인터랙티브 시뮬레이션 플랫폼 구축이 기대된다.