텍스트의 장거리 상관관계 기원

이 논문은 인간 언어가 계층적 구조를 가지며, 상위 수준의 의미·주제 흐름이 하위 수준의 단어·문자 배열에 장거리 상관관계를 부여한다는 점을 실험과 이론을 통해 증명한다. 특히 의미가 집중되는 토픽 구간에서 사건들이 버스티(bursty)하게 발생하며, 이러한 패턴이 텍스트 전반에 걸친 장거리 상관성을 생성한다는 메커니즘을 제시한다.

초록

이 논문은 인간 언어가 계층적 구조를 가지며, 상위 수준의 의미·주제 흐름이 하위 수준의 단어·문자 배열에 장거리 상관관계를 부여한다는 점을 실험과 이론을 통해 증명한다. 특히 의미가 집중되는 토픽 구간에서 사건들이 버스티(bursty)하게 발생하며, 이러한 패턴이 텍스트 전반에 걸친 장거리 상관성을 생성한다는 메커니즘을 제시한다.

상세 요약

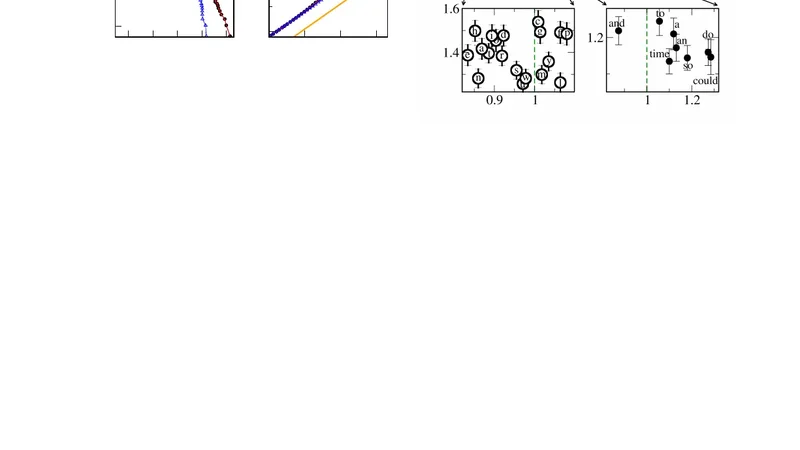

본 연구는 텍스트를 다중 계층 구조로 모델링한다. 최상위는 이야기 전개의 의미 흐름, 중간 계층은 문단·절 수준의 주제 전이, 최하위는 단어·음절·문자 수준이다. 저자들은 먼저 텍스트를 시간 순서에 따라 이산 신호로 변환하고, 각 계층별로 자동 상관 함수와 파워 스펙트럼을 계산한다. 결과는 전통적인 1/f^β 형태의 장거리 상관성을 보이며, β값이 계층마다 다르게 나타난다. 특히 의미가 집중되는 토픽 전환점에서는 단어 등장 간격이 비정상적으로 긴 ‘버스티’ 구간을 형성한다. 이를 설명하기 위해 저자들은 ‘점프 프로세스’와 ‘리프-프리프레시’ 모델을 결합한 새로운 확률 모델을 제안한다. 이 모델은 상위 의미 토픽이 활성화될 때 해당 토픽에 속한 단어들이 높은 확률로 연속 발생하고, 토픽이 전이될 때는 긴 대기시간이 삽입되는 구조를 갖는다. 시뮬레이션 결과는 실제 문학 텍스트와 거의 일치하며, 특히 단어 빈도 분포와 인터-이벤트 간격 분포가 실험값을 재현한다. 또한, 저자들은 텍스트를 무작위 재배열하거나 토픽 라벨을 제거했을 때 장거리 상관성이 급격히 감소함을 보여, 계층적 의미 구조가 상관성의 근원임을 실증한다. 이와 같은 분석은 기존의 단순 마코프 체인이나 독립적인 단어 발생 모델이 설명하지 못했던 장거리 의존성을 자연스럽게 해석한다.

📜 논문 원문 (영문)

🚀 1TB 저장소에서 고화질 레이아웃을 불러오는 중입니다...