볼츠만 머신 공동 학습을 위한 메트릭프리 자연기울기

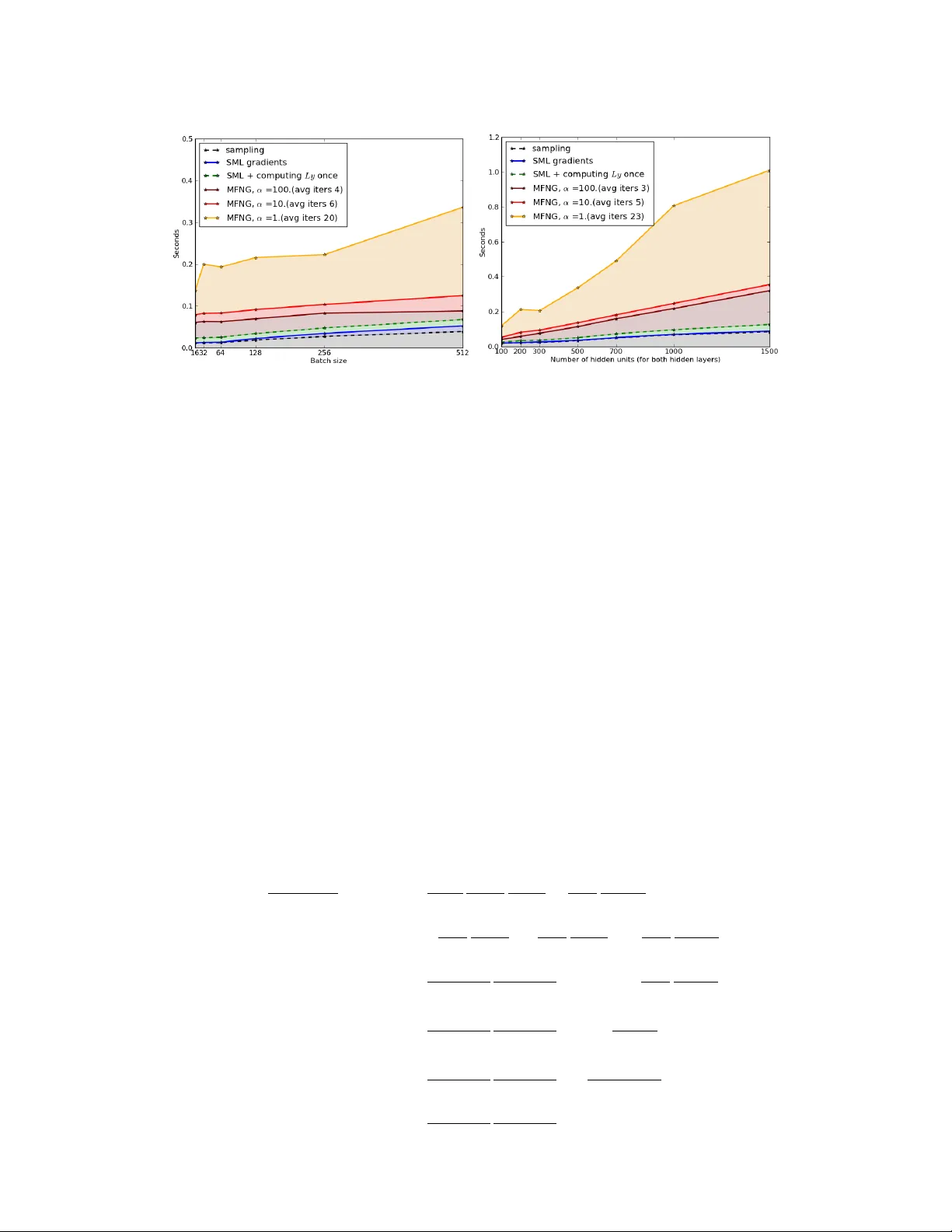

본 논문은 볼츠만 머신(BM) 특히 깊은 볼츠만 머신(DBM)의 공동 학습을 위해 자연기울기(Natural Gradient)를 메트릭을 직접 저장하지 않고 행렬‑벡터 곱만으로 구현한 Metric‑Free Natural Gradient(MFNG) 알고리즘을 제안한다. MFNG는 Hessian‑Free 방법과 유사한 트렁케이티드 뉴턴 계열이며, 모델 분포 하에서 기대되는 로그분할함수의 두 번째 미분(또는 에너지 미분의 공분산)으로 정의되는 피셔 정…

저자: Guillaume Desjardins, Razvan Pascanu, Aaron Courville

본 논문은 볼츠만 머신(Boltzmann Machines, BM) 특히 깊은 볼츠만 머신(Deep Boltzmann Machine, DBM)의 공동 학습(joint‑training) 문제를 해결하기 위해 자연기울기(Natural Gradient) 기반의 새로운 최적화 알고리즘을 제안한다. 기존의 확률 모델 학습에서는 로그우도에 대한 스터치 그라디언트를 추정하기 위해 대조(contrastive) 혹은 Stochastic Maximum Likelihood(SML)와 같은 근사법을 사용한다. 그러나 이러한 1차 방법은 모델의 파라미터 공간이 비선형이고, 특히 DBM처럼 다층 구조를 가질 경우 헤시안(또는 피셔 정보 행렬)이 매우 ill‑conditioned 하여 수렴이 느려진다. 이를 보완하기 위해 저자들은 자연기울기 개념을 도입한다. 자연기울기는 파라미터 공간이 아니라 확률분포 매니폴드 상에서 가장 급격히 감소하는 방향을 찾으며, 이는 피셔 정보 행렬(Fisher Information Matrix, FIM) L의 역을 그라디언트에 곱함으로써 구현된다.

논문은 먼저 자연기울기의 일반적 유도 과정을 상세히 전개한다. KL‑다이버전스 제약 하에 로그우도 1차 테일러 전개와 2차 KL 전개를 결합해, 최적화 문제를 라그랑주식으로 정리하고, ∂L/∂Δθ = 0 을 만족하는 Δθ 가 L⁻¹ E_q

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기