깊은 생성 모델의 층별 학습 전략

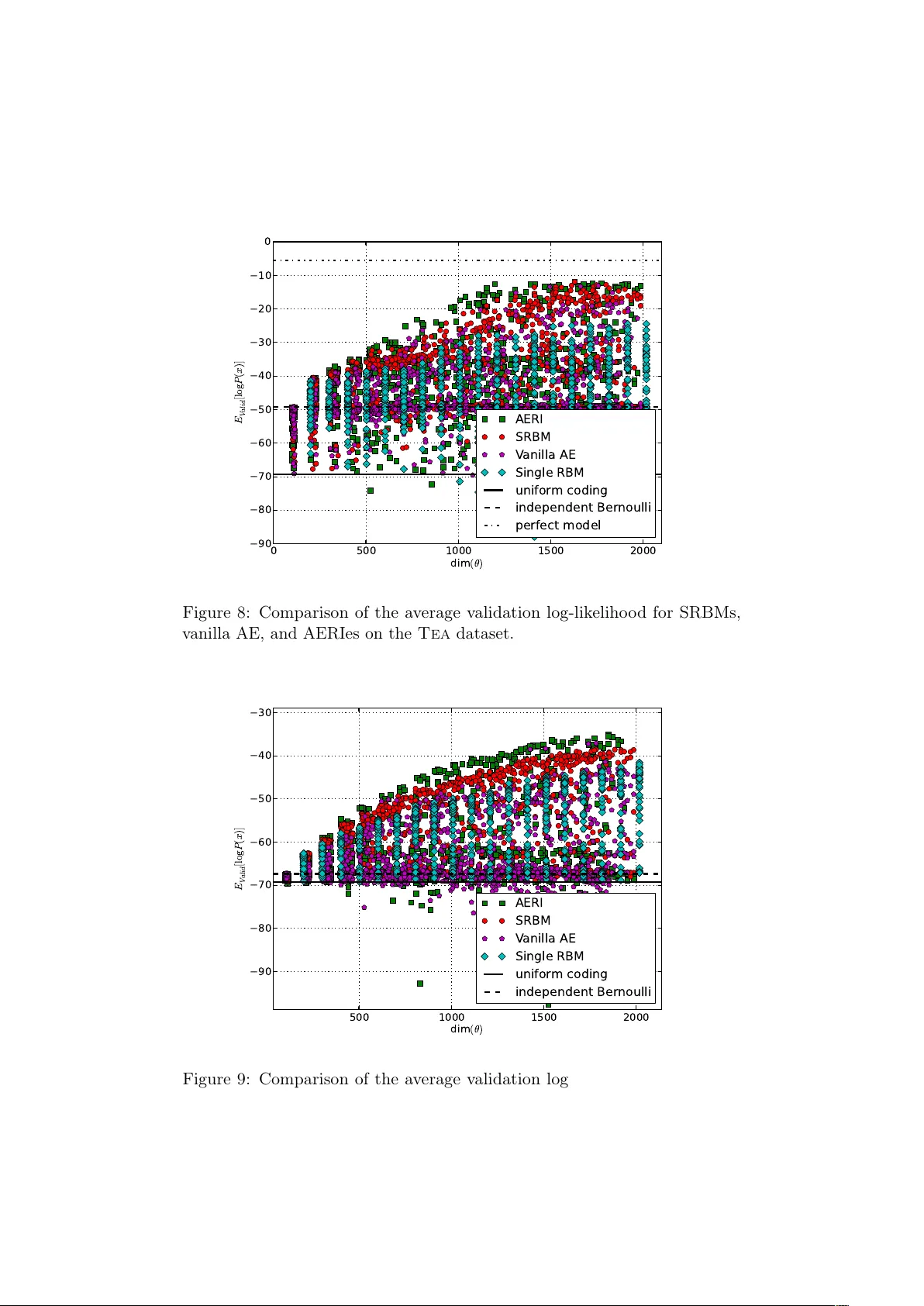

본 논문은 다층 심층 생성 모델을 한 번에 학습하기 어려운 문제를 해결하기 위해, 각 층을 순차적으로 학습하는 새로운 절차를 제안한다. 이 절차는 미래 성능에 대한 낙관적 프록시인 “최적 잠재 마진(best latent marginal)”을 기준으로 하며, 오토인코더를 해당 기준의 하한을 학습하는 모델로 재해석한다. 실험 결과는 기존 스택드 RBM 방식보다 우수한 성능을 보여준다.

저자: Ludovic Arnold, Yann Ollivier

본 논문은 “Layer-wise learning of deep generative models”라는 제목으로, 다층 심층 생성 모델을 효율적으로 학습하기 위한 새로운 절차와 그 이론적 근거를 제시한다. 전통적인 심층 생성 모델(예: 스택드 RBM, 딥 볼츠만 머신)은 전체 파라미터를 동시에 최적화하려는 시도에서 수렴이 어려워지고, 계산 비용이 급증한다는 한계가 있다. 특히, 잠재 변수의 차원이 증가함에 따라 사후 분포 추정이 복잡해지고, 전역 최적점을 찾는 것이 실질적으로 불가능에 가까워진다. 이러한 문제를 해결하고자 저자들은 **층별 학습(layer‑wise learning)**이라는 접근법을 도입한다.

### 1. 이론적 배경 및 잠재 마진(Latent Marginal) 개념

층별 학습은 현재까지 학습된 하위 층을 고정하고, 상위 층을 추가할 때 미래 전체 모델의 성능을 낙관적으로 추정한다. 이를 위해 “잠재 마진”이라는 개념을 정의한다. 구체적으로, i번째 층까지 학습된 모델을 \(P_i(x, h_i)\)라 하면, i+1번째 층의 파라미터 \(\theta_{i+1}\)를 선택할 때 아직 정의되지 않은 상위 잠재 변수 \(h_{i+1}\)에 대해 가능한 모든 주변 분포 \(Q(h_{i+1}|h_i)\) 중 **가장 좋은** 것을 가정한다. 이 가정 하에 현재 층의 파라미터 업데이트는 다음과 같은 최적화 문제로 변환된다.

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기