수사학 기반 자연어 처리: 데이터 없이 가능한 새로운 접근

본 논문은 대규모 학습 데이터 없이도 저자 식별, 재선거 예측, 자연어 생성, 문서 요약 등 전통적인 NLP 과제를 해결하기 위해 고전 수사학 기법을 자동으로 탐지·분석하는 ‘수사학 분석(Rhetorical Analysis)’ 방법을 제안한다. 파이썬과 NLTK를 이용해 대시·세미콜론, 두운, 반복구, 평행구 등을 탐지하는 여섯 개의 파서와 RMS 기반 유사도 측정으로 저자와 선거 결과를 예측한다. 실험 결과는 저자 식별 100%, 재선거 예측…

저자: Benjamin Englard

본 논문은 “수사학 분석(Rhetorical Analysis)”이라는 새로운 접근법을 제시하며, 대규모 학습 데이터 없이도 전통적인 NLP 문제들을 해결할 수 있음을 주장한다. 서론에서는 기존의 최대 엔트로피(Maximum Entropy) 기반 방법이 방대한 라벨링 데이터에 의존한다는 점을 비판하고, 인간이 텍스트를 읽을 때 수사학적 장치를 직관적으로 인식한다는 점을 근거로 연구 목표를 설정한다.

2절에서는 수사학 분석의 정의와 역사적 배경(아리스토텔레스, 키케로)을 간략히 소개하고, NLP에 적용하기 위한 구체적인 절차를 제시한다. 3절에서는 연구에 사용된 수사학 전략을 선정한다. 선택된 전략은 대시(–)와 세미콜론(;), 두운(alliteration), 아나포라(anaphora), 에피스트로피(epistrophe), 평행구(parallelism)이다. 각 전략은 텍스트 내에서 패턴 매칭, 문장 토크나이징, 품사 태깅 등을 통해 자동으로 탐지된다. 특히 평행구 탐지를 위해 NLTK의 브라운 뉴스 코퍼스로 unigram 품사 태거를 학습시켰으며, 전체 탐지기는 파이썬 2.7.2 기반으로 구현되었다. 구현된 여섯 개 파서는 각각 전략별 카운터를 반환하고, 유닛 테스트를 통해 대부분의 전략에서 정확히 탐지했으나 평행구는 9개 중 8개 테스트만 통과하였다.

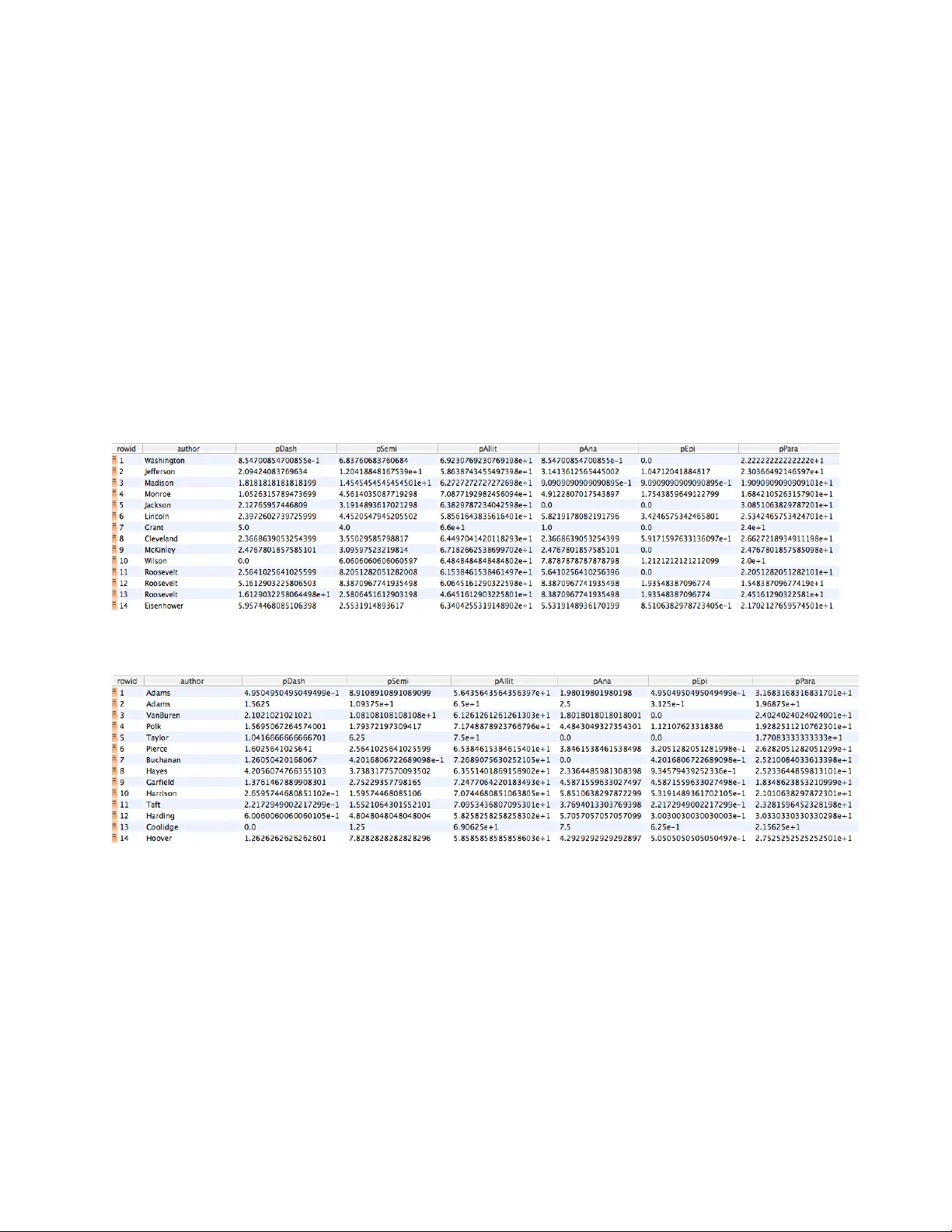

4절에서는 저자 식별 문제에 수사학 분석을 적용한다. 저자별 텍스트 파일을 분석해 전략별 카운트를 구하고, 이를 전체 전략 수로 나누어 확률값으로 정규화한다. 이 확률값을 SQLite 데이터베이스에 저장하고, 미지 텍스트와 각 저자의 확률 벡터 사이의 RMS(Root‑Mean‑Square) 오차를 계산한다. 오차가 가장 작은 저자를 정답으로 예측한다. 실험 결과는 100% 정확도를 보고했으며, 이는 저자 식별에 수사학 전략이 강력한 구분자를 제공한다는 주장을 뒷받침한다. 그러나 실험에 사용된 데이터 규모와 비교 모델에 대한 언급이 부족하다.

5절에서는 대통령 취임 연설을 이용해 재선거 예측에 수사학 분석을 적용한다. 승리한 대통령과 패배한 대통령 각각 14개의 연설을 분석해 평균 전략 확률을 구하고, 새로운 연설과의 RMS 차이를 비교한다. 승리군과 패배군 중 RMS가 더 작은 쪽을 승리 후보로 예측한다. 결과는 55% 정확도로, 무작위 예측에 근접하지만, 제한된 샘플 수와 정치적 변수(정책, 경제 상황 등)를 무시한 점이 한계로 지적된다.

6절은 자연어 생성(NLG) 파트이다. 저자는 전략 확률을 입력받아 텍스트를 생성하는 시스템을 설계한다. WordNet을 활용해 사용자가 입력한 첫 단어의 정의를 찾아 중간 단어를 추출하고, 이를 재귀적으로 반복해 문장을 확장한다. 생성된 텍스트는 문법적으로는 올바르지만 의미적 일관성이 부족할 수 있다. 셰익스피어 스타일 텍스트와의 유사도는 87.3%라고 주장하지만, 유사도 측정 방법이 구체적으로 제시되지 않아 신뢰성이 떨어진다.

7절에서는 문서 요약을 위한 전략 기반 접근법을 간략히 언급한다. 전략이 많이 사용된 문장을 선택해 요약문으로 추출한다는 아이디어지만, 실제 구현 및 평가 결과는 제시되지 않는다.

결론에서는 수사학 분석이 NLP에 새로운 패러다임을 제공할 수 있다고 주장하며, 향후 연구 방향으로 더 다양한 전략 탐지, 대규모 코퍼스 적용, 딥러닝 모델과의 하이브리드 방식을 제시한다. 전체적으로 논문은 아이디어는 신선하지만, 실험 설계의 엄밀성, 재현 가능성, 비교 대상 부재 등으로 인해 학술적 기여도가 제한적이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기