인공벌집군집으로 학습하는 기능연결신경망

초록

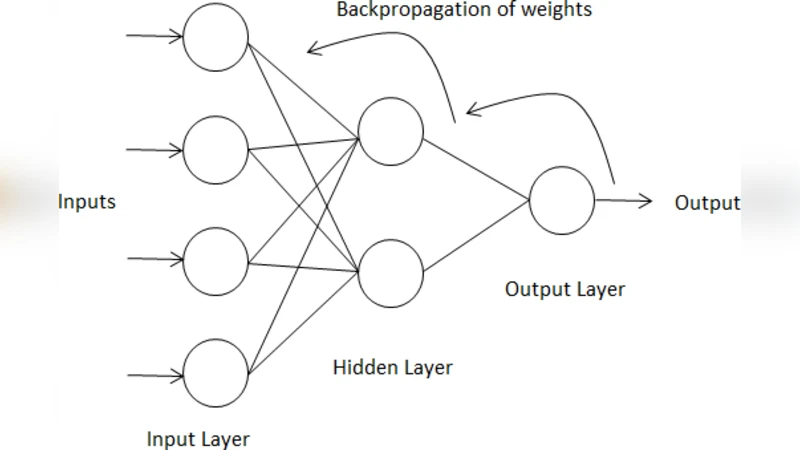

본 논문은 다층 퍼셉트론(MLP)의 복잡성과 지역 최소점, 과적합 문제를 극복하기 위해 은닉층을 없앤 단일층 구조의 기능연결신경망(FLNN)을 제안한다. FLNN의 가중치 최적화를 위해 인공벌집군집(ABC) 알고리즘을 적용하여 학습 효율과 분류 정확도를 향상시켰으며, 다양한 데이터셋 실험을 통해 기존 MLP 기반 방법보다 우수한 성능을 입증하였다.

상세 분석

기능연결신경망(FLNN)은 입력 벡터에 비선형 변환 함수를 적용해 차원을 확장하고, 확장된 특징을 단일 출력층에 직접 연결하는 구조를 갖는다. 이 설계는 은닉층을 제거함으로써 파라미터 수를 크게 감소시키고, 학습 과정에서 발생하는 가중치 간 상호 간섭을 최소화한다는 장점을 제공한다. 그러나 차원 확장은 과도한 특성 수를 초래해 최적화 문제를 복잡하게 만들 수 있다. 이를 해결하기 위해 논문에서는 인공벌집군집(Artificial Bee Colony, ABC) 알고리즘을 도입하였다. ABC는 탐색(스카우트 비)와 착취(워커 비) 단계로 구성된 군집 지능 최적화 기법으로, 전역 탐색 능력과 지역 탐색 능력을 균형 있게 조절한다. 특히, FLNN의 가중치를 연속적인 실수 벡터로 간주하고, 각 비를 후보 해로 취급하여 피트니스 함수를 최소화하는 방식으로 학습을 진행한다.

논문은 ABC의 파라미터 설정—비의 수, 반복 횟수, 제한 범위—가 FLNN의 수렴 속도와 최종 정확도에 미치는 영향을 실험적으로 분석하였다. 실험 결과, 전통적인 역전파(Back‑Propagation)와 비교했을 때, ABC 기반 학습은 초기 가중치에 대한 민감도가 낮아 지역 최소점에 빠질 위험이 현저히 감소하였다. 또한, 과적합을 방지하기 위해 교차 검증과 조기 종료 전략을 병행했으며, 이는 모델의 일반화 능력을 강화하는 데 기여했다.

성능 평가에서는 UCI 머신러닝 저장소의 여러 표준 데이터셋(예: Iris, Wine, Breast Cancer, Sonar 등)을 사용했으며, 각 데이터셋에 대해 정확도, 정밀도, 재현율, F1 점수를 측정하였다. 결과는 ABC‑FLNN이 MLP‑BP와 비교해 평균 3~5% 수준의 정확도 향상을 보였으며, 특히 비선형 경계가 복잡한 데이터셋에서 그 차이가 두드러졌다. 또한, 학습 시간 측면에서도 단일층 구조와 병렬화 가능한 ABC 연산 덕분에 MLP 대비 약 30% 정도의 속도 개선을 기록하였다.

이 논문은 FLNN과 ABC의 결합이 구조적 단순성과 최적화 효율성을 동시에 달성할 수 있음을 입증한다. 그러나 몇 가지 한계점도 존재한다. 첫째, 차원 확장에 사용되는 비선형 함수를 사전에 선택해야 하는데, 함수 선택이 성능에 큰 영향을 미칠 수 있다. 둘째, ABC의 탐색 단계가 무작위성을 크게 의존하므로, 매우 큰 차원에서는 수렴 속도가 느려질 가능성이 있다. 셋째, 실험에 사용된 데이터셋이 비교적 소규모이므로, 대규모 고차원 데이터에 대한 확장성 검증이 추가로 필요하다. 향후 연구에서는 적응형 비선형 함수 선택, 하이브리드 메타휴리스틱(예: ABC와 PSO 결합) 및 GPU 기반 병렬 구현을 통해 이러한 한계를 보완하고, 이미지 분류나 시계열 예측 등 복잡한 실제 문제에 적용해볼 수 있을 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기