하이퍼플레인 배열과 리프티드 로컬리티 센시티브 해싱

초록

본 논문은 하이퍼플레인 기반 LSH에서 오프셋을 무시하는 기존 학습 방법의 한계를 지적하고, “리프트” 변환을 통해 오프셋을 효과적으로 포함시켜 하이퍼플레인 배치를 개선한다. 제안 기법을 여러 고차원 데이터셋에 적용해 하이퍼플레인 수, 데이터 통계 특성, 그리고 검색 정확도 간의 관계를 실험적으로 분석한다.

상세 분석

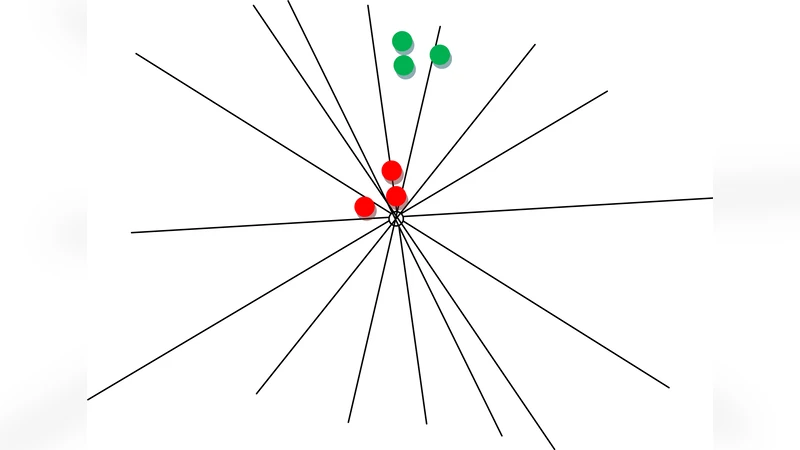

LSH는 고차원 벡터를 비트열로 변환해 해밍 거리로 근사 유사도를 빠르게 계산한다. 특히, 하이퍼플레인 기반 LSH는 각 비트를 “벡터와 하이퍼플레인 법선 벡터의 내적 부호”로 정의한다. 이때 하이퍼플레인의 위치를 결정하는 오프셋(절편) 파라미터를 포함하면, 공간이 더 세밀하게 분할되어 유클리드 거리와 해밍 거리 사이의 상관관계가 강화된다. 그러나 대부분의 기존 학습 알고리즘은 오프셋을 0으로 고정하고 법선만을 최적화한다. 이는 동일한 법선 집합이라도 실제 분할 영역 수가 제한돼, 특히 데이터가 원점에서 멀리 떨어진 경우 성능 저하가 두드러진다.

논문은 이러한 문제를 해결하기 위해 “리프트”라는 선형 변환을 도입한다. 원본 d차원 공간을 (d+1)차원으로 확장하고, 기존 하이퍼플레인(오프셋 0)을 새로운 차원에 대한 가중치와 결합해 사실상 오프셋을 포함한 하이퍼플레인으로 변환한다. 수학적으로는 기존 법선 w∈ℝ^d 를 (w, b)∈ℝ^{d+1} 로 매핑하고, 입력 벡터 x를 (x,1) 로 확장한다. 이렇게 하면 기존 오프셋 없는 학습 알고리즘을 그대로 사용하면서도, 최적화 과정에서 b가 자유롭게 조정되어 실제 오프셋 효과를 얻는다.

핵심 통찰은 리프트가 “오프셋을 학습 파라미터 공간에 자연스럽게 삽입”함으로써, 기존 알고리즘의 구조적 단순성을 유지하면서도 분할 정밀도를 크게 높인다는 점이다. 실험에서는 (1) 하이퍼플레인 수가 증가할수록 해밍 거리와 유클리드 거리의 Pearson 상관이 오프셋 포함 경우에 현저히 높아짐을 확인했으며, (2) 데이터 분포가 비대칭이거나 평균이 원점이 아닌 경우에 특히 이득이 크다. 또한, 리프트 변환은 계산 비용이 거의 추가되지 않아 실시간 검색 시스템에 바로 적용 가능하다.

댓글 및 학술 토론

Loading comments...

의견 남기기