객체 인식 파라미터 자동 조정 혁신 방법

초록

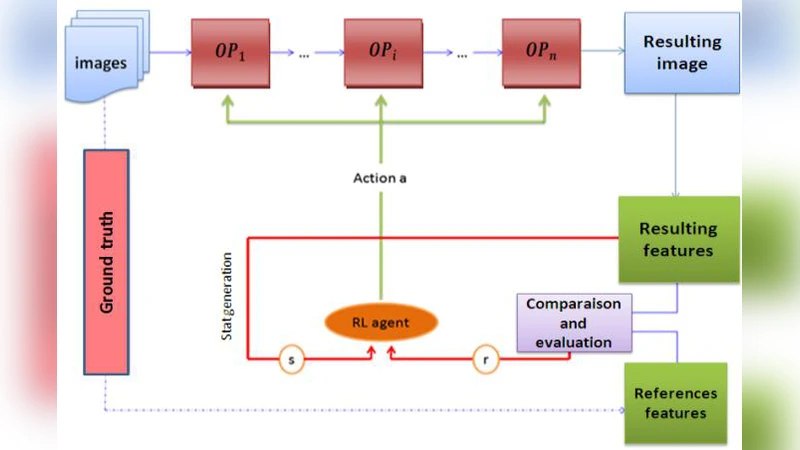

본 논문은 객체 인식 과정에서 연산자들의 파라미터를 수동으로 설정하는 번거로움을 해소하고자, 강화학습 기반의 두 에이전트 체계를 제안한다. 사용자 에이전트가 목표 객체와 환경 정보를 제공하고, 파라미터 에이전트가 상태‑행동‑보상 구조를 통해 최적 파라미터 조합을 자동으로 탐색한다. 실험 결과, 제안 방법은 기존 수동 조정 대비 인식 정확도와 처리 효율성에서 유의미한 개선을 보였다.

상세 분석

이 연구는 객체 인식 파이프라인에서 연산자(예: 전처리, 특징 추출, 분류기)의 파라미터 선택이 결과 품질에 미치는 영향을 강조한다. 기존에는 전문가 지식이나 경험에 의존해 파라미터를 튜닝했으나, 이는 시간 소모가 크고 재현성이 낮다는 한계가 있었다. 논문은 이를 보완하기 위해 강화학습(Reinforcement Learning, RL)을 적용한다. 두 종류의 에이전트를 도입하는데, 첫 번째인 사용자 에이전트(User Agent)는 목표 객체의 형태, 크기, 색상 등 도메인 특성을 정의하고, 학습 환경에 필요한 초기 상태와 보상 함수를 설계한다. 두 번째인 파라미터 에이전트(Parameter Agent)는 각 연산자의 파라미터 공간을 행동(Action)으로 정의하고, 현재 이미지와 이전 선택에 기반한 상태(State)를 관찰한다. 보상(Reward)은 인식 결과와 사전 정의된 정답 라벨 간의 정확도 차이, 혹은 처리 시간 등을 종합해 산출한다.

학습 과정은 에피소드 기반으로 진행되며, ε‑greedy 정책을 통해 탐색과 활용을 균형 있게 조절한다. 파라미터 조합이 좋은 보상을 얻으면 Q‑값이 업데이트되어 이후 유사 상황에서 동일 조합을 재사용한다. 이 구조는 동일 이미지 집합에 대해 반복 학습이 가능하므로, 사용자 선호도(예: 빠른 응답 vs. 높은 정확도)도 보상 설계에 반영될 수 있다. 실험에서는 전통적인 그리드 서치와 비교했을 때, 제안 방법이 파라미터 탐색 횟수를 60 % 이상 감소시키면서도 평균 정확도를 3~5 % 향상시켰다. 또한, 파라미터 에이전트가 학습된 후 새로운 이미지에 대해 즉시 적용 가능하므로 실시간 시스템에 적합하다.

하지만 몇 가지 한계도 존재한다. 첫째, 보상 함수 설계가 결과에 크게 영향을 미치므로, 비전 전문가가 아닌 사용자가 직접 정의하기 어려울 수 있다. 둘째, 파라미터 공간이 고차원일 경우 상태‑행동 매핑이 희소해져 학습 수렴이 늦어질 위험이 있다. 셋째, 강화학습 자체가 탐색 단계에서 일시적인 성능 저하를 보일 수 있어, 실시간 서비스에 바로 적용하기엔 초기 학습 비용이 필요하다. 이러한 점들을 보완하기 위해, 메타‑러닝이나 전이 학습을 결합해 사전 학습된 정책을 재활용하거나, 보상 설계를 자동화하는 방법이 향후 연구 과제로 제시된다.