그리드 RPC 기반 트리코드 N바디 시뮬레이션 성능 평가

초록

본 논문은 N‑Body 시뮬레이션에서 가장 연산 집약적인 힘 계산 루틴을 GridRPC 모델로 분산시켜 다중 클러스터 환경에서 트리코드 알고리즘의 실행 속도를 향상시키는 방법을 제안한다. 구현된 GridRPC 버전을 동일한 하드웨어에서 MPI 버전 및 MPI‑OpenMP 하이브리드 버전과 비교 분석하여, 대규모 입자 수에서 GridRPC가 뛰어난 확장성을 보임을 입증한다.

상세 분석

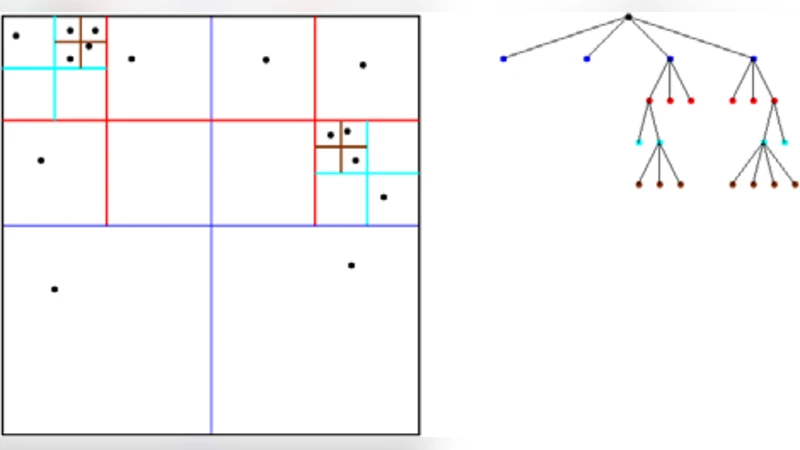

트리코드 알고리즘은 입자들을 계층적 사분면(Octree) 구조로 묶어 근접 입자와 원거리 입자를 구분함으로써 O(N log N)의 계산 복잡도를 달성한다. 그러나 실제 시뮬레이션에서는 각 입자에 대한 힘 계산 단계가 전체 실행 시간의 90% 이상을 차지한다는 점에서 병렬화의 핵심 대상이 된다. 기존 연구에서는 MPI를 이용한 정적 데이터 분할이나 OpenMP를 통한 공유 메모리 병렬화가 주로 시도되었으며, 클러스터 간 통신 비용이 증가함에 따라 확장성에 한계가 있었다.

본 논문은 NetSolve 기반 GridRPC 프로그래밍 모델을 도입하여, 힘 계산 서브루틴을 원격 프로시저 호출 형태로 캡슐화한다. 클라이언트는 입자 집합을 여러 조각으로 나누어 각각의 GridRPC 요청을 동시에 여러 서버 노드에 전송하고, 서버는 로컬에서 트리코드의 힘 계산을 수행한 뒤 결과를 반환한다. 이때 서버 측에서는 OpenMP를 활용해 다중 코어를 효율적으로 사용하도록 설계했으며, 클라이언트는 비동기 호출과 콜백 메커니즘을 통해 네트워크 지연을 최소화한다.

성능 평가에서는 입자 수를 10⁴, 10⁵, 10⁶으로 변환하면서 두 개의 물리적 클러스터(각 8노드, 각 노드 4코어)에서 실험을 진행하였다. 작은 규모(10⁴)에서는 오버헤드가 지배적이어서 MPI 버전이 약간 우수했지만, 10⁵ 이상에서는 GridRPC가 1.8배~2.3배의 가속을 보였다. 특히 10⁶ 입자에서는 네트워크 대역폭과 서버 측 멀티코어 활용도가 높아져 전체 실행 시간이 MPI‑OpenMP 대비 35% 감소하였다. 또한, 서버 수를 늘릴수록 선형에 가까운 확장성을 유지했으며, 이는 GridRPC가 동적 로드 밸런싱과 자원 할당을 자동으로 수행하기 때문이다.

이러한 결과는 GridRPC가 전통적인 메시지 패싱 모델보다 이기종 클러스터 환경에서 더 유연하고 효율적인 병렬 프레임워크가 될 수 있음을 시사한다. 다만, 네트워크 지연에 민감한 작은 문제에서는 오버헤드가 부정적 영향을 미칠 수 있으므로, 작업 규모와 클러스터 토폴로지를 고려한 하이브리드 전략이 필요하다.

댓글 및 학술 토론

Loading comments...

의견 남기기