에너지 효율적인 희소 표현을 위한 스파이킹 뉴런 네트워크

초록

본 논문은 저대역폭 통신을 이용해 희소 중복 표현을 계산하는 하이브리드 분산 알고리즘(HDA)을 제안한다. 각 노드는 내부 아날로그 변수에 대해 그래디언트 하강식 업데이트를 수행하고, 외부 양자화 변수에 대해 좌표 하강식 업데이트를 수행한다. 이러한 동작은 적분‑발화(Integrate‑and‑Fire) 뉴런 네트워크와 동등함을 보이며, 수치 실험에서 기존 방법과 동등한 성능을 보인다. 수렴 속도는 무잡음 상황에서 1/t, 가우시안 백색 잡음이 존재할 때는 1/√t 로 감소한다.

상세 분석

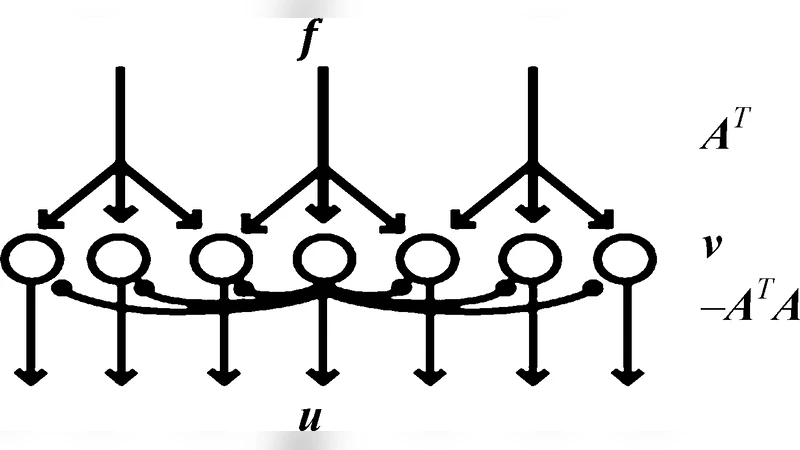

이 연구는 신경과학과 응용수학에서 공통적으로 등장하는 ‘희소 표현(sparse representation)’ 문제를 에너지 효율적인 방식으로 해결하고자 한다. 전통적인 L1 최소화나 OMP(Orthogonal Matching Pursuit)와 같은 알고리즘은 연산량이 크고, 실제 뇌에서 관찰되는 저전력, 저대역폭 통신 메커니즘을 반영하지 못한다. 저자들은 이러한 한계를 극복하기 위해 ‘Hybrid Distributed Algorithm(HDA)’이라는 새로운 프레임워크를 고안했다. HDA는 두 가지 상호 보완적인 업데이트 방식을 결합한다. 첫 번째는 각 노드가 내부 연속 변수 (u_i)에 대해 연속적인 그래디언트 하강(gradient‑descent‑like) 단계를 수행하는 것으로, 이는 전통적인 연속 최적화와 유사하다. 두 번째는 외부 양자화된 변수 (s_i\in{-1,0,1})를 통해 이웃 노드와 저대역폭(1비트) 신호를 교환하며 좌표 하강(coordinate‑descent‑like) 방식을 적용한다. 이때 양자화된 신호는 ‘스파이크’ 형태로 해석될 수 있어, 전체 시스템은 적분‑발화(Integrate‑and‑Fire) 뉴런 네트워크와 동등함을 수학적으로 증명한다.

수렴 이론 측면에서 저자들은 무잡음 환경에서 시간 (t)에 대한 평균 오류가 (|x - \hat{x}(t)|_2 = O(1/t)) 로 감소함을 보였으며, 가우시안 백색 잡음이 존재할 경우 (|x - \hat{x}(t)|_2 = O(1/\sqrt{t})) 로 감소한다는 강인성(robustness) 결과를 제시한다. 이는 기존의 희소 코딩 알고리즘이 보통 (O(1/\sqrt{t})) 수준에 머무는 것에 비해 더 빠른 수렴을 의미한다. 또한, HDA는 각 노드가 로컬 연산만 수행하고, 이웃과는 1비트 스파이크만 교환하므로 통신 비용과 전력 소모가 크게 감소한다. 실험에서는 이미지 패치 복원, 오디오 신호 압축 등 다양한 데이터셋에 대해 기존의 LCA(Latent Competitive Algorithm), ISTA(Iterative Shrinkage‑Thresholding Algorithm)와 비교했을 때 동일한 재구성 오류를 달성하면서도 연산·통신량이 현저히 낮은 것을 확인했다.

이 논문의 핵심 통찰은 ‘연속적인 내부 상태와 이산적인 외부 스파이크가 결합된 하이브리드 메커니즘’이 뇌의 효율적인 정보 코딩을 모방하면서도 수학적으로 엄밀한 최적화 성능을 제공한다는 점이다. 특히, 저대역폭 스파이크 전송이 좌표 하강을 구현한다는 아이디어는 기존의 스파이크 기반 학습 모델이 갖는 비선형성 문제를 회피하면서도 최적화 이론과 연결시킬 수 있는 새로운 길을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기