구조 활용 가속 비정형 SGD

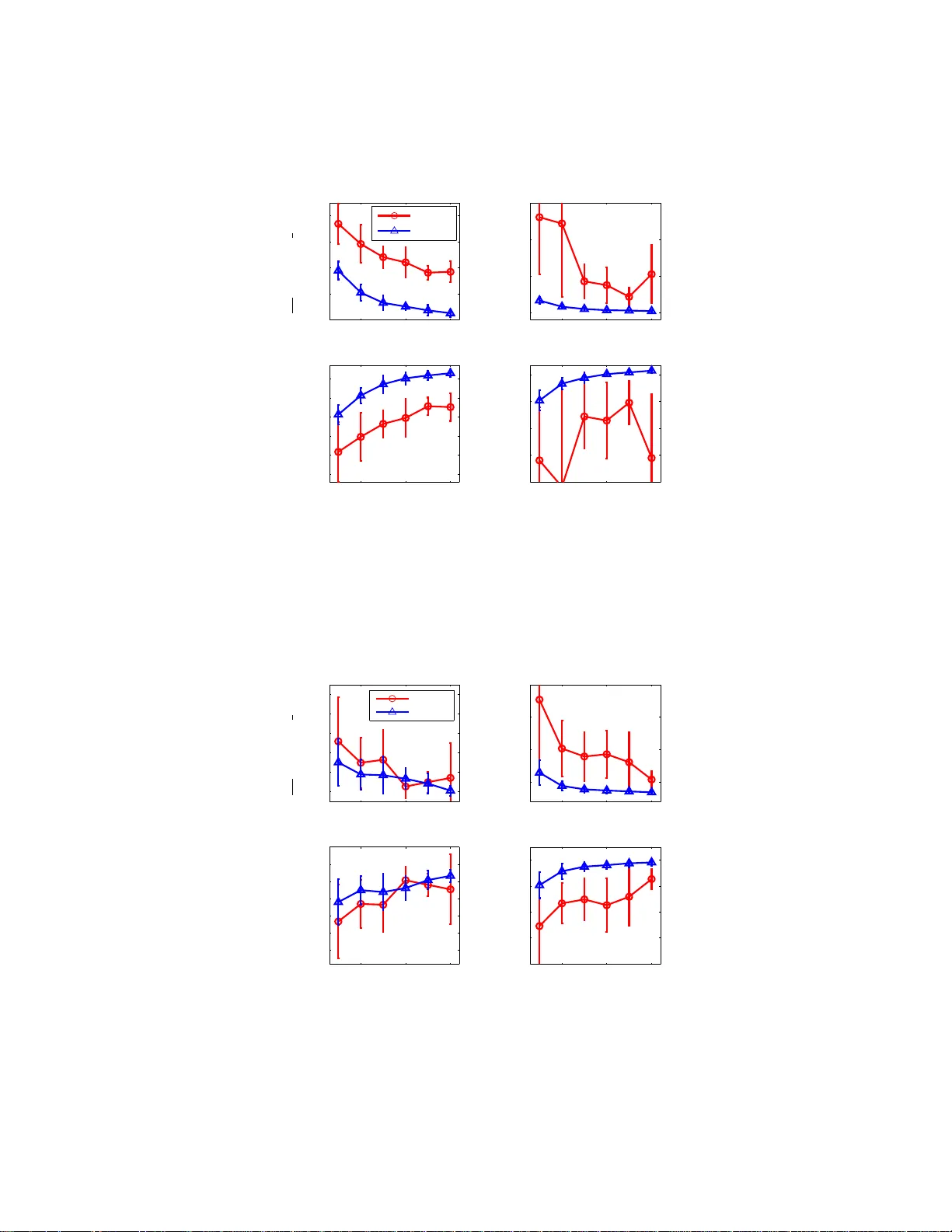

본 논문은 비정형(비스무스) 손실 함수를 위한 확률적 최적화 알고리즘인 ANSGD(Accelerated Nonsmooth Stochastic Gradient Descent)를 제안한다. Nesterov의 스무딩 기법을 확률적 환경에 확장하고, 강한 볼록성 가정 하에 O(1/t) 수렴 속도를 달성한다. 실험 결과는 기존 SGD 및 변형 알고리즘보다 현저히 빠른 수렴을 보여준다.

저자: Hua Ouyang, Alex, er Gray

본 논문은 머신러닝에서 자주 등장하는 비정형(비스무스) 손실 함수를 확률적 최적화 환경에서 효율적으로 최소화하기 위한 새로운 알고리즘, Accelerated Nonsmooth Stochastic Gradient Descent(ANSGD)를 제안한다. 기존의 확률적 서브그라디언트 방법은 비정형 손실에 대해 O(log t / t) 정도의 느린 수렴 속도를 보이며, 강한 볼록성 가정이 없을 경우에는 더욱 비효율적이다. 저자들은 Nesterov가 제시한 deterministic 스무딩 기법을 확률적 설정에 맞게 변형하고, 이를 Nesterov 가속 프레임워크와 결합함으로써 비정형 손실에 대해 최적의 O(1/t) 수렴률을 달성한다.

### 1. 문제 정의 및 기존 접근법

목표는 합성 형태 Φ(x)=f(x)+g(x) 를 최소화하는 것이다. 여기서 f(x)=E_ξ

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기