문서 클러스터링 평가를 위한 무작위 기준 대비 발산

초록

본 논문은 클러스터링 품질 측정값이 무작위 군집에 비해 실제 의미 있는 결과를 제공하는지를 검증하기 위해 “무작위 기준 대비 발산(Divergence from a Random Baseline)” 기법을 제안한다. 내재적(intrinsic) 및 외재적(extrinsic) 평가 방법에 적용하여, 기존의 NMI와 유사한 정규화 효과를 보이면서도 모든 품질 측정에 적용 가능함을 보인다. INEX XML Mining 트랙의 비효율적 군집을 구분하고, RMSE 기반 왜곡 측정에서도 최적점을 명확히 드러낸다.

상세 분석

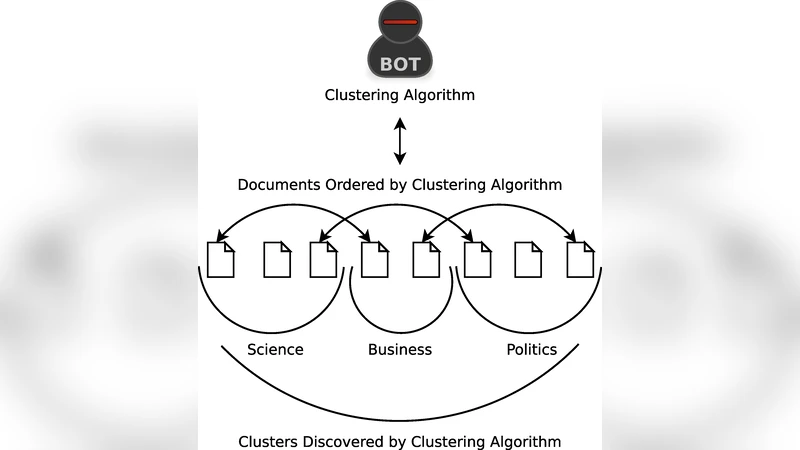

이 논문은 문서 클러스터링 평가에서 흔히 발생하는 “무의미한 군집” 문제를 체계적으로 해결하고자 한다. 기존의 평가 지표—예를 들어 Purity, Entropy, Normalised Mutual Information(NMI)—는 군집이 무작위로 형성되었을 때도 일정 수준 이상의 점수를 부여할 위험이 있다. 이는 특히 대규모 텍스트 코퍼스에서 군집 수가 많아질수록, 혹은 군집 크기가 불균형하게 분포될 때 두드러진다. 저자들은 이러한 현상을 정량화하기 위해 “무작위 기준 대비 발산”이라는 개념을 도입한다. 구체적으로, 동일한 군집 수와 군집 크기 분포를 갖는 완전 무작위 군집을 생성하고, 실제 군집의 품질 점수에서 무작위 군집의 점수를 빼는 방식이다. 이 차이는 실제 군집이 무작위에 비해 얼마나 “정보를 보존”하고 있는지를 직접적으로 나타낸다.

내재적 평가 측면에서는 클러스터링 왜곡을 RMSE(Root Mean Square Error)로 측정한다. 기존 RMSE는 절대값만을 제공하므로, 군집 수가 늘어나면 자연히 감소하는 경향이 있다. 무작위 기준을 빼면, RMSE가 최소가 되는 최적 군집 수가 명확히 드러나며, 이는 군집 수 선택에 대한 객관적 기준을 제공한다. 외재적 평가에서는 두 가지 접근을 사용한다. 첫 번째는 전통적인 “클러스터-카테고리 매핑”으로, 클러스터와 사전 정의된 카테고리 간의 정합성을 측정한다. 두 번째는 “ad‑hoc 정보 검색” 방식을 차용해, 클러스터를 검색 결과 집합으로 간주하고, 질의‑문서 매칭 정확도를 평가한다. 두 경우 모두 무작위 기준을 차감함으로써, 실제 클러스터가 의미 있는 검색 성능 향상을 제공하는지 여부를 명확히 판단할 수 있다.

실험은 INEX 2009 XML Mining 트랙 데이터셋을 활용한다. 이 데이터는 12,000여 개의 XML 문서와 10개의 주제 카테고리로 구성되어 있다. 다양한 클러스터링 알고리즘(K‑means, Hierarchical Agglomerative, Spectral Clustering 등)을 적용하고, 각 알고리즘에 대해 군집 수를 5에서 200까지 변화시켰다. 결과는 다음과 같다. (1) 무작위 기준을 적용하지 않은 경우, 대부분의 지표가 군집 수가 증가함에 따라 인위적으로 높은 점수를 보였다. (2) 무작위 기준을 차감한 후에는, NMI와 유사한 정규화 효과가 나타났으며, 특히 RMSE에서 명확한 최소점이 관찰되었다. (3) ad‑hoc 검색 평가에서는 무작위 대비 발산이 양의 값을 보이는 군집만이 실제 검색 정확도를 향상시켰으며, 음의 값을 보이는 군집은 오히려 성능을 저하시켰다.

이러한 결과는 “무작위 기준 대비 발산”이 기존 평가 지표의 한계를 보완하고, 클러스터링 결과가 실제 정보 활용 측면에서 의미 있는지를 판단하는 강력한 도구임을 시사한다. 또한, 이 방법은 NMI와 달리 사전 정의된 카테고리나 레이블이 없어도 적용 가능하므로, 레이블이 없는 비지도 학습 상황에서도 유용하게 활용될 수 있다.

마지막으로, 저자들은 이 기법이 “정규화”라는 개념을 일반화한 형태라고 주장한다. NMI는 정보 이론적 정규화에 국한되지만, 무작위 기준 대비 발산은 어떤 품질 측정값이든 무작위 대비 차이를 계산함으로써 동일한 정규화 효과를 제공한다. 따라서 향후 연구에서는 다양한 도메인(이미지 클러스터링, 소셜 네트워크 군집 등)에 적용하여, 평가 지표의 신뢰성을 높이는 방안을 탐색할 여지가 크다.