다변량 정보 측정 실험가의 관점

초록

본 논문은 다변량 정보 이론의 주요 측정값들을 정리하고, 각각의 정의·특성·제한점을 간단한 모델과 배양된 신경세포의 스파이킹 데이터에 적용해 비교한다. 또한 모든 측정값을 손쉽게 계산할 수 있는 MATLAB 툴킷을 공개한다.

상세 분석

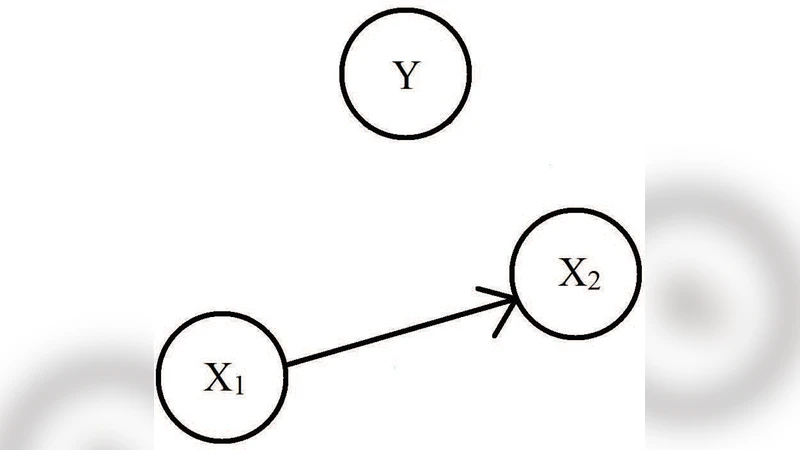

이 연구는 다변량 정보 측정값을 체계적으로 정리하면서, 기존 문헌에서 용어와 표기법이 뒤섞여 있던 문제를 명확히 한다. 먼저 엔트로피와 상호정보량을 기본 개념으로 재정의하고, 이를 확장한 여러 다변량 지표—Interaction Information(II), Co‑information, Total Correlation(TC), Dual Total Correlation(DTC), ΔI, Redundancy‑Synergy Index(RSI), Varadan’s Synergy(VS) 그리고 Partial Information Decomposition(PID)—를 차례로 소개한다. 각 지표는 “시너지”와 “중복”을 어떻게 정량화하느냐에 따라 서로 다른 수학적 형태와 해석을 제공한다. 예를 들어 II와 Co‑information은 부호에 따라 시너지(양)와 중복(음)을 구분하지만, 변수 개수가 짝수·홀수일 때 부호가 바뀌는 점을 명시한다. TC는 전체 변수 집합의 결합분포와 독립 모델 사이의 KL‑발산으로 정의되며, 이는 다변량 상호의존성을 전체적으로 포착한다. 반면 DTC는 각 변수의 조건부 엔트로피를 합산한 뒤 전체 엔트로피를 보정해 “과잉 엔트로피”를 측정한다. ΔI는 실제 결합분포와 독립 가정 모델 사이의 KL‑거리로, 신경코딩에서 상관관계가 정보 전달에 미치는 비용을 정량화한다. RSI는 전체 상호정보량에서 개별 변수와 목표 변수 사이의 정보를 뺀 값으로, 양이면 시너지, 음이면 중복을 의미한다. VS는 전체 상호정보량에서 가장 큰 부분집합 정보를 뺀 차이로, 부분집합 선택에 따라 시너지/중복을 평가한다. 마지막으로 PID는 정보의 “고유”, “공유”, “시너지” 성분을 명시적으로 분해해, 다변량 상호작용을 구조적으로 해석한다. 논문은 이들 지표를 3~4개의 인공 모델(예: XOR, AND, 랜덤 상관)과 실제 배양 신경망 데이터에 적용해, 각 지표가 어떤 상황에서 의미 있는 값을 내는지 실증적으로 보여준다. 결과는 특히 시너지와 중복을 동시에 포착하려는 경우 PID가 가장 풍부한 정보를 제공하지만, 계산 복잡도가 높아 실용성에서는 TC·DTC·RSI가 좋은 대안이 될 수 있음을 시사한다. 또한 제공된 MATLAB 툴킷은 사용자 정의 변수와 데이터에 대해 모든 지표를 일관된 인터페이스로 계산하도록 설계돼, 연구자들이 손쉽게 적합한 지표를 선택하고 비교할 수 있게 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기