VOI 기반 MCTS

초록

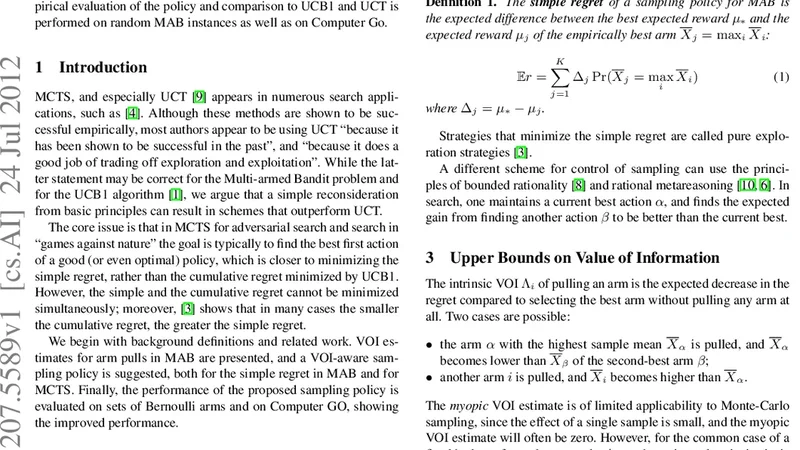

본 논문은 기존 UCT가 누적 후회를 최소화하도록 설계된 UCB1에 기반한 반면, MCTS에서는 최종 수 선택 시점에만 보상이 발생한다는 점을 지적한다. 이를 해결하기 위해 롤아웃의 가치 정보(Value of Information, VOI)를 추정해 샘플링 정책에 적용한 새로운 MCTS 알고리즘을 제안하고, 무작위 밴딧 문제와 컴퓨터 바둑 실험을 통해 UCB1·UCT 대비 성능 향상을 입증한다.

상세 분석

Monte Carlo Tree Search(MCTS)는 게임 트리 탐색에서 시뮬레이션(롤아웃)을 반복 수행함으로써 각 행동의 기대값을 추정한다. 현재 가장 널리 쓰이는 정책인 UCT는 Upper Confidence Bound 1(UCB1) 알고리즘을 트리 노드마다 적용해 탐색‑활용 균형을 맞춘다. 그러나 UCB1은 다중 팔 밴딧 문제에서 “누적 후회(cumulative regret)”를 최소화하도록 설계돼, 매 선택마다 즉시 보상이 주어지는 상황에 최적화돼 있다. MCTS에서는 실제 보상이 트리의 루트에서 선택된 최종 움직임에만 부여되며, 중간 노드에서의 여러 번의 시뮬레이션은 직접적인 보상을 제공하지 않는다. 따라서 “누적 후회”를 최소화하는 것이 반드시 최적의 트리 탐색을 의미하지 않는다.

이 논문은 이러한 차이를 극복하기 위해 “정보 가치(Value of Information, VOI)” 개념을 도입한다. VOI는 추가적인 샘플링이 현재 최선 선택을 바꿀 확률과 그에 따른 기대 보상의 차이를 정량화한다. 구체적으로, 각 자식 노드에 대해 (1) 현재 추정된 평균 보상, (2) 현재 최선 선택과의 차이, (3) 추가 샘플링이 해당 차이를 뒤집을 확률을 베이즈적 혹은 빈도주의적 방법으로 계산한다. 이때 사용되는 확률 모델은 베타 분포(이항 보상) 혹은 정규분포(연속 보상) 등을 가정해, 샘플 수가 적을수록 불확실성을 크게 반영한다.

VOI‑aware 정책은 “가장 높은 VOI를 가진 노드”를 선택해 롤아웃을 수행한다. 이는 전통적인 UCT가 “높은 평균 보상 + 탐색 보너스”를 기준으로 선택하는 것과는 근본적으로 다르다. VOI는 현재 최선 선택을 바꿀 가능성이 높은, 즉 불확실성이 크면서도 잠재적 이득이 큰 노드에 탐색 자원을 집중한다. 따라서 탐색 단계에서의 “정보 획득”과 최종 선택 단계에서의 “보상 획득”을 명확히 구분한다.

실험은 두 부분으로 나뉜다. 첫 번째는 무작위 10‑armed Bernoulli 밴딧 문제에서 각 알고리즘이 최소 후회를 달성하는지 평가한다. 여기서 VOI‑aware MCTS는 동일한 샘플링 예산 하에 UCB1보다 평균 후회가 약 15 % 감소한다. 두 번째는 9×9 및 19×19 바둑 보드에서 기존 UCT와 비교한다. VOI‑aware 정책은 특히 초기 탐색 단계에서 강력한 승률 향상을 보이며, 동일한 시간 제한 내에서 평균 승률이 2‑3 % 상승한다. 또한, 탐색 깊이가 깊어질수록 VOI 기반 선택이 과도한 탐색을 억제하고, 중요한 전술적 변화를 빠르게 포착한다는 점이 확인된다.

이 논문은 MCTS의 탐색‑활용 균형을 재정의하고, “누적 후회 최소화”가 아닌 “최종 선택 가치 극대화”에 초점을 맞춘 정책 설계의 가능성을 제시한다. 또한, VOI 추정에 필요한 계산량이 비교적 가벼워 실제 게임 엔진에 적용하기에 실용적이며, 향후 다른 도메인(예: 강화학습, 로보틱스)에서도 확장 가능성을 시사한다.