평생 오프라인 학습을 위한 대규모 가치 함수 확장

초록

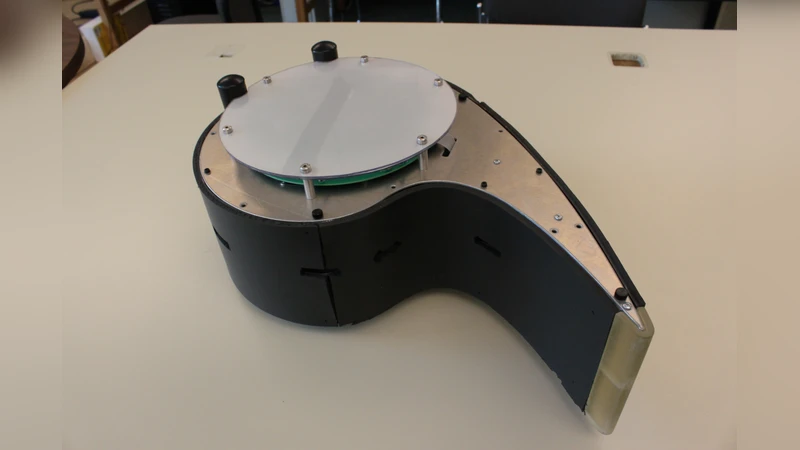

본 논문은 모바일 로봇에서 수천 개의 정책에 대해 동시에 오프‑폴리시 일반 가치 함수(GVF)를 학습하는 방법을 제시한다. 최신 GTD(λ) 알고리즘과 타일 코딩을 활용해 오프‑폴리시 목표 함수(MSPBE)를 온라인으로 추정하는 두 가지 기법을 제안하고, 이를 통해 1,000개의 정책에 대한 가치 함수를 실시간으로 학습한다.

상세 분석

이 연구는 기존 Horde 아키텍처가 한 번에 하나의 정책만 학습할 수 있다는 한계를 극복하고, 다중 정책을 동시에 학습하는 오프‑폴리시 설정을 실현한다. 핵심 기술은 GTD(λ) 알고리즘이다. GTD(λ)는 선형 함수 근사와 온‑폴리시 TD(λ)의 수렴성을 보장하면서도, 행동 정책과 목표 정책이 다를 때도 안정적으로 학습한다는 장점이 있다. 논문에서는 타일 코딩을 사용해 고차원 상태 공간을 효율적으로 표현하고, 각 정책마다 별도의 가중치 벡터를 유지함으로써 수백 개의 GVF를 동시에 업데이트한다.

오프‑폴리시 학습의 주요 난제는 목표 정책에 대한 기대값을 정확히 추정하는 것이며, 이를 평가하기 위한 전통적인 방법은 주기적인 온‑폴리시 테스트였다. 테스트는 로봇의 행동을 방해하고, 스케일업에 큰 제약을 만든다. 저자들은 이 문제를 해결하기 위해 MSPBE(Monte‑Carlo Stochastic Prediction Bellman Error)를 온라인으로 추정하는 두 가지 방법을 고안했다. 첫 번째는 TD‑error의 제곱을 누적 평균으로 계산하는 방식이고, 두 번째는 가중치 업데이트 과정에서 직접 MSPBE의 샘플 추정값을 얻는 방식이다. 실험 결과 두 방법 모두 높은 정확도를 보였으며, 특히 두 번째 방법이 계산 비용이 낮아 실시간 로봇 제어에 더 적합했다.

스케일링 실험에서는 1,000개의 목표 정책에 대해 각각 10개의 GVF를 학습시켰으며, 로봇은 단일 무작위 행동 정책만을 따랐다. 전체 시스템은 30 Hz 이상의 실시간 속도로 동작했으며, 학습된 GVF는 로봇의 센서 데이터와 행동 결과를 예측하는 데 유용한 정보를 제공했다. 이러한 결과는 평생 학습 에이전트가 다양한 목표와 환경에 대해 동시에 지식을 축적할 수 있음을 입증한다.

또한 논문은 GTD(λ)의 수렴 조건, 타일 코딩 파라미터 선택, 그리고 MSPBE 추정기의 편향·분산 특성에 대한 이론적 논의를 포함한다. 특히, 오프‑폴리시 상황에서의 중요도 가중치(importance sampling ratio)가 매우 큰 경우 학습이 불안정해질 수 있음을 지적하고, 이를 완화하기 위한 클리핑 기법과 학습률 스케줄링을 제안한다. 전체적으로 이 연구는 오프‑폴리시 다중 정책 학습을 실용적인 수준으로 끌어올린 중요한 진전이다.