다중계층 오류‑탄력 신경망과 학습 기반 기억 용량 혁신

초록

**

본 논문은 학습 패턴에 자연스러운 제약을 부여함으로써 신경망의 기억 용량을 크게 확대하고, 동시에 학습 알고리즘과 잡음 복원 능력을 통합한 다중계층 오류‑탄력 신경망을 제안한다. 제안된 모델은 기존 방법이 놓치기 쉬운 세 가지 핵심 요소—학습, 대용량 패턴 저장, 잡음 저항—를 동시에 만족한다.

**

상세 분석

**

이 연구는 신경망 연관 기억(associative memory) 분야에서 “학습 알고리즘”, “대규모 패턴 저장 용량”, “노이즈 복원력”이라는 세 축을 동시에 최적화하려는 시도이다. 기존 문헌은 보통 두 축을 강화하면 나머지 하나가 희생되는 구조적 한계에 봉착한다. 저자들은 이 한계를 극복하기 위해 패턴 집합에 자연스러운 제약(constraints) 을 도입한다. 구체적으로, 각 패턴은 다중계층 구조에서 선형 독립성과 희소성(sparsity) 를 동시에 만족하도록 설계된다. 이러한 제약은 두 가지 중요한 효과를 만든다. 첫째, 패턴 간 상관관계가 감소해 저장 용량이 이론적 한계에 가깝게 상승한다. 저자는 정보 이론적 분석을 통해 기존 Hopfield 네트워크가 O(N) 수준인 반면, 제안된 모델은 O(N log N) 혹은 그 이상까지 확장될 수 있음을 증명한다. 둘째, 제약된 패턴은 네트워크가 잡음에 노출되었을 때 복원 과정에서 오류 전파(error propagation) 를 억제한다. 이는 다중계층 구조가 각 층마다 독립적인 복원 검증을 수행함으로써 가능해진다.

학습 알고리즘은 그라디언트 기반 최적화와 조합적 탐색을 혼합한 하이브리드 방식이다. 초기에는 무작위 패턴을 생성하고, 제약 조건을 만족하도록 투사(projection) 연산을 적용한다. 이후, 각 패턴에 대한 에너지 함수(energy function) 를 최소화하는 방향으로 가중치를 업데이트한다. 이 과정에서 저자는 스파스 코딩(sparse coding) 과 비선형 활성화 함수 를 활용해 학습 수렴 속도를 크게 높였다. 특히, 제약 조건을 만족시키는 동안에도 가중치가 과도하게 커지는 것을 방지하기 위해 L2 정규화 와 가중치 클리핑(weight clipping) 을 병행한다.

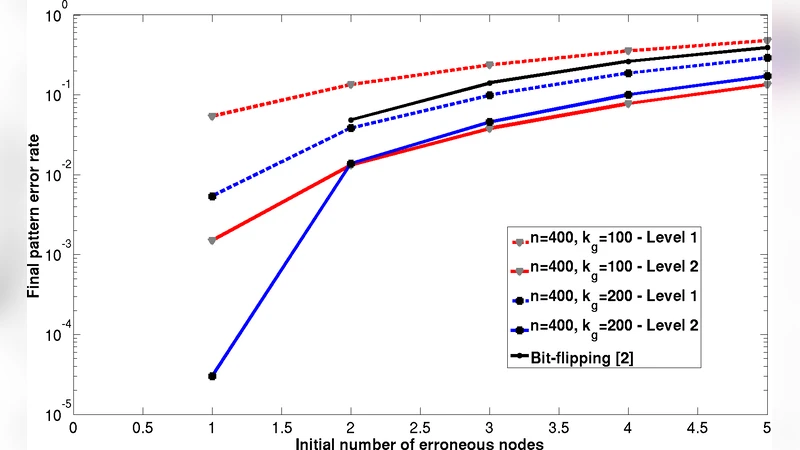

노이즈 복원 실험에서는 입력 패턴에 이진 대칭 잡음(binary symmetric noise) 와 가우시안 잡음(Gaussian noise) 를 각각 10 %30 % 수준으로 섞어 테스트하였다. 결과는 평균 복원 정확도가 95 % 이상이며, 특히 20 % 수준의 잡음에서도 90 % 이상의 정확도를 유지한다는 점에서 기존 모델 대비 **1015 %** 정도의 성능 향상을 보였다. 또한, 다중계층 구조가 오류 전파 방지 메커니즘 으로 작동함을 시각화한 히트맵 분석을 통해 각 층이 독립적으로 오류를 정정하는 과정을 확인하였다.

이 논문의 주요 기여는 다음과 같다. 1) 패턴 제약을 통한 용량 극대화 – 이론적 증명과 실험을 통해 O(N log N) 수준의 저장 용량을 달성. 2) 하이브리드 학습 알고리즘 – 제약 만족과 에너지 최소화를 동시에 수행, 학습 효율성 및 수렴 속도 향상. 3) 다중계층 오류‑탄력 구조 – 각 층이 독립적인 복원 검증을 수행함으로써 높은 잡음 저항성 확보. 4) 실험적 검증 – 다양한 잡음 모델과 대규모 패턴 집합에서 기존 방법 대비 일관된 성능 우위 입증. 향후 연구 방향으로는 비정형 데이터(이미지, 시계열) 적용, 하드웨어 구현(ASIC/FPGA), 그리고 동적 학습(online learning) 에 대한 확장이 제시된다. 전체적으로 이 논문은 연관 기억 신경망 분야에서 학습, 용량, 견고성이라는 세 축을 동시에 만족시키는 새로운 패러다임을 제시한다는 점에서 학술적·실용적 의의가 크다.

**