그래픽 다중에이전트 모델에서 지식 결합

초록

본 논문은 그래픽 다중에이전트 모델(GMM)을 이용해 게임 이론적 분석과 휴리스틱 행동 규칙 등 서로 다른 지식원을 결합하는 방법을 제시한다. equilibrium에서의 확률적 이탈을 허용하는 게임 기반 모델과 휴리스틱 기반 모델을 각각 정의하고, 이를 ‘의견 풀(opinion pool)’, ‘직접 업데이트(direct update)’, ‘데이터 혼합(mixing data)’ 세 가지 방식으로 통합한다. 실제 행동은 강화학습 에이전트가 생성한 데이터를 사용해 평가했으며, 모든 결합 방법이 단일 지식원보다 예측 정확도가 높았다. 특히 데이터 혼합 방식이 가장 우수한 성능을 보였다.

상세 분석

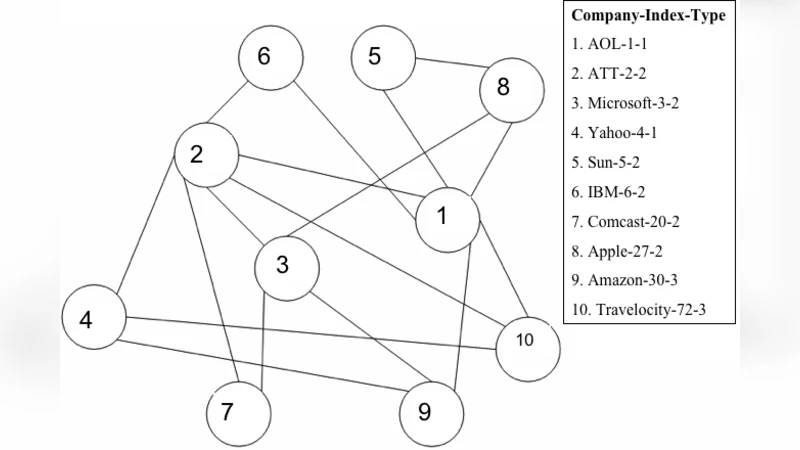

그래픽 다중에이전트 모델(GMM)은 에이전트 집합의 행동을 확률적 그래프 구조로 표현함으로써, 전통적인 게임 이론이 제공하는 균형 개념을 넘어 다양한 불확실성을 포괄한다. 논문은 먼저 GMM을 두 종류의 지식원으로부터 구축한다. 첫 번째는 ‘게임 기반 모델’로, 기존 그래픽 게임 표현(예: 그래픽 베이즈 네트워크, 그래픽 스택엘리시티 등)을 확장해 각 노드가 균형 전략이 아닌, 균형 주변에서 확률적으로 벗어날 수 있는 분포를 갖는다. 이는 실제 인간이나 학습 에이전트가 완전한 이성적 행동을 하지 않는 상황을 모델링한다. 두 번째는 ‘휴리스틱 모델’로, 에이전트가 단순 규칙(예: 보상에 비례한 확률 선택)이나 경험 기반 추정에 따라 행동한다는 가정을 담는다.

세 가지 결합 방법은 각각 다른 통계적 가정을 반영한다. ‘의견 풀’은 각 모델이 독립적인 확률 분포를 제공한다는 전제 하에, 베이지안 가중 평균을 통해 최종 분포를 산출한다. 이때 가중치는 사전 신뢰도에 따라 조정될 수 있어, 전문가 의견을 반영하기에 적합하다. ‘직접 업데이트’는 한 모델을 기준으로 삼아, 다른 모델이 제공하는 샘플을 이용해 파라미터를 재학습한다. 즉, 기존 GMM의 조건부 확률을 새로운 데이터(다른 모델의 출력)로 업데이트하는 방식이다. 마지막 ‘데이터 혼합’은 두 모델이 생성한 샘플을 단순히 합쳐 하나의 학습 데이터셋으로 만든 뒤, 동일한 구조의 GMM을 다시 학습한다. 이는 가장 직관적이며, 실제 데이터와 모델이 생성한 가상 데이터를 동시에 활용한다는 점에서 강건성을 제공한다.

실험에서는 강화학습(RL) 에이전트가 반복 게임을 수행해 생성한 행동 데이터를 ‘실제 결과’로 삼았다. RL 에이전트는 초기에는 무작위 정책을 사용하지만, 반복 학습을 통해 점차 게임 이론적 균형에 근접한다. 각 결합 방법은 이 RL 데이터를 이용해 예측 정확도를 평가했으며, 모든 경우에 단일 모델(게임 기반 또는 휴리스틱)보다 높은 로그우도와 낮은 KL 발산을 기록했다. 특히 데이터 혼합 방식은 두 모델의 장점을 그대로 보존하면서, 샘플 다양성을 증가시켜 과적합을 방지하고, 가장 낮은 예측 오차를 달성했다.

이 결과는 GMM이 다양한 지식원을 통합하는 유연한 프레임워크임을 실증적으로 입증한다. 또한, ‘데이터 혼합’이 실제 시스템 설계에서 가장 실용적인 접근법일 수 있음을 시사한다. 향후 연구에서는 더 복잡한 네트워크 토폴로지, 비정상적 행동(예: 악의적 공격) 및 온라인 학습 시나리오에 대한 확장 가능성을 탐색할 필요가 있다.