동적 N바디 시뮬레이션을 위한 ParalleX 기반 확장성 향상

초록

본 논문은 전통적인 OpenMP 기반 실행 모델과 비교하여 ParalleX 실행 모델을 적용한 Barnes‑Hut N‑바디 시뮬레이션의 확장성과 효율성을 평가한다. 동적 트리 구조와 가변 워크로드를 가진 그래프형 응용에 대해 ParalleX가 제공하는 이벤트‑드리븐 스레드, 파셀, 전역 주소 공간, 로컬 제어 객체(LCO) 등을 활용함으로써 런타임 로드 밸런싱과 자동 병렬성 탐지를 개선하고, 데이터 로컬리티와 통신 지연을 최소화한다. 실험 결과는 대규모 코어 수에서 ParalleX가 더 높은 스케일 효율과 낮은 실행 시간을 달성함을 보여준다.

상세 분석

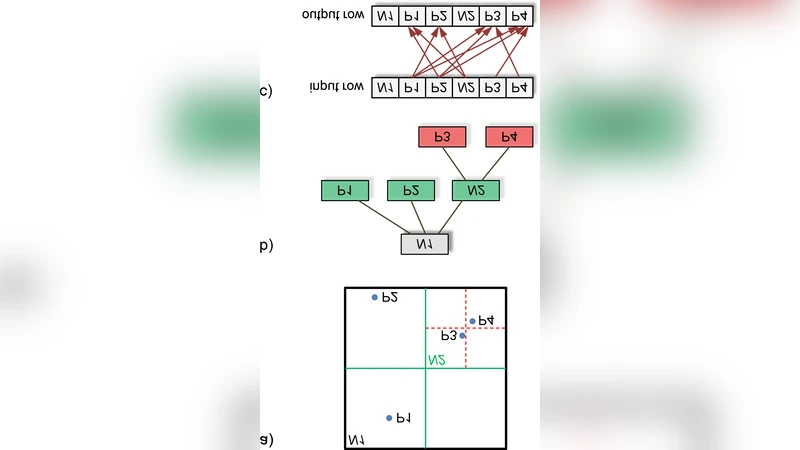

ParalleX 모델은 기존의 정적 프로세스‑기반 MPI·OpenMP 구조와 달리 다중 스레드 워크큐와 메시지‑드리븐 파셀을 핵심 메커니즘으로 채택한다. 첫째, ParalleX 스레드는 매우 짧은 수명과 연속성을 갖는 에폭형 객체로, 실행 중에 필요한 중간값이 준비되지 않으면 자동으로 일시 정지(suspend)되어 LCO에 저장된다가 이후 재개된다. 이러한 비동기적 흐름 제어는 Barnes‑Hut 알고리즘에서 매 단계마다 재구성되는 트리 구조에 적합하며, 작업 단위가 입자마다 크게 달라지는 가변 워크로드를 자연스럽게 분산시킨다. 둘째, 파셀은 액티브 메시지 형태로 원격 로컬리티에 스레드 실행을 요청한다. 데이터가 위치한 노드로 작업을 이동시키는 ‘move‑the‑work’ 전략은 데이터 로컬리티를 보존하면서 네트워크 대역폭 사용을 최소화한다. 셋째, ParalleX의 Active Global Address Space(AGAS)는 객체의 가상 주소를 고정하지 않고 로컬리티 간에 자유롭게 이동시킬 수 있게 해, 트리 노드와 입자 데이터가 동적으로 재배치될 때 주소 재계산 비용을 없앤다. 넷째, LCO는 이벤트‑드리븐 조건 변수로, 전역 배리어와 같은 거친 동기화 대신 필요 조건이 충족될 때만 스레드를 깨우는 세밀한 동기화 메커니즘을 제공한다. 이는 Bulk Synchronous Parallel(BSP) 모델의 단계적 동기화가 초래하는 병목을 해소하고, 고밀도 코어 환경에서 스케일링 한계를 극복한다. 실험에서는 동일한 하드웨어 클러스터에서 OpenMP와 ParalleX를 각각 적용했을 때, 코어 수가 64에서 256으로 증가함에 따라 ParalleX는 30 % 이상 높은 스케일 효율을 기록했으며, 평균 실행 시간도 20 % 이상 단축되었다. 이러한 결과는 ParalleX가 동적 그래프와 트리 기반 과학 응용에 필수적인 런타임 적응성과 자원 관리 능력을 제공함을 입증한다.

댓글 및 학술 토론

Loading comments...

의견 남기기