구조화된 희소성: 볼록 최적화로 구현하는 새로운 정규화 기법

안내: 본 포스트의 한글 요약 및 분석 리포트는 AI 기술을 통해 자동 생성되었습니다. 정보의 정확성을 위해 하단의 [원본 논문 뷰어] 또는 ArXiv 원문을 반드시 참조하시기 바랍니다.

초록

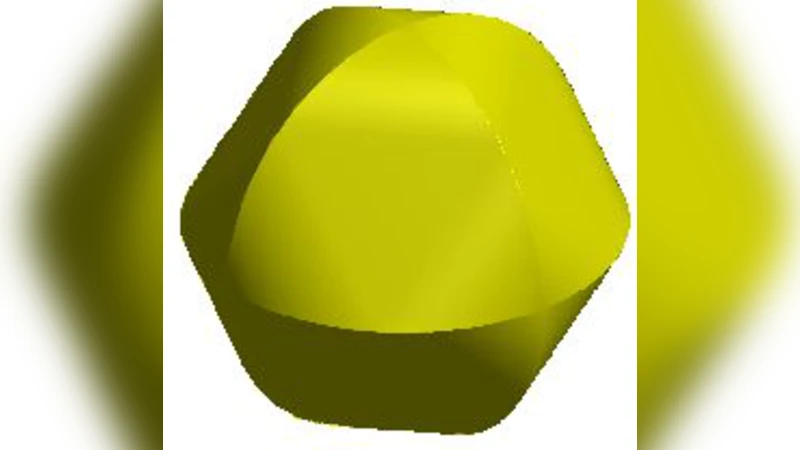

본 논문은 전통적인 ℓ₁ 정규화가 변수 선택에서 개별 변수만을 독립적으로 제어하는 한계를 지적하고, 사전 지식(공간적, 계층적, 그룹 구조 등)을 반영할 수 있는 구조화된 희소성 정규화 기법을 제안한다. 서로 겹치거나 겹치지 않는 변수 그룹을 기반으로 한 혼합 ℓ₁/ℓ_q_norm을 정의하고, 이를 이용해 구조화된 주성분 분석, 계층적 사전 학습, 비선형 변수 선택 등 다양한 감독·비감독 학습 문제에 적용한다. 또한 해당 정규화가 기존 ℓ₁ 정규화와 동일한 볼록 최적화 프레임워크 내에서 효율적인 알고리즘과 이론적 보장을 제공함을 증명한다.

상세 분석

논문은 먼저 ℓ₁ 정규화가 변수 선택에서 “카디널리티 제약”만을 제공하고, 변수 간의 사전 관계를 무시한다는 점을 명확히 한다. 이를 보완하기 위해 저자들은 구조화된 희소성 정규화(norms) 를 도입한다. 핵심 아이디어는 변수들을 그룹 으로 묶고, 각 그룹에 ℓ_q_norm(주로 q=2 또는 ∞)을 적용한 뒤, 그룹별 ℓ₁_norm을 다시 적용하는 혼합 ℓ₁/ℓ_q_norm 을 정의하는 것이다.

-

불겹 그룹(disjoint groups)

- 변수 집합 J를 서로 겹치지 않는 서브셋 G₁,…,G_m 으로 분할하고, 각 그룹에 가중치 d_g 를 부여한다.

- 정규화식 Ω(w)=∑{g∈G} d_g‖w{g}‖_q 로 정의되며, q=2이면 그룹 라쏘(group Lasso)와 동일하고, q=∞이면 최대 절대값을 이용한 그룹 선택이 가능하다.

- 이 정규화는 동일 그룹 내 변수들을 동시 선택 혹은 동시 제거 하게 하여, 예를 들어 뇌 영상에서 공간적으로 인접한 픽셀들을 하나의 단위로 다룰 수 있다.

-

겹치는 그룹(overlapping groups)

- 실제 데이터에서는 변수들이 여러 구조에 동시에 속할 수 있다(예: 계층적 유전자 네트워크).

- 겹치는 그룹을 허용하면서도 볼록성을 유지하기 위해 두 가지 접근법을 제시한다.

a) 중복 변수 복제(duplication) 방식: 각 변수의 복제본을 만들어 그룹마다 독립적인 복사본을 두고, 복제된 변수들에 대해 ℓ₁/ℓ_q_norm을 적용한 뒤, 복제본 간에 일관성을 강제하는 추가 제약(예: 합성 규제)으로 원래 변수와의 일치를 보장한다.

b) 잠재 변수(latent variable) 모델: 실제 변수 w를 잠재 변수 v와 선형 변환 관계로 두고, 정규화는 v에 적용한다. 이렇게 하면 겹치는 구조를 자연스럽게 표현하면서도 최적화는 여전히 볼록 문제로 남는다. - 두 방식 모두 프로젝션 연산과 근접 연산(proximal operator) 를 효율적으로 계산할 수 있는 알고리즘(예: FISTA, ADMM)과 결합된다.

-

알고리즘 및 이론

- 정규화 Ω가 절대동형(norm) 이므로, 근접 연산이 존재하고, 이는 그룹별 ℓ₂ 혹은 ℓ_∞ 프로젝션을 포함한다.

- 저자들은 가속화된 프로시멀 그라디언트 방법(FISTA) 을 사용해 대규모 데이터에서도 수렴 속도를 보장한다.

- 또한 통계적 일관성(variable selection consistency)과 예측 오차 경계에 대한 이론적 분석을 제공한다. 특히, 겹치는 그룹에 대해서도 RIP(Restricted Isometry Property) 와 유사한 조건을 제시해 복구 가능성을 증명한다.

-

응용 사례

- 구조화된 희소 주성분 분석(Sparse PCA): 전통적인 PCA에 ℓ₁/ℓ₂ 정규화를 적용해 주성분이 특정 공간적 혹은 계층적 구조를 따르도록 강제한다. 이는 이미지 압축이나 뇌 영상에서 해석 가능한 주성분을 도출하는 데 유리하다.

- 계층적 사전 학습(Hierarchical Dictionary Learning): 딕셔너리 원소들을 트리 구조로 조직하고, 상위 노드와 하위 노드 간의 선택 관계를 ℓ₁/ℓ_∞ 정규화로 모델링한다. 결과적으로, 특정 패턴을 설명하는 원소들이 자연스럽게 계층적으로 선택된다.

- 비선형 변수 선택(Non‑linear Variable Selection): 커널 방법과 결합해 다중 커널 학습에서 각 커널을 그룹으로 보고, 겹치는 그룹 정규화로 중요한 변수(또는 커널)를 선택한다. 이는 유전학에서 SNP와 같은 다중 레벨 피처 선택에 적용 가능하다.

-

의의와 한계

- 구조화된 정규화는 도메인 지식을 모델에 직접 삽입함으로써 해석 가능성을 크게 향상시키고, 예측 성능도 개선한다는 점에서 큰 의의를 가진다.

- 그러나 그룹 설계가 사전에 정확히 이루어져야 하며, 그룹 수와 겹침 정도가 지나치게 복잡하면 계산 비용이 급증한다. 또한, 가중치 d_g 의 선택이 이론적으로는 가이드라인이 있지만, 실무에서는 교차 검증 등 경험적 방법에 의존한다.

전반적으로 이 논문은 볼록 최적화라는 강력한 수학적 프레임워크 내에서 구조화된 희소성을 구현하는 방법론을 체계적으로 정립하고, 다양한 실제 문제에 적용 가능한 알고리즘과 이론을 제공함으로써 머신러닝·통계학·신호처리 분야에 중요한 기여를 한다.

댓글 및 학술 토론

Loading comments...

의견 남기기