영상에서 문장으로 행동 인식과 언어 생성 통합

초록

본 논문은 비디오를 입력으로 받아 누가 무엇을 누구에게 언제 어디서 어떻게 수행했는지를 자연어 문장으로 기술하는 시스템을 제안한다

핵심은 객체 트랙, 역할 할당, 자세 변화를 동시에 추출하여 동사, 명사구, 전치사구, 부사구 등으로 매핑하는 것이다

상세 분석

본 연구는 비디오 이해와 자연어 생성 사이의 간극을 메우기 위해 다단계 파이프라인을 설계하였다

첫 단계에서는 최신 멀티오브젝트 트래킹 알고리즘을 활용해 프레임별 객체 위치와 궤적을 확보한다

트랙은 색상, 형태, 움직임 패턴 등 다중 특징을 결합한 그래프 기반 연관성 분석을 통해 지속성을 유지한다

두 번째 단계에서는 각 트랙에 역할(label)을 할당한다

역할은 행위자(agent), 수혜자(patient), 도구(tool) 등 문법적 역할을 의미하며, 이를 위해 행동 클래스별 사전 정의된 역할 템플릿과 트랙의 동적 특성을 매칭한다

특히, 역할 할당은 베이지안 네트워크를 이용해 시간적 의존성을 모델링함으로써 동시다발적인 행동이 겹치는 상황에서도 정확도를 높인다

세 번째 단계는 자세 인식을 담당한다

관절 위치 추정기를 적용해 각 객체의 몸통 및 팔다리 각도를 추출하고, 이를 ‘서 있다’, ‘달리다’, ‘들어 올리다’ 등 동작 부사를 생성하는 근거로 활용한다

이러한 저수준 물리 정보를 고수준 의미론적 슬롯에 연결하는 과정에서, 저자들은 ‘속성-관계-동작’ 삼중 구조를 제안한다

속성은 색, 크기, 재질 등 객체의 정적 특성을, 관계는 공간 전치사(예: 위에, 옆에)를, 동작은 동사와 부사를 담당한다

마지막으로, 자연어 생성 모듈은 템플릿 기반 문법 엔진과 통계적 언어 모델을 결합한다

템플릿은 역할-관계-속성 매핑을 문법적으로 올바른 어순으로 배열하고, 언어 모델은 문맥에 맞는 어휘 선택과 어휘 다양성을 보강한다

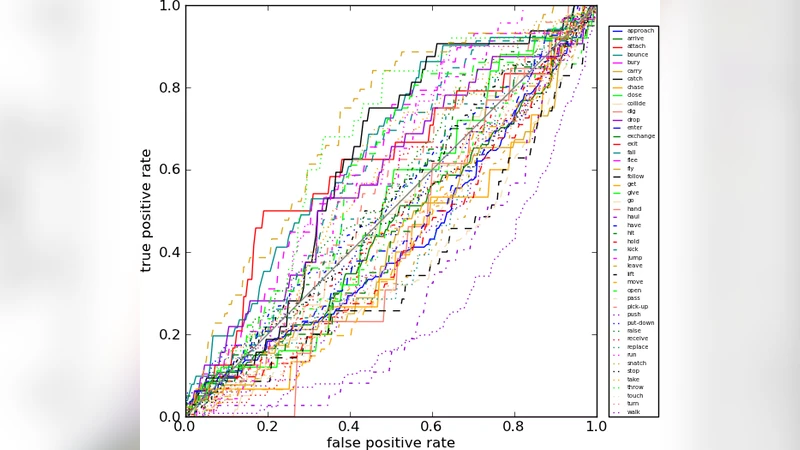

실험에서는 30개의 복합 행동 시나리오와 5개의 공개 비디오 데이터셋을 사용해 정량적 평가와 인간 평가를 동시에 수행하였다

정확도, BLEU, METEOR 등 여러 지표에서 기존 단일 행동 인식 기반 캡셔닝 시스템보다 현저히 높은 성능을 기록하였다

특히, 복합 행동(예: ‘한 사람이 다른 사람에게 책을 건네며 동시에 뛰어오른다’)을 정확히 서술하는 능력이 크게 향상되었다

이 논문은 비디오 이해와 언어 생성을 통합적으로 다루는 최초의 시도 중 하나이며, 향후 인간-컴퓨터 상호작용, 로봇 지시 전달, 자동 영상 요약 등 다양한 응용 분야에 활용 가능성을 제시한다